Deepfakes: Selbst Satellitenbilder sind nicht sicher

Wer Deepfakes bislang hauptsächlich als Methode sah, um menschliche Gesichter zu manipulieren, muss umdenken. Die Technik greift auch bei anderem Bildmaterial wie Satellitenbildern, das zeigt eine aktuelle Studie.

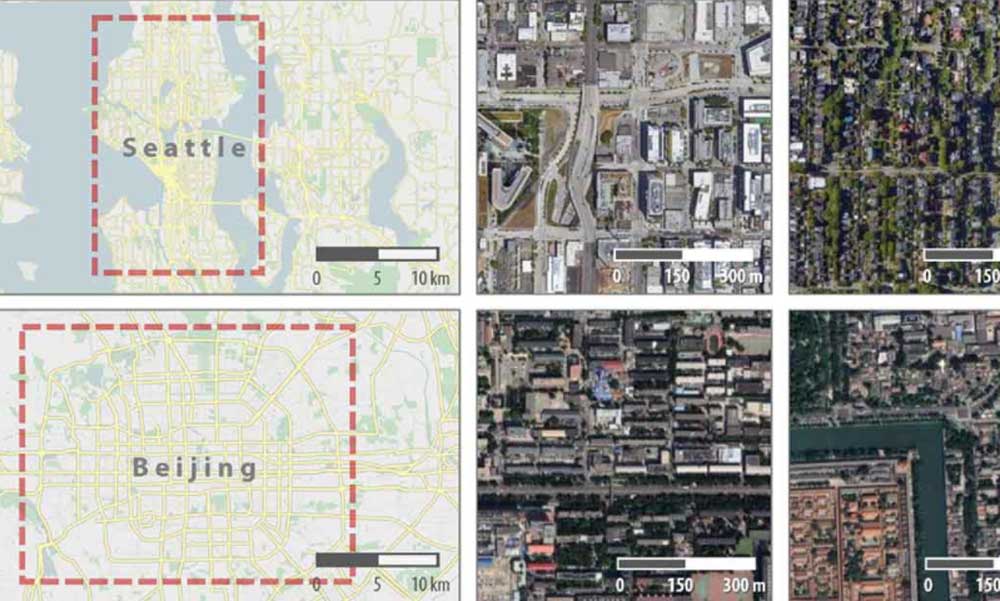

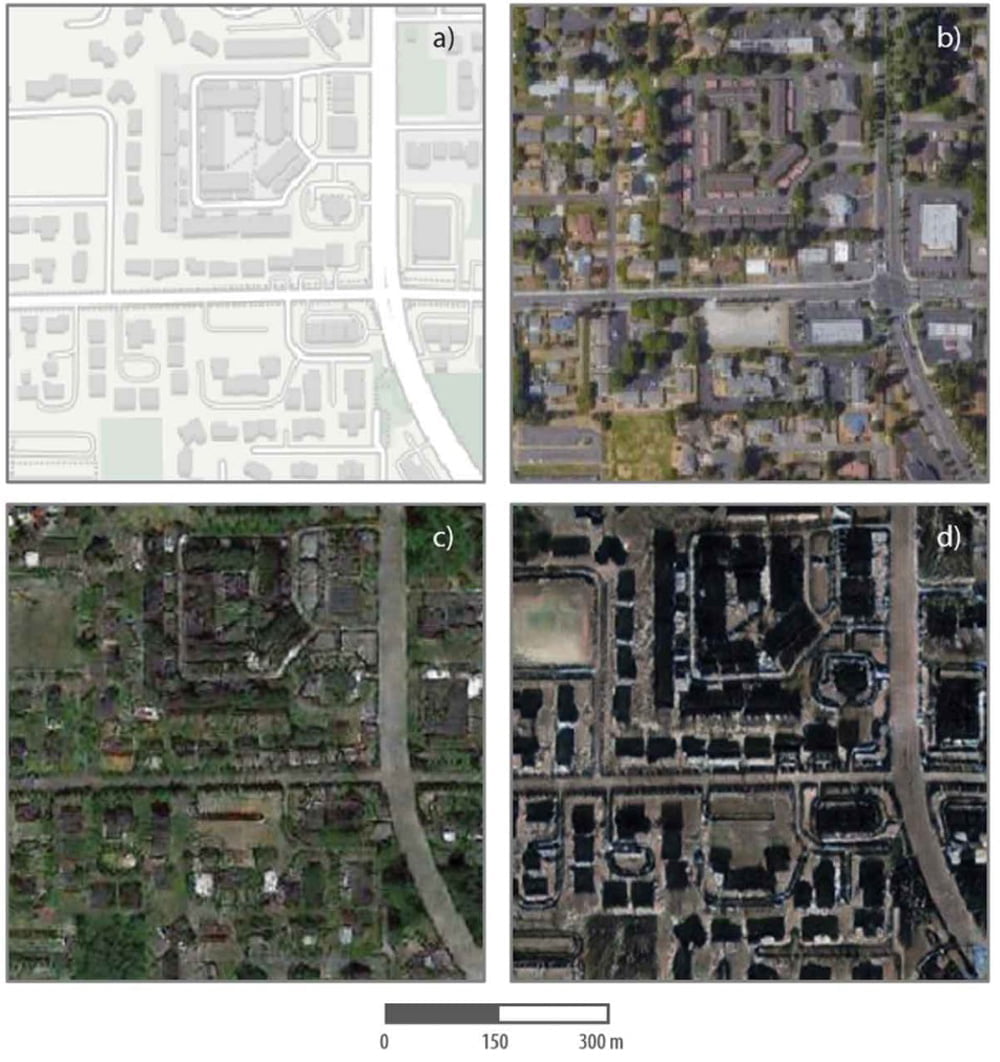

Forscher von der Universität Washington treten in einer neuen Studie den Beweis an, dass mit Deepfake-Technik auch Satellitenbilder glaubhaft gefälscht werden können. Konkret verwendeten die Forscher die Open-Source-Software CycleGAN, mit der sie simulierte Satellitenbilder mit Landschaftsmerkmalen veränderten, die sie aus realen Aufnahmen der Städte Seattle und Peking extrahierten.

Diese "Fake Geography", wie die Forscher sie nennen, sei keineswegs ein neues Phänomen. Menschen würden schon seit Jahrtausenden Karten falsch darstellen aus verschiedenen Gründen - strategisch, um sie zu vereinfachen oder weil sie es nicht besser wissen.

Wie bei KI üblich, resultiert die neue Bedrohung aus der massenhaften Skalierung, Automatisierung und Vereinfachung solcher Fälschungen und dem hohen Täuschungsgrad durch die visuelle Wirkmacht der generierten Bilder. Ähnlich verhält es sich mit Deepfakes bei menschlichen Gesichtern, auch hier war der Gesichtertausch mit Computertechnologie schon zuvor möglich. Allerdings waren nur einige wenige Menschen dazu in der Lage und das mit gehörigem Aufwand.

Lügen in Karten

Problematisch könnten solche Deepfake-Karten beispielsweise im militärischen Kontext sein, wenn auf Satellitenbildern Bedrohungen auftauchen, die in Wirklichkeit gar nicht existieren. Umgekehrt könnten Bedrohungen von der Karte verschwinden oder ganze Pfade und Regionen.

Außerdem gilt auch für Karten die grundlegende Deepfake-Problematik: Wenn Menschen Bildern grundsätzlich misstrauen müssen, weil sie Fälschungen sein könnten, können auch reale Aufnahmen einfacher infrage gestellt werden. Beweise, die durch Satellitenbilder erbracht werden, könnten also zukünftig stärker hinterfragt oder geleugnet werden.

"Die Existenz einiger weniger Deepfake-Fälschungen kann uns dazu zwingen, die Vertrauenswürdigkeit jedes einzelnen Teils von Geodaten zu überprüfen", schreiben die Forscher in ihrer Studie Deep fake geography? When geospatial data encounter Artificial Intelligence.

Forscher warnen vor "Fake-Geographie"-Dystopie

Bo Zhao, Assistenzprofessor für Geographie an der Universität Washington, wollte gemeinsam mit seinen Forscher-Kollegen beweisen, dass Deepfake-Technik (Entwicklungsgeschichte) auch Satellitenbilder glaubhaft manipulieren kann.

Das gelang ihm und seinem Team laut eigenen Aussagen. Die KI-generierten Deepfake-Karten seien "unangenehm realistisch" und könnten zumindest das ungeschulte Auge leicht täuschen. Auch für die Forscher selbst sei es "fast unmöglich" gewesen, reale Satellitenbilder von KI-generierten zu unterscheiden.

Die Forscher wollen mit ihrer Arbeit in erster Linie Geographen darauf aufmerksam machen, dass Deepfake-Karten möglich und ein Risiko sind. "Wenn wir uns nicht auf Deepfakes vorbereiten, dann gehen wir das Risiko ein, in eine 'Fake-Geographie'-Dystopie zu geraten", heißt es im Fazit der Forschungsarbeit. Die Forscher schlagen einen Ansatz für die Detektion vor, mit ersten Erfolgen, der allerdings in vielen anderen Szenarien getestet werden müsse.

Die Gruppe um Zhao beurteilt den KI-Einsatz in der Geographie nicht grundlegend kritisch, es existierten auch positive Anwendungsszenarien, beispielsweise bei der Vorhersage von Szenarien für Landnutzungsänderungen, der Rekonstruktion und Erhaltung historischer Szenen und der automatisierten Erstellung von Referenz- und Topografiekarte.

Quellen: Forschungspapier, The Verge

KI-News ohne Hype – von Menschen kuratiert

Mit dem THE‑DECODER‑Abo liest du werbefrei und wirst Teil unserer Community: Diskutiere im Kommentarsystem, erhalte unseren wöchentlichen KI‑Newsletter, 6× im Jahr den „KI Radar"‑Frontier‑Newsletter mit den neuesten Entwicklungen aus der Spitze der KI‑Forschung, bis zu 25 % Rabatt auf KI Pro‑Events und Zugriff auf das komplette Archiv der letzten zehn Jahre.

Jetzt abonnierenKI-News ohne Hype

Von Menschen kuratiert.

- Mehr als 20 Prozent Launch-Rabatt.

- Lesen ohne Ablenkung – keine Google-Werbebanner.

- Zugang zum Kommentarsystem und Austausch mit der Community.

- Wöchentlicher KI-Newsletter.

- 6× jährlich: „KI Radar“ – Deep-Dives zu den wichtigsten KI-Themen.

- Bis zu 25 % Rabatt auf KI Pro Online-Events.

- Zugang zum kompletten Archiv der letzten zehn Jahre.

- Die neuesten KI‑Infos von The Decoder – klar und auf den Punkt.