Deepseek: Ein Haufen "unergründlicher Genies" lässt das Silicon Valley alt aussehen

Mit seinem neuesten Sprachmodell übertrifft das chinesische Start-up Deepseek etablierte Größen wie GPT-4 und Claude 3.5 - und das mit einem Bruchteil der Ressourcen. Hinter dem Erfolg steht ein scheuer Wissenschaftler mit ungewöhnlicher Vision.

Das chinesische KI-Start-up Deepseek sorgt derzeit mit seinem neuesten Modell Deepseek-V3 für Aufsehen in der KI-Welt. Laut Benchmarks übertrifft es zum Teil führende proprietäre Modelle wie GPT-4o und Claude 3.5, obwohl es um ein Vielfaches günstiger in der Entwicklung war.

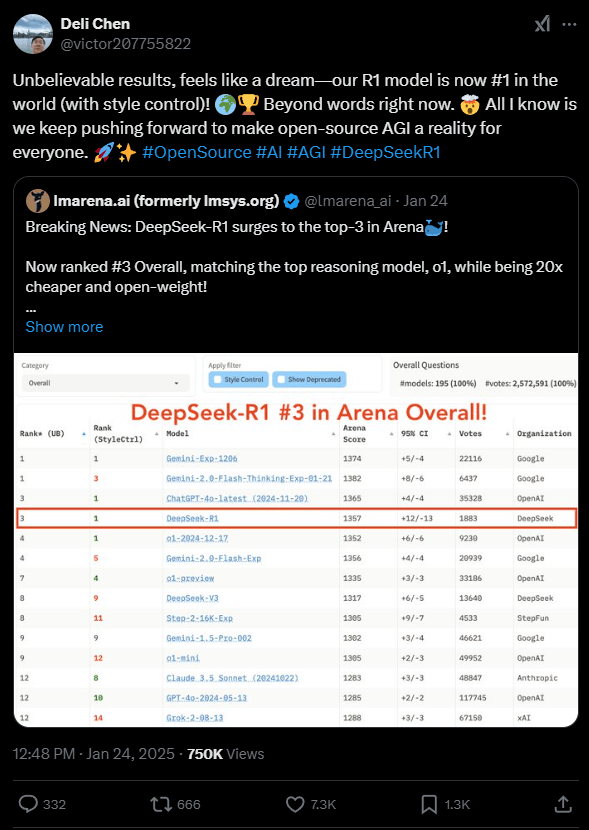

Bereits vor wenigen Monaten hatte das Unternehmen mit seinem R1-Lite-Modell an die Leistung von OpenAIs o1-preview heranreicht. Die finale R1-Version liegt nun gleichauf mit dem OpenAI-Spitzenmodell.

Deepseek profitiert einerseits von den westlichen Open-Source-Vorlagen und Papern, bringt aber auch neue Ideen ein. Die enorme Effizienz und Geschwindigkeit des Start-ups machen angeblich sogar Meta-CEO Mark Zuckerberg nervös.

Vom Quant-Trading zur Spitzen-KI: Die Entstehung von Deepseek

Der Weg zu diesem Erfolg begann mit Liang Wenfeng, der 1985 als Sohn eines Grundschullehrers in Zhanjiang geboren wurde. Nach seinem Bachelor-Abschluss 2006 an der Zhejiang University experimentierte er bereits während seines Masters in Informations- und Kommunikationstechnik mit maschinellem Lernen im Finanzmarkt.

2015 gründete er mit zwei Studienkollegen den Quant-Hedgefonds High-Flyer, der innerhalb von sechs Jahren die Marke von 100 Milliarden RMB (etwa 13 Milliarden Euro) überschritt und zu einem der "Vier Könige des Quant-Investings" aufstieg. 2019 folgte die Gründung des KI-Forschungsarms High-Flyer AI.

2021 begann Wenfeng, tausende Nvidia-GPUs für sein KI-"Nebenprojekt" zu kaufen - was die Branche zunächst als exzentrisches Hobby eines Milliardärs abtat. Ein Geschäftspartner beschrieb ihre erste Begegnung mit einem "sehr nerdigen Typen mit schrecklicher Frisur", der seine Vision kaum artikulieren konnte. Wenfeng sagte einfach, er wolle etwas Bahnbrechendes schaffen.

Wie sich später herausstellte, hatte High-Flyer über 10.000 Nvidia GPUs erworben, bevor die US-Regierung KI-Chip-Beschränkungen für China einführte - die technische Grundlage für Deepseeks späteren Erfolg.

Liang Wenfeng meidet im Gegensatz zu Tech-CEOs wie Sam Altman oder Elon Musk das Rampenlicht. Wie aus seinem IEEE-Profil hervorgeht, ist er auch als CEO noch wissenschaftlich aktiv. 2024 war er an mindestens zwei Forschungspapern als Mitautor beteiligt, die sich mit KI in Fertigungsprozessen und neuartigen Materialien wie speziellen Hydrogelen beschäftigen. Seine früheren Arbeiten konzentrierten sich auf die Manipulation winziger Objekte mittels Licht und elektrischer Felder.

Ein Campus für KI-Forschung entsteht

Im Mai 2023 gründete Wenfeng offiziell Deepseek, mit Büros in Beijing und Hangzhou. Das Start-up ist damit deutlich jünger als seine Hauptkonkurrenten OpenAI (2015) oder Anthropic (2021). Bereits im November 2023 veröffentlichte das Unternehmen sein erstes Modell, den auf Programmierung spezialisierten Deepseek-Coder, gefolgt vom breiter aufgestellten Deepseek-LLM.

Die Büros gleichen einem "Universitätscampus für ernsthafte Forscher", wie ein Geschäftspartner berichtet. An der Modellentwicklung sind zwischen 100 und 140 Personen beteiligt, die Gesamtbelegschaft liegt bei 200 bis 300 Mitarbeitenden.

Das Unternehmen konzentriert sich auf Basistechnologie statt kommerzielle Anwendungen und hat sich der Open-Source-Strategie verpflichtet. Sogar das Fernziel Künstliche allgemeine Intelligenz (AGI) soll als Open Source veröffentlicht werden.

Das Team besteht laut Wenfeng hauptsächlich aus Absolventen von Spitzenuniversitäten, Doktoranden im vierten oder fünften Jahr und jungen Absolventen. Bei der Einstellung zählen primär Leidenschaft und Neugier.

Viele hatten bereits in führenden Journals publiziert und internationale Auszeichnungen gewonnen, aber keine Industrieerfahrung. Der Forscherdrang steht oft vor dem Geldverdienen, dennoch zahlt Deepseek laut Financial Times gemeinsam mit Bytedance die höchsten Gehälter für KI-Ingenieure in China.

Deepseeks Erfolgsgeheimnis: Leidenschaft und Neugier

Die Finanzierung von Deepseek kommt vollständig von High-Flyer. In der chinesischen KI-Szene wurde das Unternehmen zunächst unterschätzt. Wenfeng fehlten die üblichen Karrierestationen: kein Eliteuni-Abschluss, keine US-Ausbildung, keine Position bei den Tech-Giganten. Doch gerade diese Andersartigkeit und die damit verbundene Lean-Mentalität erwiesen sich als Erfolgsfaktoren.

Anders als bei westlichen KI-Unternehmen erwähnt Deepseeks Mission weder Sicherheit noch Wettbewerb oder den Nutzen für die Menschheit. In seinem Mission-Statement bei X heißt es stattdessen: "Das Rätsel der AGI mit Neugier entwirren. Die wesentliche Frage mit Langzeitdenken beantworten." Das KI-Labor konzentriert sich auf potenziell bahnbrechende architektonische und algorithmische Innovationen, die auch Deepseek-V3 viel Aufmerksamkeit eingebracht haben.

Wenfeng selbst betont die nicht-kommerzielle Ausrichtung: "Selbst wenn Sie mich danach fragen würden, könnte ich keinen wirtschaftlichen Grund für die Gründung von Deepseek nennen", erklärt er. "Denn kommerziell lohnt es sich nicht. Grundlagenforschung hat eine sehr niedrige Rendite. Als die frühen Investoren von OpenAI ihr Geld gaben, dachten sie sicher nicht darüber nach, wie viel Rendite sie bekommen würden. Sie wollten diese Sache einfach wirklich machen."

Deepseek-Gründer will mit "knallharter Innovation" Chinas Tech-Mentalität umkrempeln

Wenfeng selbst hofft, dass Deepseek mehr "knallharte Innovation" in der gesamten chinesischen Wirtschaft anregen wird. In der Vergangenheit hätten chinesische Unternehmen den Schwerpunkt auf schnelles Geldverdienen gelegt und die Innovation vernachlässigt. Innovation sei nicht nur eine Frage des Geschäfts, sondern auch der Neugier und des Gestaltungswillens.

"Der wahre Unterschied liegt nicht bei ein oder zwei Jahren", kommentiert er den Vorsprung der USA gegenüber China, "sondern zwischen Originalität und Imitation."

Er ist davon überzeugt, dass die Umstrukturierung der chinesischen Industrie notwendigerweise stärker auf harte technologische Innovationen angewiesen sein wird. Sobald die Gesellschaft es den Menschen, die sich der harten Innovation verschrieben haben, ermöglicht, Ruhm und Reichtum zu erlangen, werde sich auch die kollektive Denkweise anpassen. Es brauche nur einige Beispiele und einen Prozess.

Lean, offen, genial: Viel Anerkennung aus der KI-Branche

Deepseeks technologischer Erfolg hat auch die Aufmerksamkeit und Anerkennung vieler Branchenkolleg:innen auf sich gezogen. Laut Jack Clark, dem ehemaligen Leiter der Abteilung für Politik bei OpenAI und Mitbegründer von Anthropic, habe Deepseek etwa "eine Gruppe von unergründlichen Genies" eingestellt.

Andrej Karpathy, bekannter KI-Vordenker, zeigt sich zum Release von Deepseek-V3 beeindruckt von dessen Leistung: "DeepSeek lässt es heute mit der Veröffentlichung eines hochmodernen großen Sprachmodells mit offenen Gewichten, das mit einem Bruchteil des üblichen Budgets trainiert wurde, einfach aussehen." Wenn das Modell auch die realen Qualitätschecks bestehe, sei es "eine höchst beeindruckende Demonstration von Forschung und Ingenieurskunst unter Ressourcenbeschränkungen".

Ähnlich sieht es der hochrangige Nvidia-Forscher Jim Fan: "Ressourcenbeschränkungen sind etwas Schönes. Der Überlebensinstinkt in einem gnadenlosen KI-Wettbewerbsumfeld ist ein erstklassiger Antrieb für Durchbrüche."

"Überlegene Open-Source-Modelle üben einen enormen Druck auf kommerzielle Spitzenunternehmen aus, sich schneller zu bewegen", schreibt Fan.

Auch Metas KI-Chefwissenschaftler Yann LeCun bezeichnet Deepseeks V3-Modell als "exzellent" und lobt das Open-Source-Engagement des Start-ups. Es habe genau das gemacht, was offene Forschung auszeichnet: bestehende Technologie genommen, optimiert und den Prozess offengelegt.

Auch Deepseek-Modelle werden von der chinesischen Regierung zensiert

Bei allem Erfolg steht Deepseek jedoch auch in der Kritik. Wie viele andere Modelle chinesischer Unternehmen unterliegen die Sprachmodelle staatlicher Zensur. Ob und welche Verbindungen zwischen dem Start-up und der chinesischen Regierung bestehen, ist bis dato nicht bekannt.

Ebenso ist unklar, ob und inwieweit Deepseek gezielt auf den Output großer westlicher KI-Modelle wie GPT-4o trainiert hat, um schneller voranzukommen. Ein Indiz dafür ist, dass die Modelle sich selbst oft als ChatGPT bezeichnen.

Diese Art des Trainings wird von den meisten westlichen Modellherstellern verboten - eine erstaunliche Doppelmoral, wenn man bedenkt, wie die westlichen Modellhersteller selbst ihre Systeme trainiert haben und wie viele Urheberrechtsklagen derzeit gegen sie anhängig sind.

KI-News ohne Hype – von Menschen kuratiert

Mit dem THE‑DECODER‑Abo liest du werbefrei und wirst Teil unserer Community: Diskutiere im Kommentarsystem, erhalte unseren wöchentlichen KI‑Newsletter, 6× im Jahr den "KI Radar"‑Frontier‑Newsletter mit den neuesten Entwicklungen aus der Spitze der KI‑Forschung, bis zu 25 % Rabatt auf KI Pro‑Events und Zugriff auf das komplette Archiv der letzten zehn Jahre.

Jetzt abonnierenKI-News ohne Hype

Von Menschen kuratiert.

- Mehr als 16 % Rabatt.

- Lesen ohne Ablenkung – keine Google-Werbebanner.

- Zugang zum Kommentarsystem und Austausch mit der Community.

- Wöchentlicher KI-Newsletter.

- 6× jährlich: “KI Radar” – Deep-Dives zu den wichtigsten KI-Themen.

- Bis zu 25 % Rabatt auf KI Pro Online-Events.

- Zugang zum kompletten Archiv der letzten zehn Jahre.

- Die neuesten KI‑Infos von The Decoder – klar und auf den Punkt.