Intel und das Georgia Institute of Technology landen einen Multimillionen-Dollar-Deal: Im Auftrag der Forschungseinrichtung des US-Verteidigungsministeriums DARPA forschen der Tech-Riese und die Universität an KI, die niemand mehr täuschen kann. Das ist nur die Spitze des Eisbergs: Insgesamt zwei Milliarden US-Dollar investiert die DARPA in zahlreiche KI-Projekte. Ich stelle euch diese Mischung aus Grundlagenforschung und Science-Fiction vor.

Die US-Behörde Defense Advanced Research Projects Agency (DARPA) erforscht und fördert seit ihrer Gründung 1957 Zukunftstechnologien. Sie entwickelte die Netzwerktechnologie, die zur Grundlage des Internets wurde, Stealth-Technologie, GPS, war an der ersten Computer-Maus beteiligt und an einem digitalen Assistenten, aus dem Apples Siri entstand. Sie fördert auch die Entwicklung autonomer Mobilität.

In den 1960ern forschte die DARPA an der ersten Form Künstlicher Intelligenz: regelbasierte Systeme, die einfache, festgelegte Aufgaben erledigen konnten – etwa Logistik-Programme oder Schachcomputer. In den 1990ern investierte die Forschungseinrichtung in die Entwicklung lernfähiger Systeme, Maschinenlernen und neuronale Netzwerke. Sie förderte etwa Projekte zur maschinellen Verarbeitung natürlicher Sprache, Navigation und Bilderkennung.

Regelbasierte und lernende KI-Systeme sind seit Jahren etabliert, doch beide haben Einschränkungen. Regelbasierte Systeme sind nicht lernfähig und müssen mühsam per Hand angepasst werden. Lernende KIs benötigen große Mengen Trainingsdaten, sind in ihren Entscheidungen undurchsichtig und schon bei der kleinsten Umweltveränderung nutzlos. Es gibt also viel zu tun.

„Wir ernten die intellektuellen Früchte jahrzehntealter Arbeit“, sagte John Everett, stellvertretender Direktor der Informations- und Innovationsabteilung der DARPA. „Deshalb kümmern wir uns jetzt schon um zukünftige Herausforderungen, deren Lösungen möglicherweise erst in einem Jahrzehnt zum Tragen kommen.“

Die dritte KI-Welle des US-Militärs

DARPA setzt daher auf eine „dritte Welle“ Künstlicher Intelligenz. Zukünftige KI soll schneller lernen und anpassungsfähig, sicher und transparent sein. Sie soll ähnlich lernen und denken wie der Mensch und sich verschiedenen Bedingungen flexibel anpassen.

Im September 2018 startete DARPA daher das „AI Next“ Programm. In fünf Jahren sollen zwei Milliarden US-Dollar in KI-Grundlagenforschung gesteckt werden. Das Geld wird in etablierte Forschungsprojekte und neue Ansätze investiert. Das Ziel: Den Weg für die dritte KI-Welle ebnen und innovative Anwendungsszenarien entwickeln.

Für völlig neue Ansätze setzt die DARPA im „AI Exploration“ Programm auf hip getauftes „Disruptioneering“: Die US-Behörde schreibt Projekte zur Grundlagenforschung öffentlich aus. Jeder Interessent muss innerhalb von 18 Monaten einen Machbarkeitsnachweis erstellen. Dafür winkt eine Förderung von bis zu einer Million US-Dollar.

Aktuelle Forschungsprojekte sollen altbekannte Probleme lösen

Das Ziel der DARPA ist die nächste Generation Künstlicher Intelligenz. Dementsprechend setzen sich nahezu alle aktuellen Forschungsprojekte mit den Kinderkrankheiten derzeitiger KI-Systeme auseinander.

So fördert die DARPA die Entwicklung eines „gesunden Menschenverstands“ für KIs. Sie sollen ein besseres Verständnis der für Menschen selbstverständlichen Eigenschaften und Zusammenhänge der Welt entwickeln. Digitale Assistenten könnten hilfreicher und Roboter selbstständiger werden.

Ein anderes Projekt soll den Datenhunger und die Trainingszeit von KIs reduzieren. Ein Innovationssprung hierbei könnte Chinas Vorteile in einem KI-Wettrennen minimieren und Fortschritt trotz strengerer Datenschutz-Regulierungen ermöglichen.

Weitere Forschungsprogramme sind für KI-Sicherheit vorgesehen: Die Entscheidungen Künstlicher Intelligenz sollen nachvollziehbar werden, außerdem muss sie vor Cyber-Angriffen geschützt sein. Spezialisierte KI-Werkzeuge sollen KI-gefälschte Medien (Deepfakes) aufdecken oder sicherstellen, dass konstant lernende KI-Systeme auch in der echten Welt noch funktionieren.

Weitere Projekte fördern den Einsatz von KI in der Forschung: Software-Entwicklung, Fertigungstechnik, Chemie, Biologie und andere Naturwissenschaften sollen von maschineller Kreativität und besseren Modellen profitieren.

An Hardware wird ebenso geforscht. Genauer: an sogenannter softwaredefinierter Hardware. Die Entwicklung anwendungsspezifischer integrierter Schaltungen (ASICs) wie CPU, GPU oder TPU ist teuer und zeitaufwendig. Während also weltweit an spezialisierten KI-Chips geforscht wird, will die DARPA einen anderen Weg gehen: Es sollen jederzeit konfigurierbare Computer-Chips entstehen, die sich den jeweiligen Anforderungen der Rechenaufgaben anpassen.

Diese Chips sollen ähnlich schnell wie Spezialhardware laufen, aber günstiger sein und schneller entwickelt werden. Der Vorteil dieser Universal-Chips: Neue KI-Systeme könnten andere Herausforderungen an die Hardware-Architektur stellen – die softwaredefinierte Hardware soll sich diesen wenigen Nanosekunden anpassen können.

Moonshot-Projekte könnten aus einem Science-Fiction-Film stammen

Das „AI Exploration“ Programm gibt einen tiefen Einblick in die Anwendungsszenarien und Grundlagenforschung der DARPA. Auf dem Liste stehen improvisierende Roboter, gedankengesteuerte Drohnen und Insektengehirne.

Anpassungsfähige KI-Systeme

Nach einer Einschätzung der DARPA eignen sich aktuelle KI-Systeme nicht für einen Einsatz Seite an Seite mit US-Truppen. Sie seien schlicht noch nicht flexibel genug.

Ted Senator, Programm-Manager bei der DARPA, macht diesen Punkt an einem Schachspiel deutlich: „Stellen sie sich vor, die Regeln für Schach würden in der Mitte des Spiels geändert“, so Senator. „Woher sollte ein KI-System wissen, ob das Brett größer geworden ist, oder ob das Ziel des Spiels nicht mehr darin besteht, den König des Gegners Schachmatt zu setzen, sondern alle seine Bauern zu schlagen? Könnte die KI Veränderung verstehen und sich daran anpassen?“

Im sogenannten SAIL-ON-Programm (“Science of AI and Learning in Open-world Novelty”) will die DARPA daher Algorithmen und Systeme entwickeln, die genau dazu in der Lage sind: Sie sollen Veränderungen in ihrer Umgebung erkennen und darauf flexibel reagieren.

So könnten die Systeme auf militärische Hinterhalte, Wetterumschwünge oder plötzlich zerstörte Straßen reagieren. Dazu sind aktuelle Systeme selbst nach langem Training nicht in der Lage.

SAIL-ON soll so die Grundlage für autonome Fahrzeuge schaffen, die sich an jede neue Umgebung oder Situation anpassen können. Vorbild ist der sogenannte OODA-Zyklus (Beobachten, Orientieren, Entscheiden, Handeln) des Militärs.

Millionenschwere SAIL-ON-Projekte gibt es etwa an der Washington State University oder beim Software-Unternehmen Kitware.

Intelligente Gehirn-Interfaces

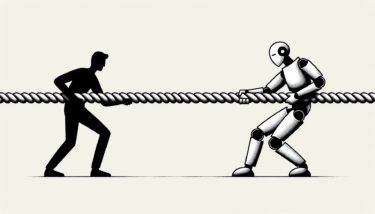

KI-Systeme wie etwa autonome Fahrzeuge sollen jedoch nicht komplett auf sich gestellt sein. Kooperation ist das Ziel: Mensch und KI sollen in Teams arbeiten – egal ob im Alltag, der Industrie oder auf dem Schlachtfeld.

Die DARPA sieht die Zukunft der Interaktion daher in Gehirn-Computer-Schnittstellen (Brain Machine Interfaces – BMIs). Das INI-Programm („Intelligent Neural Interfaces“) soll sie bauen.

Die DARPA forscht seit den 1970er Jahren an solchen Schnittstellen und veranstaltete 2016 das erste gehirngesteuerte Drohnenrennen. 2018 gelang es DARPA-Bioingenieuren, einen Chip zu entwickeln, mit dem ein querschnittsgelähmter Patient in einer Simulation drei vereinfachte F-35 Kampfjets steuerte.

Das INI-Programm soll nun die nächste Generation der Gehirn-Computer-Schnittstellen ermöglichen und Künstliche Intelligenz für ihre Verbesserung einsetzen. Dank KI soll die Schnittstelle mehr Daten übertragen und auslesen können. Das INI-Programm wird ergänzt durch die DARPA-Projekte „Intelligent Spine Interface“ (ISI) und „Next-Generation Nonsurgical Neurotechnology“ (N3), die verschiedene andere Forschungsaspekte an Gehirn-Computer-Schnittstellen beleuchten.

Neben Intel und dem Technologieriesen Teledyne Technologies arbeiten mehrere Universitäten und Universitätskliniken an den DARPA-Projekten.

Photonik-Computer

Neben softwarebasierender Hardware fördert DARPA sogenannte Photonik-Computer. Das PEACH-Programm (“Photonic Edge AI Compact Hardware”) soll KI-Methoden mit photonenbasierten Computer-Chips kombinieren.

Photonik-Computer nutzen Photonen statt Elektronen für Schaltkreise. Die Lichtteilchen sind wesentlich schneller und werden heute schon in Glasfasern für die Datenübertragung eingesetzt.

Erste Prototypen dieser Photonik-Computer gab es bereits in den 1980ern. Heute gibt es neben ersten optischen Quantencomputern auch optische, einfache neuronale Netze. Das PEACH-Programm soll letztere fördern.

Um die Komplexität neuer Photonik-Computer gering zu halten, soll auch an der Komplexität von KI-Algorithmen geforscht werden. Aktuelle Forschung zeige, dass sich die Komplexität neuronaler Netze stark reduzieren lasse – bei gleichbleibender Leistung.

DARPA verspricht sich von der Mischung aus schnellen Photonik-Computern und leistungsfähigen, aber kleinen neuronalen Netzen einen Durchbruch bei der KI-Funktionalität. In der Ausschreibung heißt es, man ziele auf eine drastische Reduzierung der Hardware-Komplexität bei gleichzeitiger Verbesserung der Latenz und des Energieverbrauchs. Die neue Hardware soll nicht mehr von externen Cloud-Computern abhängen und energieeffiziente Echtzeit-KI für kleine, leichte Plattformen wie tragbare Geräte oder Drohnen ermöglichen.

Im August letzten Jahres förderte die DARPA das Tech-Unternehmen Perspecta Labs mit einer Million US-Dollar. Das Unternehmen will die notwendige Grundlagenforschung des PEACH-Projekts in insgesamt 18 Monaten abschließen.

Biomimetische KI-Netzwerke

Auf der Suche nach effizienten KI-Netzwerken richtet die Forschungseinrichtung ihren Blick in die Natur. Das µBRAIN-Programm (“Microscale Bio-mimetic Robust AI Networks”) soll neue, von Insekten inspirierte KI-Architekturen hervorbringen.

Kleine Insekten zeigen teils komplexes und flexibles Verhalten, das in Relation zu ihrer simplen neuronalen Struktur beeindruckt. Selbst Insekten mit wenigen tausend Neuronen lernen und entwickeln komplexe Verhaltensweisen wie Ernährung oder Fortpflanzung

Die Verschmelzung von Kleinstgehirnen und Technologie ist nicht neu: Forscher digitalisierten den Wurm C. Elegans. Dafür simulierten sie den kompletten Wurm inklusive seiner 302 Neuronen und allen Interaktionen zwischen seinen Zellen. Anschließend steckten sie den digitalen Wurm in einen Lego-Roboter – und der Roboter bewegte sich selbstständig durch den Raum.

Schutz vor Angriffen und Täuschung

Das GARD-Programm („Guaranteeing AI Robustness against Deception”) soll KIs vor Manipulation schützen. Bekannte Beispiele für KI-Versagen sind autonome Autos, die leicht veränderte Stoppschilder nicht mehr erkennen oder KIs, die wegen kleiner visueller Abweichungen Objekte völlig falsch identifizieren – zum Beispiel sehen sie statt eines Toasters eine Banane.

Die DARPA will Verteidigungsmechanismen gegen solche einfachen Manipulationen entwickeln. Das Problem: Bisherige Ansätze versuchen, spezifische Angriffe vorherzusehen und die Systeme gegen diese abzusichern. Diese KIs bleiben aber anfällig für Angriffe, die nicht vorhergesehen wurden.

Im GARD-Programm soll daher zunächst ein Verständnis für KI-Schwachpunkte entwickelt werden. Anschließend will die DARPA KI-Systeme mit einer flexibleren Verteidigung gegen variable Angriffe entwerfen. Den Zuschlag für das Projekt bekamen kürzlich Intel und das Georgia Institute of Technology.

Eine Lampe für die Black Box

Aktuelle Versuche, die Black Box KI transparenter zu machen, zielen vor allem auf die Nachvollziehbarkeit der Entscheidungsfindung ab. Im Zweifel soll der Mensch verstehen können, wie eine KI zu einem Urteil gekommen ist.

Für die DARPA geht das in zeitkritischen Situationen nicht weit genug. Im CAML-Programm („Competency-Aware Machine Learning“) soll eine sich selbsteinschätzende KI entwickelt werden.

Die soll sich ihrer eigenen Kompetenzen bewusst sein und so selbst bewerten können, ob sie eine Aufgabe zufriedenstellend lösen kann.

Die DARPA sieht eine KI-Selbsteinschätzung als notwendigen Schritt, um aus KIs vertrauenswürdige und kooperative Partner für Menschen zu machen. Inspiriert ist die Idee von menschlicher Kooperation: Auch hier ist ein entscheidendes Element erfolgreichen kooperativen Handelns die kritische Selbsteinschätzung.

Zuschläge für das CAML-Projekt in Höhe von mehreren Millionen US-Dollar gingen etwa an die Forschungsorganisation SRI International, den Teledyne Technologies und den Rüstungskonzern BAE Systems Elecontric Systems.

Science-Fiction wird zu Grundlagenforschung

Auch wenn viele der hier vorgestellten Ideen bereits theoretische oder empirische Grundlagen haben –die „AI Exploration“-Programme werden wohl zu keinem sprunghaften Fortschritt führen. Sie könnten aber die Grundlagen dafür schaffen. Denn auch Misserfolge sind in der Wissenschaft wertvoll: Wissen, was nicht geht, ist auch Wissen.

Ein gutes Beispiel dafür ist DARPAs „Grand Challenge“. Der Wettbewerb für autonome Landfahrzeuge fand zwischen 2004 und 2007 dreimal statt. In der ersten Runde 2004 setzten die Teilnehmer auf die regelbasierten Systeme der ersten KI-Welle. Das Ergebnis: Kein Fahrzeug schaffte es weiter als zwölf Kilometer durch die Wüste.

Der Misserfolg führte zu einem Umdenken: Ein Jahr später fand der Wettbewerb erneut statt. Fünf Fahrzeuge fuhren die Strecke von 213 Kilometern durch – alle Gewinner setzten auf die zweite Welle KI-Technik: Maschinenlernen.

Die „Grand Challenge“ startete als Experiment und zog großes Interesse, Investitionen und Forschung nach sich. Viele Teilnehmer arbeiteten später an Googles selbstfahrendem Auto. Eine Dekade später sind die ersten autonomen Autos auf unseren Straßen unterwegs.

Titelbild: DARPA, Screenshot aus YT-Video