Dieser Deepmind-Burger macht Appetit auf Künstliche Intelligenz

Künstliche Intelligenz kennt keine Emotionen. Das bedeutet aber nicht, dass sie keine erzeugen kann. Beispielsweise mit einem Bild eines saftigen Burgers.

Forscher aus Googles KI-Abteilung Deepmind veröffentlichen eine wissenschaftliche Arbeit (Peer-Review steht aus) zu Fortschritten bei der automatischen KI-Generierung von Bildern (512 x 512 Pixel) mit komplexen Inhalten.

Zum Einsatz kommen sogenannte für Bildgenerierung optimierte GAN-Netze (Generative Adversarial Network). Zwei KI-Agenten kooperieren: Einer erstellt ein Bild, der andere prüft es auf Überzeugungskraft. Die beiden Agenten spielen ein Bild hin und her, bis es realistisch aussieht. Erst dann wird es veröffentlicht.

Viele KI-Fakes der letzten Monate wurden mit GANs erstellt. Die Methode ist fast im Alleingang für die großen Fortschritte bei der KI-Bildgenerierung verantwortlich.

Die Deepmind-Forscher beanspruchen für sich, mit dem bislang komplexesten Aufbau eines GAN-Netzwerks mit mehr Parametern deutlich realistischere Bilder generieren zu können als im Vergleich einfacher gestrickte Netzwerke. Unter anderem verwendeten die Forscher 2048 Trainingsbilder pro Durchgang statt üblichen 256.

Beim Inception-Test, einem gängigen Benchmark für Bildgenerierungsverfahren, erzielte das komplexe GAN-Netz einen Wert von 166,3 Punkten - der bisherige Bestwert lag bei 52,52 Punkten. Der Inception-Test bewertet den Realitätsgrad der erzeugten Bilder.

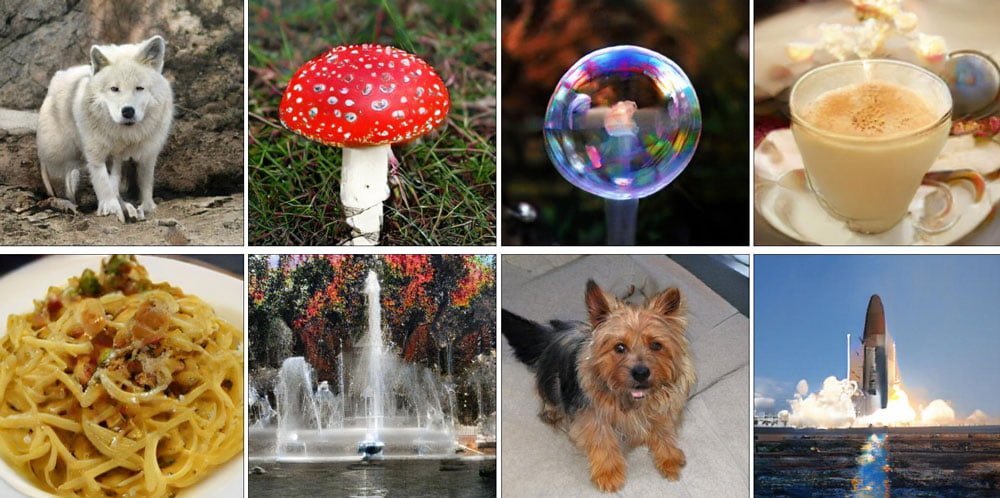

Die Forscher loben ihr Modell als neuen Qualitätsstandard bei mit ImageNet-Bildern trainierten GAN-Netzwerken. In der Tat sind einige der im Paper gezeigten Beispielfotos kaum mehr von realen Fotos zu unterscheiden:

Zur Erinnerung: Vor rund drei Jahren sahen solche KI-generierten Fake-Fotos noch wie folgt aus:

KI-News ohne Hype – von Menschen kuratiert

Mit dem THE‑DECODER‑Abo liest du werbefrei und wirst Teil unserer Community: Diskutiere im Kommentarsystem, erhalte unseren wöchentlichen KI‑Newsletter, 6× im Jahr den "KI Radar"‑Frontier‑Newsletter mit den neuesten Entwicklungen aus der Spitze der KI‑Forschung, bis zu 25 % Rabatt auf KI Pro‑Events und Zugriff auf das komplette Archiv der letzten zehn Jahre.

Jetzt abonnierenKI-News ohne Hype

Von Menschen kuratiert.

- Mehr als 16 % Rabatt.

- Lesen ohne Ablenkung – keine Google-Werbebanner.

- Zugang zum Kommentarsystem und Austausch mit der Community.

- Wöchentlicher KI-Newsletter.

- 6× jährlich: “KI Radar” – Deep-Dives zu den wichtigsten KI-Themen.

- Bis zu 25 % Rabatt auf KI Pro Online-Events.

- Zugang zum kompletten Archiv der letzten zehn Jahre.

- Die neuesten KI‑Infos von The Decoder – klar und auf den Punkt.