Update vom 20. April 2024:

Grok hat Nutzerbeiträge über die schlechte Trefferquote des NBA-Spielers Klay Thompson in einem Spiel missinterpretiert. Thompson hatte in einem NBA-Spiel keinen seiner zehn Würfe getroffen.

X-Nutzer sprachen daraufhin metaphorisch davon, dass Thompson "Ziegelsteine werfe", im Sinne von Fehlwürfen. Grok machte daraus die Geschichte, dass Thompson Häuser in Sacramento mit Ziegelsteinen beschädige und platzierte die fehlerhafte Meldung auf Platz fünf der Trending-Liste.

Der Chatbot erfand zahlreiche Details, zum Beispiel, dass Fenster zu Bruch gegangen seien, dass die Behörden den Fall bereits untersuchten und Thompson sich bisher nicht dazu geäußert habe. Der Vorfall habe die Menschen erschüttert, es habe keine Verletzten gegeben. Das Motiv sei unklar.

X weist zwar darauf hin, dass die auf Grok basierende Nachrichtenfunktion Fehler generieren kann. Ob dies rechtlich eine ausreichende Rechtfertigung für Lügen über Prominente und andere Fake News sein kann, ist unwahrscheinlich.

Ursprünglicher Artikel vom 15. April 2024:

Elon Musks KI-Chatbot Grok macht aus Scherz-Posts Nachrichten und verbreitet Desinformation und Verschwörungstheorien. Erste Erfahrungsberichte zeigen gravierende Probleme.

Als Alleinstellungsmerkmal nutzt Grok Beiträge von X-Nutzern, um Informationen über aktuelle Ereignisse vermeintlich aus erster Hand zu generieren. Laut Musk ein großer Vorteil. Doch genau das führt zu bizarren Fake-News-Meldungen.

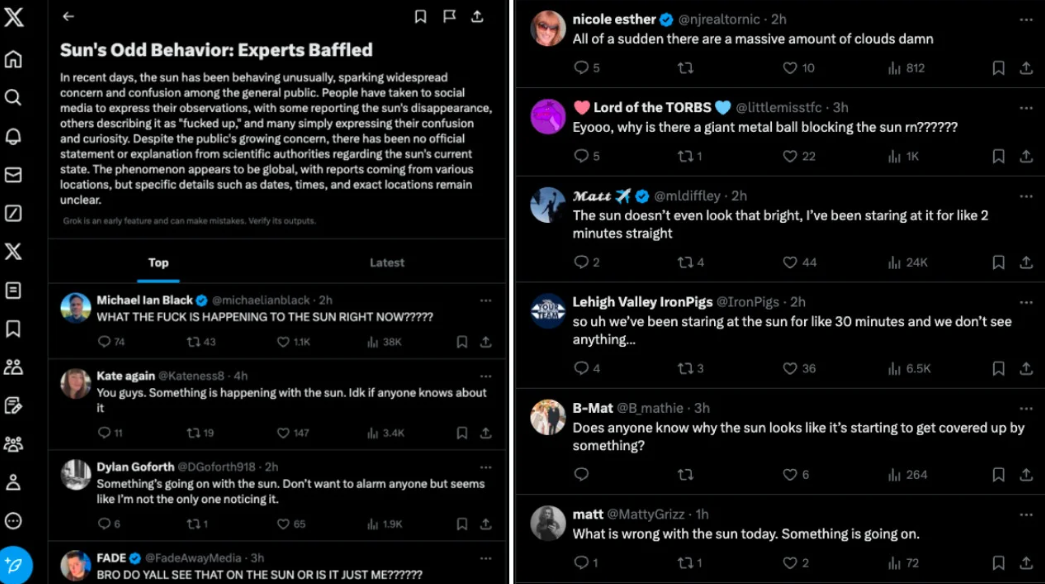

Ein Beispiel: Tausende X-Nutzer posteten am vergangenen Montag Witze darüber, warum die Sonne während einer Sonnenfinsternis "verschwunden" sei. Grok fasste diese Witze zu einer Meldung zusammen, wonach sich Experten über das "ungewöhnliche Verhalten" der Sonne wundern würden - eine vollkommen absurde Behauptung, schließlich sind Sonnenfinsternisse ein vorhersehbares astronomisches Phänomen.

In einem anderen Fall fiel Grok auf einen Scherz von X-Benutzern herein, die behaupteten, der Bürgermeister von New York würde Tausende Polizist in die U-Bahn-Stationen schicken, um das Erdbeben zu erschießen, bevor es sich wiederholt.

Nicht nur harmlose Witze werden von Grok missverstanden: Auch zu Themen wie dem Krieg zwischen Israel und Palästina oder der Verschwörungstheorie "Pizzagate" erfindet der Chatbot falsche Chronologien und verleiht abstrusen Theorien Glaubwürdigkeit.

In einem weiteren Fall generierte Grok die Schlagzeile "Iran greift Tel Aviv mit schweren Raketen an". Grundlage waren offenbar Spekulationen von X über einen möglichen Angriff. Tatsächlich gab es aber zu diesem Zeitpunkt keinen Angriff des Iran auf Israel, wie Grok fälschlicherweise behauptete.

Zur "Pizzagate"-Verschwörungstheorie über einen Kinderpornoring hochrangiger Politiker wie Hillary Clinton antwortete Grok ausweichend. Es gebe zwar keine konkreten Beweise, aber "seltsame Zufälle", die Verschwörungstheorien nährten - eine Formulierung, die entgegen der Faktenlage einen wahren Kern suggeriert.

Der Musk-typische überstürzte und rücksichtslose Rollout von Grok bei X zeigt die Schwächen von generativer KI auf Autopilot: Sie kann sehr überzeugend klingen, ohne auch nur ansatzweise in der Realität verankert zu sein. Grok zeigt auch, warum sich Firmen wie Google oder OpenAI so intensiv mit Sicherheitsrichtlinien beschäftigen - weil sie noch Respekt vor Fakten und Wahrheit haben.