Drei neue Anwendungen zeigen, dass große Sprachmodelle (large language model, LLM) viel mehr sind als Textgeneratoren.

Der Entwickler Dwarkesh Patel verwendet OpenAIs "embeddings"-API für eine semantische Suche in eBooks. Ein Embedding ist eine informationsdichte Darstellung der Bedeutung eines Textstücks.

Diese Repräsentation macht sich Patel zunutze für eine Textsuche in Büchern, die Buchstellen etwa anhand einer szenischen Beschreibung ("Charakter A und Charakter B begegnen sich") oder anhand von Fragen durchsuchen kann.

Die semantische Suche ist deutlich flexibler als die herkömmliche Strg+F-Suchfunktion für eBooks, die Textstellen nur bei exakter Übereinstimmung mit dem Suchbefehl ausgibt. Patel zeigt das in einem kurzen Demovideo.

I read a lot of books for my podcast & blog.

But often I can't finding the particular passage I'm looking for.

Ctrl-F doesn't work unless you know the exact phrase.

So I built search for ebooks using OpenAI's embeddings API.

Link below to use.

Works surprisingly well! pic.twitter.com/UFDjDhZ507

— Dwarkesh Patel (@dwarkesh_sp) October 30, 2022

Eine Demoversion der Embeddings-Suche für eBooks stellt Patel bei Google Colab zur Verfügung.

Natürliche Sprache für die Excel-Steuerung

Der Entwickler Shubhro Saha zeigt eine weitere Einsatzmöglichkeit für GPT-3: Er verbindet die API mit Sheets, Googles Online-Version von Excel. Über natürliche Sprachbefehle in den Tabellenspalten kann er Sheets Aufgaben zuweisen, die er ansonsten in Sheet-Code schreiben müsste, etwa das Extrahieren einer Postleitzahl aus einer Adresszeile. Dafür genügt die Frage: "Welche Postleitzahl hat diese Adresse?".

GPT-3 kann zudem direkt in Sheets anhand von Inhalten in verschiedenen Spalten ein Ergebnis in eine neue Spalte schreiben. Aus einem Namen und einer kurzen Liste an zu erwähnenden Punkten kann GPT-3 so etwa Text für eine Dankeskarte erstellen.

This weekend I built =GPT3(), a way to run GPT-3 prompts in Google Sheets.

It's incredible how tasks that are hard or impossible to do w/ regular formulas become trivial.

For example: sanitize data, write thank you cards, summarize product reviews, categorize feedback... pic.twitter.com/4fXOTpn2vz

— Shubhro Saha (@shubroski) October 31, 2022

Sahas Beispiel zeigt allerdings auch die größte Schwachstelle großer Sprachmodelle neben sozialen und kulturellen Verzerrungen: Die Systeme sind zu unzuverlässig für Aufgaben, bei denen Präzision die oberste Prämisse ist.

Bei dem zuvor genannten Postleitzahlen-Beispiel etwa versagt selbst das größte GPT-3-Modell "text-davinci-002" in einzelnen Fällen und fantasiert falsche Zahlenfolgen in die Spalten. Eigens für diesen Zweck entwickelte Plugins oder klassische Programmierbefehle sind in diesem Szenario verlässlicher.

Good catch.

It's likely because the original video's data sanitization formula used 'text-curie-001', which is a smaller model.

Here it is with the formula explicitly set to a larger model, 'text-davinci-002'.

Seems to work better: pic.twitter.com/EtvZyJVgY3

— Shubhro Saha (@shubroski) October 31, 2022

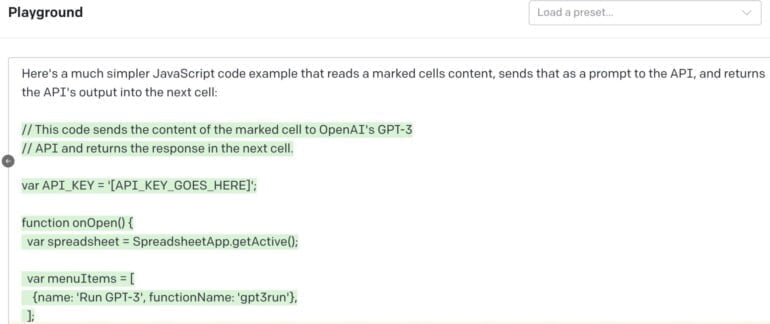

Wer Interesse an Sahas Software "GPT3()" hat, kann es hier bekunden. Eine Alternative ist dieses vorausgefüllte Google Doc von Fabian Stelzer. Es beinhaltet den Javascript-Code, der die GPT-3-API mit der Google-Software verbindet. Die Besonderheit: Stelzer kann laut eigenen Angaben nicht programmieren und ließ den Verbindungscode ebenfalls von GPT-3 generieren.

Die Programmierfähigkeit des großen Sprachmodells macht sich auch Zahid Khawaja für sein "ToolBot" zunutze, der anhand einer natürlichen Spracheingabe eine auf GPT-3-basierte prototypische App erstellt.

Ein Nutzer gibt per Prompt eine App-Idee ein, aus der ToolBot dann eine einfache Benutzeroberfläche mit Texteingabefeld generiert, das eine weitere Nutzereingabe mit der vorherigen Eingabe für die App-Idee in einem zusammengeführten Prompt verarbeitet.

Introducing ToolBot 🤖 — an app that generates custom GPT-3 tools using plain English.

This is a ridiculously easy way to prototype different GPT-3 tools. It's especially useful for end users who want to explore the potential of LLMs.

If this sounds interesting, let me know. pic.twitter.com/48R1q6OoeD

— Zahid Khawaja (@chillzaza_) October 26, 2022

Khawaja hat ToolBot laut eigenen Angaben insbesondere für Personen entwickelt, die GPT-3 umfänglich nutzen wollen, sich aber nicht mit der Erstellung von Benutzeroberflächen oder dem Prompt Engineering auskennen. Sie können ihr generiertes Tool speichern und per Link teilen.