Facebooks neue Bild-KI kann eure Fotos besser lesen

Facebook verbessert die Bildanalyse-KI für die eigenen sozialen Netzwerke: Sie kann Inhalte auf Fotos jetzt genauer beschreiben. Das hilft blinden und sehbehinderten Menschen ebenso wie Facebooks Werbemaschine.

In Facebooks News Feeds wimmelt es von Bildern, die Anlass sind für Gespräche. Blinde oder sehbehinderte Menschen können die Bilder zwar nicht oder nicht im Detail erkennen. Dafür können sie sich den Bildbeschreibungstext vorlesen lassen - sofern der Bild-Hochlader diesen hinterlegt hat.

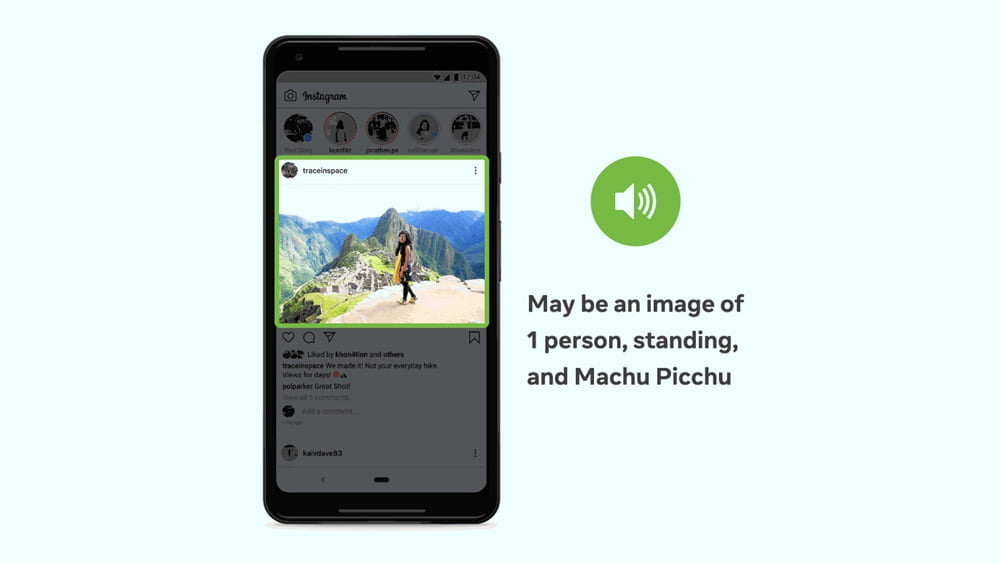

Das ist leider nur selten der Fall, weshalb Facebook seit 2016 eine Deep Learning-Software für die automatische Generierung von Bildbeschreibungstexten einsetzt. Die Software scannt ein Bild und liefert dazu eine einfache Beschreibung wie: "Ein Mann steht auf einer Wiese."

Diesen maschinellen Beschreibungen fehlt es häufig an Details und somit an Kontext, damit Menschen, die das Bild nicht sehen können, es inhaltlich dennoch verstehen. Jetzt stellt Facebook eine neue Generation einer Bildanalyse-KI vor, die Bilder deutlich genauer beschreiben kann als das bisherige Modell.

KI lernt, Bilder zu verstehen

Die neue KI-Generation kennt viel mehr Konzepte, die sie in einem Bild entdecken und beschreiben kann. Ein Konzept ist beispielsweise "ein Baum" oder "ein Berg". Die erste Bildbeschreibungsautomatik 2016 kannte rund 100 solcher Konzepte, die neue KI erkennt mehr als 1.200 - mit laut Facebook einer ebenfalls hohen Genauigkeit.

Dadurch werden die Bildbeschreibungen detaillierter: Die KI kann Aktivitäten erkennen, bekannte Orte oder Tierrassen. Eine mögliche Bildbeschreibung wäre beispielsweise: "Wahrscheinlich ein Selfie von zwei Menschen, draußen, vor dem Schiefen Turm von Pisa."

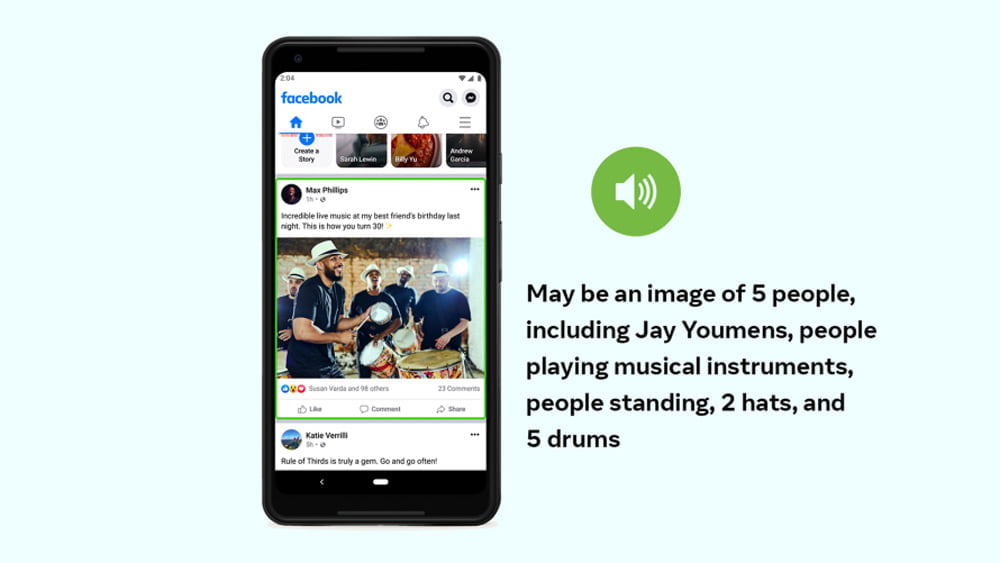

Laut Facebook ist die Bildanalyse-KI die erste, die Objekte auf einem Bild verorten und ihre Größe beschreiben kann, etwa ein Berg im Verhältnis zu einem Haus.

Anstatt nur festzustellen, dass fünf Menschen auf einem Foto abgebildet sind, beschreibt die KI, wo sie sich im Bild befinden: in der Bildmitte, an den Seiten oder im Vorder- oder Hintergrund. Auch das gibt Aufschluss über die Szene und somit die inhaltliche Bedeutung der einzelnen Bildelemente.

Instagram-Nutzer helfen beim KI-Training

Die bessere Bildanalyse-KI erreicht Facebook durch effizienteres KI-Training: Anstatt auf von Menschen detailliert beschriftete Bilderdatenbanken zurückzugreifen (überwachtes Lernen), nutzte das Unternehmen Milliarden Bilder von Instagram, die mit Hashtags versehen sind. Das Hashtag beschreibt oder kommentiert den Bildinhalt mit wenigen Wörtern (schwach überwachtes Lernen).

Trotz der reduzierten menschlichen Beschreibung erzielt Facebooks KI in gängigen Bilderkennungs-Benchmarks eine hohe Genauigkeit, da durch den Instagram-Zugriff viel mehr Daten für das Training verwendet werden konnten. Die neue KI ist daher ein anschauliches Beispiel, wie Facebook die eigenen Nutzerdaten für bessere Künstliche Intelligenz verwendet - ähnlich könnte es bei VR-Daten laufen.

Klar ist, dass die KI-Bildanalyse für blinde und sehbehinderte Menschen ein großer Zugewinn sein kann. Sie können Bilder besser verstehen und sich so stärker auf den Plattformen einbringen.

Ebenso profitiert Facebooks Werbemaschine von der Bildanalyse, weil die KI über die Bildinformationen mehr Datenkontext für noch genauere Nutzerprofile generiert, selbst dann, wenn diese Information nicht explizit im Text zu einem Bild oder in der Bildbeschreibung hinterlegt ist.

Quelle: Facebook

KI-News ohne Hype – von Menschen kuratiert

Mit dem THE‑DECODER‑Abo liest du werbefrei und wirst Teil unserer Community: Diskutiere im Kommentarsystem, erhalte unseren wöchentlichen KI‑Newsletter, 6× im Jahr den "KI Radar"‑Frontier‑Newsletter mit den neuesten Entwicklungen aus der Spitze der KI‑Forschung, bis zu 25 % Rabatt auf KI Pro‑Events und Zugriff auf das komplette Archiv der letzten zehn Jahre.

Jetzt abonnierenKI-News ohne Hype

Von Menschen kuratiert.

- Mehr als 16 % Rabatt.

- Lesen ohne Ablenkung – keine Google-Werbebanner.

- Zugang zum Kommentarsystem und Austausch mit der Community.

- Wöchentlicher KI-Newsletter.

- 6× jährlich: “KI Radar” – Deep-Dives zu den wichtigsten KI-Themen.

- Bis zu 25 % Rabatt auf KI Pro Online-Events.

- Zugang zum kompletten Archiv der letzten zehn Jahre.

- Die neuesten KI‑Infos von The Decoder – klar und auf den Punkt.