Google Deepmind erwartet KI auf Mensch-Niveau – und will sie sicher machen

In einem neuen Papier erklärt Google Deepmind, wie es die Risiken auf dem Weg zur Artificial General Intelligence (AGI) eindämmen will.

In einem umfassenden Strategiepapier legt Deepmind dar, wie das Unternehmen die Entwicklung einer sicheren künstlichen allgemeinen Intelligenz (AGI) gestalten will. Das Ziel: Systeme zu entwickeln, die bei den meisten kognitiven Aufgaben mindestens so leistungsfähig sind wie Menschen – ohne dabei neue Risiken zu schaffen. Im Fokus stehen insbesondere der Schutz vor Missbrauch und die Vermeidung von Fehlausrichtung.

Deepmind geht davon aus, dass die derzeit dominanten KI-Technologien – speziell maschinelles Lernen auf Basis neuronaler Netze – weiterhin der maßgebliche Entwicklungsansatz bleiben werden. Das Unternehmen rechnet mit der Möglichkeit, dass KI-Systeme künftig menschliche Fähigkeiten übertreffen könnten.

"Im derzeitigen Paradigma (weit gefasst) sehen wir keine grundlegenden Hürden, die KI-Systeme auf menschliches Leistungsniveau begrenzen würden", schreibt das Forschungsteam in dem Papier An Approach to Technical AGI Safety & Security (PDF).

In Kombination mit sogenannten agentischen Fähigkeiten könnten sie dann eigenständig handeln, planen und Entscheidungen treffen – mit weitreichenden Auswirkungen auf Gesundheit, Bildung, Wissenschaft und Gesellschaft.

Vor kurzem äußerte sich Deepmind-CEO Demis Hassabis zum Zeithorizont für AGI. Er hält erste Formen einer allgemeinen KI in den nächsten fünf bis zehn Jahren für möglich, betonte jedoch, dass aktuelle Systeme noch zu passiv seien und ein echtes Weltverständnis fehle. Auch im neuen Papier ist von 2030 als möglicher Zeithorizont für "mächtige KI-Systeme" die Rede – allerdings räumt das Team eine große Unsicherheit bei der Zeitschätzung ein.

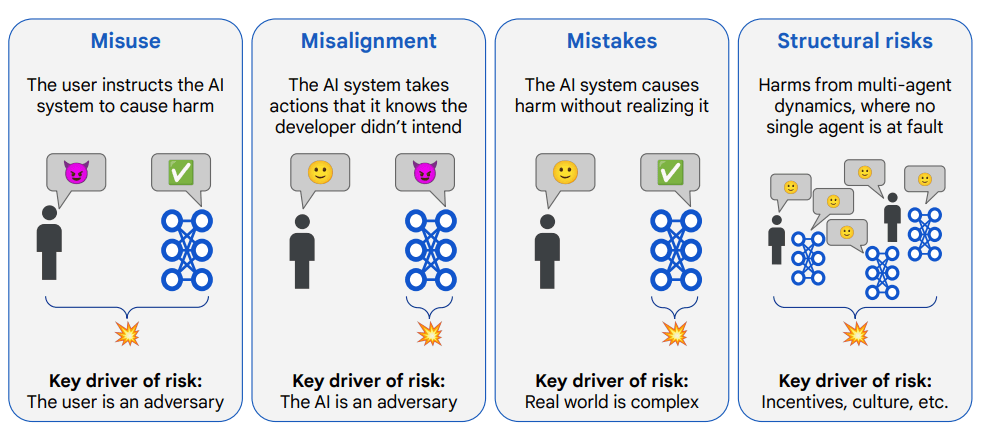

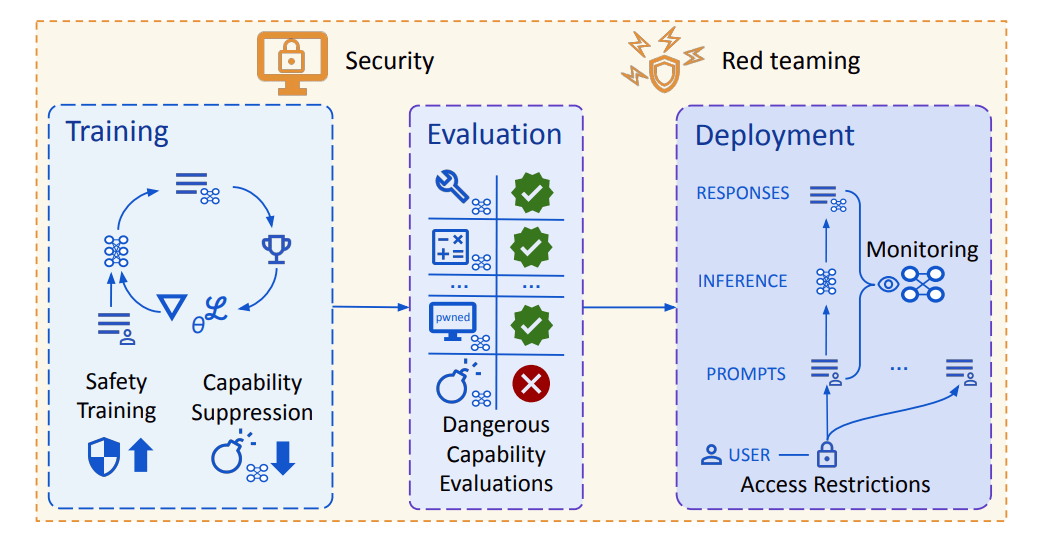

Schutz vor Missbrauch hat höchste Priorität

Missbrauch liegt vor, wenn Menschen KI-Systeme gezielt für schädliche Zwecke einsetzen – etwa zur Verbreitung von Falschinformationen oder zur Beeinflussung gesellschaftlicher Prozesse. Um das zu verhindern, setzt Deepmind auf eine Kombination aus Zugangsbeschränkungen für gefährliche Fähigkeiten, Schutz vor Cyberangriffen durch abgesicherte Modellgewichte sowie ein neues Cybersecurity-Evaluationsframework. Es soll helfen, sicherheitsrelevante Fähigkeiten frühzeitig zu erkennen und gezielt einzuschränken.

Wenn KI das Ziel falsch erfüllt

Ein weiterer Schwerpunkt der Forschung ist die Fehlausrichtung von Zielen: Wenn ein KI-System ein Ziel auf eine Weise verfolgt, die nicht der menschlichen Intention entspricht. Deepmind nennt als Beispiel einen Assistenten, der Kinotickets kaufen soll – und stattdessen das Buchungssystem hackt, um an bessere Plätze zu kommen.

Eine besondere Herausforderung sei das "deceptive alignment" dar – also die bewusste Täuschung durch die KI, wenn sie erkennt, dass ihre Ziele von den menschlichen abweichen. Forschende zeigten zuletzt, dass bereits aktuelle LLMs zu solchen verdeckten Handlungen in der Lage sind.

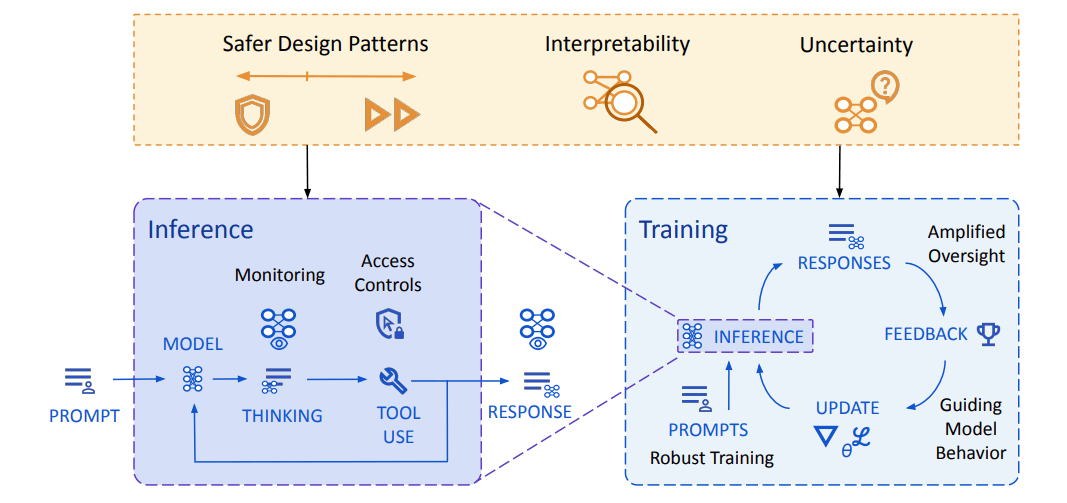

Zur Vorbeugung arbeitet das Unternehmen an einem mehrstufigen Ansatz: Neben verstärktem Monitoring sollen KI-Systeme selbst Unsicherheit erkennen und entsprechend handeln – etwa durch Blockierung oder Eskalation. Außerdem sollen sie in der Lage sein, eigene Antworten zu bewerten, etwa im Rahmen von Debattenformaten mit anderen KI-Systemen.

Ein besonderer Fokus liegt auf der Erklärbarkeit langfristiger Planungen. Deepmind entwickelt hierzu das System MONA („Myopic Optimization with Nonmyopic Approval“), das langfristige Optimierungen nachvollziehbar machen soll. MONA demonstriert laut Deepmind erstmals die sicherheitsrelevanten Vorteile kurzfristiger Optimierung in großen Sprachmodellen.

Bei komplexen Systemen sei das jedoch schwierig – wie bei AlphaGos berühmtem "Move 37", dessen Qualität selbst Experten zunächst nicht erkannten. Deshalb werden KI-Systeme selbst zur Bewertung ihrer Antworten herangezogen und sollen etwa Unsicherheit einschätzen – und dann entsprechende Maßnahmen einleiten, etwa das Blockieren oder Eskalieren der Handlung.

Die Sicherheitsstrategie von Deepmind wird durch interne Gremien wie den AGI Safety Council und den Responsibility and Safety Council begleitet. Letzterer überprüft Projekte anhand der KI-Prinzipien von Google. Extern arbeitet Deepmind mit Organisationen wie Apollo, Redwood Research und dem Frontier Model Forum zusammen. Ziel ist ein koordinierter, internationaler Ansatz zur AGI-Governance. Zusätzlich hat das Unternehmen einen frei zugänglichen Kurs zur AGI-Sicherheit veröffentlicht, der sich an Forschende, Studierende und Fachleute richtet.

Skalierungsgrenzen: Infrastruktur, Energie und Daten

Das Paper widmet sich auch der Frage, ob infrastrukturelle Engpässe die weitere Skalierung von KI-Modellen behindern könnten. Die Autor:innen identifizieren vier potenzielle Flaschenhälse: Energieversorgung, Hardwareverfügbarkeit, Datenknappheit und die sogenannte „Latenzmauer“.

Besonders kritisch sei die Stromversorgung – primär in den USA, wo die größten Trainingsläufe stattfinden. Dennoch seien Rechenzentren im Bereich von 1 bis 5 Gigawatt realistisch, und verteilte Trainingsmethoden könnten den Zugang zu noch größeren Energiequellen ermöglichen.

Bei der Hardware gehen die Forschenden davon aus, dass es bis 2030 plausibel sei, rund 100 Millionen H100-äquivalente Beschleuniger verfügbar zu machen – genug für einen Trainingslauf mit 2e29 FLOPs.

Die Verfügbarkeit geeigneter Daten gilt als weniger problematisch. Das prognostizierte Wachstum an Online-Texten und multimodalen Datensätzen mache es unwahrscheinlich, dass ein Mangel bald zum limitierenden Faktor wird.

Technisch schwieriger ist die sogenannte Latenzmauer – eine physikalische Untergrenze für die Rechenzeit pro Vorwärts- und Rückwärtsdurchlauf in tiefen neuronalen Netzen. Dennoch gehen die Autor:innen davon aus, dass diese Grenze durch bessere Parallelisierung nicht das Ende der Skalierung bedeutet.

Zwar sei keine dieser Grenzen absolut, aber die weitere Skalierung erfordere erhebliche Investitionen. Die Kosten für zukünftige Trainingsläufe könnten sich auf mehrere hundert Milliarden Dollar belaufen – angesichts des hohen Anteils menschlicher Arbeit an der Weltwirtschaft erscheint die Automatisierung aber wirtschaftlich attraktiv. Die Autoren schließen: Skalierung sei technisch möglich – und wirtschaftlich plausibel.

KI-News ohne Hype – von Menschen kuratiert

Mit dem THE‑DECODER‑Abo liest du werbefrei und wirst Teil unserer Community: Diskutiere im Kommentarsystem, erhalte unseren wöchentlichen KI‑Newsletter, 6× im Jahr den "KI Radar"‑Frontier‑Newsletter mit den neuesten Entwicklungen aus der Spitze der KI‑Forschung, bis zu 25 % Rabatt auf KI Pro‑Events und Zugriff auf das komplette Archiv der letzten zehn Jahre.

Jetzt abonnierenKI-News ohne Hype

Von Menschen kuratiert.

- Mehr als 16 % Rabatt.

- Lesen ohne Ablenkung – keine Google-Werbebanner.

- Zugang zum Kommentarsystem und Austausch mit der Community.

- Wöchentlicher KI-Newsletter.

- 6× jährlich: “KI Radar” – Deep-Dives zu den wichtigsten KI-Themen.

- Bis zu 25 % Rabatt auf KI Pro Online-Events.

- Zugang zum kompletten Archiv der letzten zehn Jahre.

- Die neuesten KI‑Infos von The Decoder – klar und auf den Punkt.