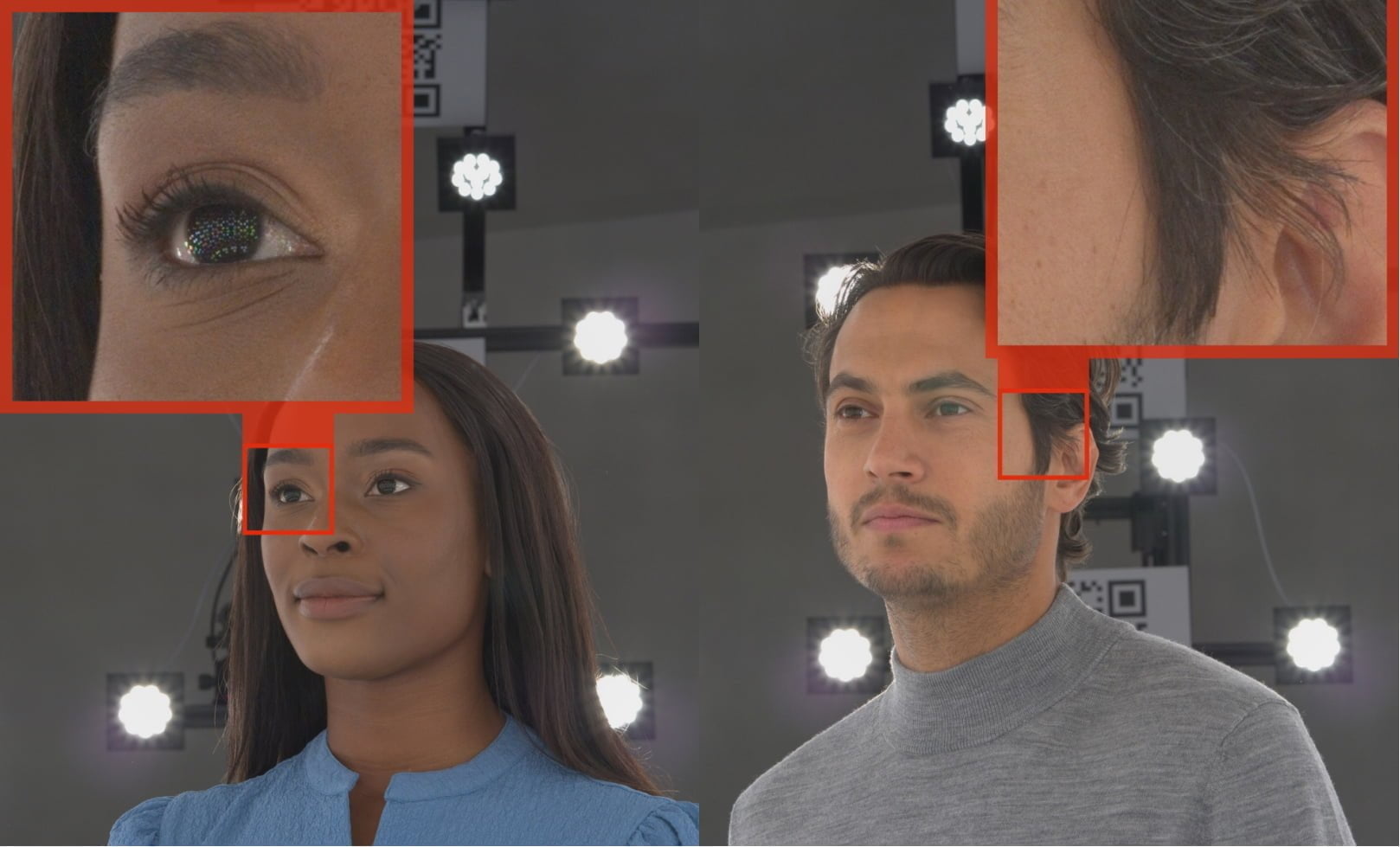

HumanRF ermöglicht fotorealistische 3D-Avatare

HumanRF bringt hochauflösende 3D-Avatare in NeRFs. Dahinter steht ein KI-Startup für synthetische Medien.

Neural Radiance Fields (NeRFs) lernen 3D-Darstellungen aus Fotos oder Videos und können einzelne Objekte oder ganze Szenen wiedergeben. Einige Varianten spezialisieren sich auf bewegte Szenen oder Objekte, andere experimentieren mit Editierfähigkeiten und wieder andere versuchen, Menschen fotorealistisch darzustellen. NeRFs gelten als eine der KI-Technologien, die in 3D-Grafiken, Videokonferenzen oder in Zukunft im Metaverse eine wichtige Rolle spielen werden.

Forschende von Sytnhesia, einem KI-Start-up für synthetische Medien, des UCL London und der TU München stellen nun HumanRF vor, eine Methode, mit der hochauflösende NeRFs von sich bewegenden Menschen gelernt werden können.

ActorsHQ-Datensatz liefert die Grundlage für die beeindruckenden Ergebnisse

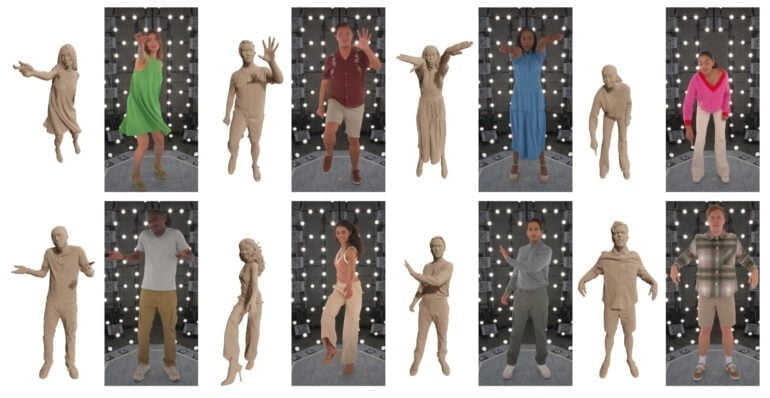

Das Team trainiert HumanRF mit einem eigenen Datensatz. ActorsHQ besteht aus 39.765 Einzelbildern dynamischer menschlicher Bewegungen, die mittels Multi-View-Video aufgenommen wurden. Das Team verwendete ein proprietäres Multi-Kamera-Aufnahmesystem in Kombination mit einem LED-Array für die globale Beleuchtung. Das Kamerasystem besteht aus 160 Ximea-Kameras mit 12 MP, die mit 25 Bildern pro Sekunde arbeiten, und einem Beleuchtungsarray mit 420 LEDs.

Damit liefert ActorsHQ deutlich höher aufgelöste Daten als ältere Datensätze, die eine maximale Auflösung von 4 MP erreichen. Der Datensatz umfasst vier weibliche und vier männliche Personen, die 20 zufällig ausgewählte Bewegungen ausführen.

HumanRF kann auch lange Bewegungssequenzen in hoher Qualität lernen

Mit HumanRF stellt das Team eine NeRF-Methode vor, die diese hochaufgelösten Daten erfasst und zeitlich konsistente Rekonstruktionen der menschlichen Akteure auch für lange Sequenzen erhält und gleichzeitig hochaufgelöste Details darstellen kann. Das Team orientiert sich dabei an Nvidias Instant-NGP, erweitert aber die dort verwendeten Kodierungen um eine zusätzliche Dimension.

Die Ergebnisse sind beeindruckend, und das Team hofft, dass HumanRF und der ebenfalls veröffentlichte Datensatz ActorsHQ weitere Fortschritte bei der fotorealistischen Rekonstruktion virtueller Menschen ermöglichen werden. In Zukunft will das Team nach Methoden suchen, um Kontrolle über die Artikulation der gelernten Schauspieler:innen auszuüben. Damit könnte Synthesia in die eigenen Produkte von einfachen 2D-Aufnahmen zu dynamischen 3D-Avataren weiterentwickeln.

Den Code und Datensatz will das Team auf der HumanRF-Projektseite verfügbar machen. Dort gibt es auch mehr Informationen und Beispiele.

Wer mehr über NeRFs erfahren will, kann sich unsere DEEP MINDS Folge #8 mit Nvidia-Forscher Thomas Müller anschauen. Müller ist Autor von Instant-NGP.

KI-News ohne Hype – von Menschen kuratiert

Mit dem THE‑DECODER‑Abo liest du werbefrei und wirst Teil unserer Community: Diskutiere im Kommentarsystem, erhalte unseren wöchentlichen KI‑Newsletter, 6× im Jahr den „KI Radar"‑Frontier‑Newsletter mit den neuesten Entwicklungen aus der Spitze der KI‑Forschung, bis zu 25 % Rabatt auf KI Pro‑Events und Zugriff auf das komplette Archiv der letzten zehn Jahre.

Jetzt abonnierenKI-News ohne Hype

Von Menschen kuratiert.

- Mehr als 20 Prozent Launch-Rabatt.

- Lesen ohne Ablenkung – keine Google-Werbebanner.

- Zugang zum Kommentarsystem und Austausch mit der Community.

- Wöchentlicher KI-Newsletter.

- 6× jährlich: „KI Radar“ – Deep-Dives zu den wichtigsten KI-Themen.

- Bis zu 25 % Rabatt auf KI Pro Online-Events.

- Zugang zum kompletten Archiv der letzten zehn Jahre.

- Die neuesten KI‑Infos von The Decoder – klar und auf den Punkt.