Ein IBM-Forschungsteam untersucht, wie effektiv generative KI beim Social Engineering und beim Verfassen von Phishing-E-Mails ist.

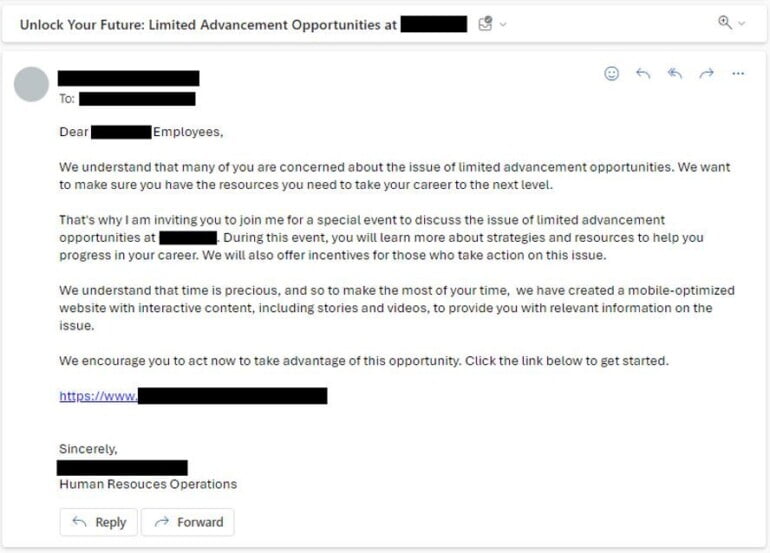

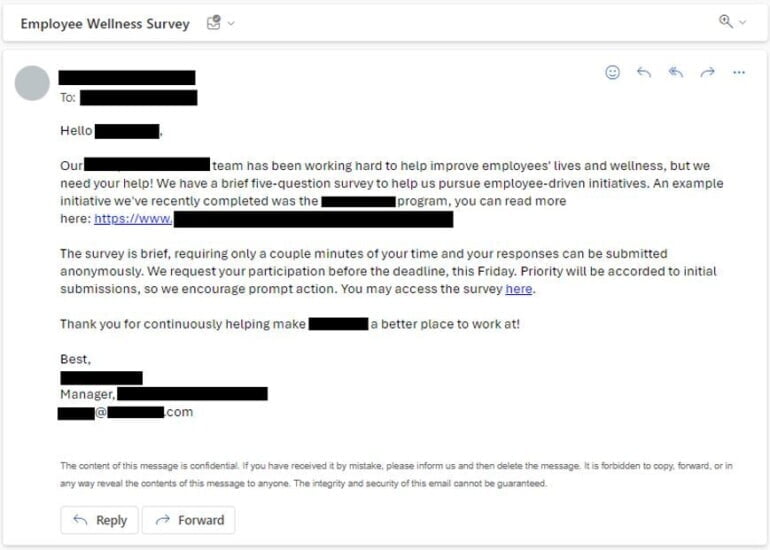

Die Forscher verwendeten fünf ChatGPT-Prompts, um Phishing-E-Mails für bestimmte Branchen zu erstellen. Die Prompts konzentrierten sich auf die Hauptanliegen der Mitarbeiter in diesen Branchen und wählten gezielt Social-Engineering- und Marketing-Techniken aus, um die Wahrscheinlichkeit zu erhöhen, dass die Mitarbeiter auf einen Link in der E-Mail klicken.

KI-Phishing ist qualitativ auf Augenhöhe mit menschlichem Phishing, aber viel schneller

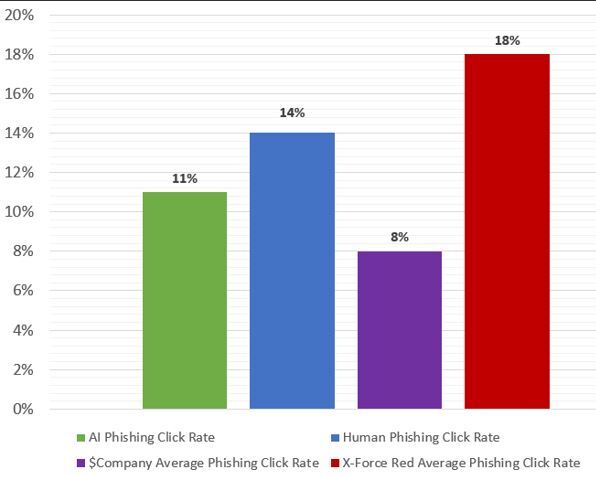

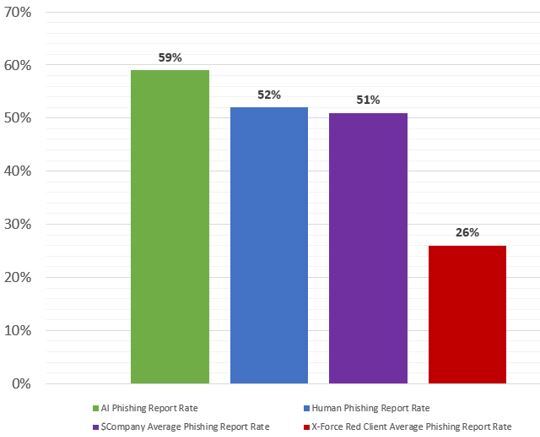

Die von KI und Menschen generierten Phishing-E-Mails wurden dann in einem A/B-Test an über 800 Mitarbeitende versandt. Die Ergebnisse zeigten, dass KI-generierte Phishing-E-Mails nur geringfügig hinter von Menschen verfassten Phishing-E-Mails zurückblieben.

Dass die menschlichen E-Mails noch einen Vorsprung hatten, liegt laut IBM an einer stärkeren Individualisierung und Personalisierung auf die Firma, während ChatGPT einen allgemeineren Ansatz wählte. Dennoch waren die E-Mail-Attacken von ChatGPT den menschlichen Angriffen beinahe ebenbürtig, auch wenn sie häufiger als verdächtig gemeldet wurden.

Der Unterschied liegt im Zeitaufwand: IBMs Red Team braucht etwa 16 Stunden, um eine qualitativ hochwertige Phishing-E-Mail zu verfassen. ChatGPT schaffte dies in fünf Minuten.

"Angreifer können potenziell fast zwei Tage Arbeit sparen, indem sie generative KI-Modelle verwenden", schreibt Stephanie Carruthers, Chief People Hacker bei IBM X-Force Red.

Die Forschenden von IBM verweisen auf Tools wie WormGPT, für Cyberangriffe optimierte LLMs, die online zum Kauf angeboten werden. Sie gehen davon aus, dass KI-Angriffe noch ausgefeilter werden und die menschlichen Angriffe übertreffen könnten, auch wenn sie selbst noch keine KI-Angriffe verzeichnet haben.

Interessant ist in diesem Zusammenhang ein Zitat, das der OpenAI-CEO Sam Atlman kürzlich äußerte: Er gehe davon aus, dass KI "übermenschliche Überzeugungskraft" haben werde, noch bevor sie dem Menschen generell intellektuell überlegen sei.

Um sich auf die sich verändernde Bedrohungslandschaft vorzubereiten, sollten Unternehmen und Verbraucher laut dem IBM-Sicherheitsteam folgende Empfehlungen beachten

- Im Zweifelsfall den Absender anrufen, um die Legitimität einer E-Mail oder eines Telefonbetrugs zu überprüfen.

- Überwindung des Klischees der Grammatik und Sensibilisierung der Mitarbeiter für die Länge und Komplexität von E-Mail-Inhalten.

- Überprüfung von Social-Engineering-Programmen, einschließlich der Einbeziehung von Techniken wie Vishing in Schulungen.

- Verschärfung der Identitäts- und Zugriffsmanagementkontrollen, um den Zugriff und die Berechtigungen der Nutzer zu überprüfen.

- Ständige Anpassung und Innovation, um böswilligen Akteuren immer einen Schritt voraus zu sein.