Imagen Video: Google stellt hochauflösende Text-zu-Video-KI vor

Googles neueste generative KI "Imagen Video" erstellt anhand von Texteingaben kurze Videos. Das ist nach letzter Woche schon fast keine Neuigkeit mehr - aber Imagen Video erzielt einen neuen Qualitätsstandard bei Auflösung und Bildwiederholrate.

Kurz nach Meta mit Make-a-Video stellt auch Google ein Text-zu-Video-System vor: Es greift auf die Diffusionstechnik und weitere Erkenntnisse der Bild-KI Imagen zurück, die bislang mächtigste öffentlich vorgestellte Bild-KI, verwendet laut Googles Forschungsteam aber einen komplexeren Aufbau bestehend aus einer "Kaskade an Videodiffusionsmodellen".

"A bunch of autumn leaves falling on a calm lake to form the text 'Imagen Video'. Smooth. | Video: Google

Das Imagen-Video-Modell wurde im Vergleich zum Imagen-Bild-Modell um eine Zeitachse erweitert und zudem mit Bildern und Videos gemeinsam trainiert. Die Stärken des Imagen-Bildmodells blieben laut Google dabei erhalten. Für die Textverarbeitung von Imagen Video setzt Google wie schon bei Imagen Bild auf ein großes, vortrainiertes Transformer-Sprachmodell (T5-XXL).

Imagen Video erreicht HD-Auflösung und flüssige Bildwiederholrate

Derzeitiges Alleinstellungsmerkmal von Imagen Video ist die hohe Auflösung in Kombination mit einer relativ hohen Bildwiederholrate: Das KI-System erreicht mit 1280 x 768 Pixeln bei 24 Bildern pro Sekunde HD-Standard. Meta generierte mit Make-a-Video für erste Tests Videos mit einer maximalen Auflösung von 768 x 768 Videos bei einer geringeren Bildwiederholrate.

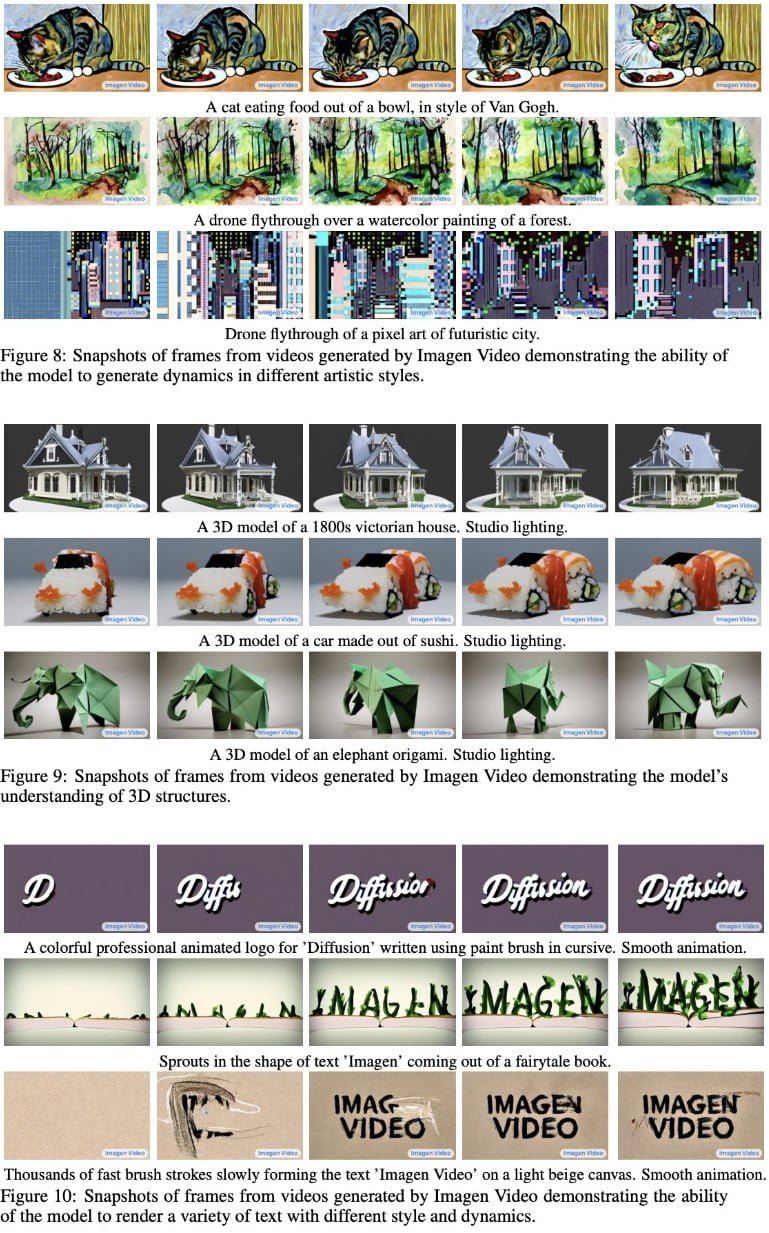

Imagen Video beherrscht wie generative Bildsysteme verschiedene künstlerische Stile - von Pixel Art bis Van Gogh - hat laut Google ein Verständnis für 3D-Objekte und kann Wörter korrekt buchstabieren. Eine Besonderheit, die schon der Imagen-Bild-KI vorbehalten war.

Das System biete zudem ein "hohes Maß an Kontrollierbarkeit und Weltkenntnis" und könne Videos sehr genau zum Textbefehl generieren, schreibt das Forschungsteam - und demonstriert es auch.

Prompt: "Sprouts in the shape of text 'Imagen Video' coming out of a fairytale book."

Model Output: pic.twitter.com/FVgnM0UAAn— Durk Kingma (@dpkingma) October 5, 2022

Wie bei Metas Make-a-Video ist allerdings die Länge der Videos begrenzt: Die Ausgabe liegt derzeit bei maximal rund fünf Sekunden. Imagen Video generiert also eher längere Animationen als Videos - doch auch hierfür kündigt sich eine Lösung an.

Lange KI-Videos: Phenaki stammt auch von Google

Dass KI auch lange Videos generieren kann, zeigte erst letzte Woche das Text-zu-Video-KI-System Phenaki, das aus aufeinander aufbauenden Prompts ganze Story-Szenen generieren kann. In einer Demo zeigte das Phenaki-Forschungsteam ein rund zwei Minuten langes Video, das entlang eines kleinen Drehbuchs generiert wurde.

Zum Zeitpunkt der Veröffentlichung von Phenaki war aus Review-Gründen nicht klar, wer hinter dem Paper steckt. Jetzt verrät Imagen-Video-Leitautor Jonathan Ho bei Twitter, dass Phenaki ebenfalls ein Google-Projekt ist.

Der nächste Schritt laut Ho: Die Bildqualität von Imagen Video und die Kohärenz und Videolänge von Phenaki sollen kombiniert werden.

Imagen Video wird vorerst nicht veröffentlicht

Wie schon bei Imagen für Bilder veröffentlicht Google das Modell derzeit nicht. Die Begründung lautet gleich: Imagen Video wurde mit teils "problematischen Daten" trainiert.

Bei internen Tests hätten zwar viele explizite und gewalthaltige Inhalte erfolgreich gefiltert werden können, aber soziale Verzerrungen und Stereotypen würden noch immer repliziert. Es sei eine Herausforderung diese zu erkennen und zu filtern, schreibt das Forschungsteam.

Mit einer ähnlichen Begründung verzichtete auch Meta vorläufig auf die Veröffentlichung von Make-a-Video, stellte aber zumindest eine zeitnahe Demo in Aussicht.

KI-News ohne Hype – von Menschen kuratiert

Mit dem THE‑DECODER‑Abo liest du werbefrei und wirst Teil unserer Community: Diskutiere im Kommentarsystem, erhalte unseren wöchentlichen KI‑Newsletter, 6× im Jahr den "KI Radar"‑Frontier‑Newsletter mit den neuesten Entwicklungen aus der Spitze der KI‑Forschung, bis zu 25 % Rabatt auf KI Pro‑Events und Zugriff auf das komplette Archiv der letzten zehn Jahre.

Jetzt abonnierenKI-News ohne Hype

Von Menschen kuratiert.

- Mehr als 16 % Rabatt.

- Lesen ohne Ablenkung – keine Google-Werbebanner.

- Zugang zum Kommentarsystem und Austausch mit der Community.

- Wöchentlicher KI-Newsletter.

- 6× jährlich: “KI Radar” – Deep-Dives zu den wichtigsten KI-Themen.

- Bis zu 25 % Rabatt auf KI Pro Online-Events.

- Zugang zum kompletten Archiv der letzten zehn Jahre.

- Die neuesten KI‑Infos von The Decoder – klar und auf den Punkt.