Ist Predictive Coding das nächste große Ding in der künstlichen Intelligenz?

Predictive Coding ist eine führende neurowissenschaftliche Theorie über die Funktionsweise des Gehirns. Kann sie für die KI nützlich sein?

Gegenwärtige KI-Systeme basieren auf tiefen neuronalen Netzen, die durch Backpropagation trainiert werden. Diese Methode hat jedoch einige Einschränkungen, wie beispielsweise Ineffizienz und mangelnde Robustheit, und es ist unwahrscheinlich, dass das Gehirn so funktioniert. Ein alternativer Ansatz, das sogenannte Predictive Coding könnte diese Einschränkungen überwinden.

Predictive Coding geht davon aus, dass das Gehirn über ein internes Modell der Welt verfügt. Bottom-up-Verbindungen übertragen Vorhersagen auf niedrigere Ebenen, während Top-down-Verbindungen Vorhersagefehler übertragen. Durch die Minimierung dieser Fehler innerhalb einer Hierarchie zieht das Gehirn Schlussfolgerungen und lernt.

Predictive Coding als ein Schema zur Minimierung der freien Energie

Ein neues Papier von Forschern aus mehreren Labors, hauptsächlich unter der Leitung des VERSES AI Research Lab, darunter der renommierte Neurowissenschaftler Karl Friston, bietet einen umfassenden Überblick über Predictive Coding, einschließlich der theoretischen Grundlagen, prominente Berechnungsansätze, verschiedene Anwendungen auf Probleme des maschinellen Lernens, Plausibilität in den Neurowissenschaften und Hardware-Überlegungen.

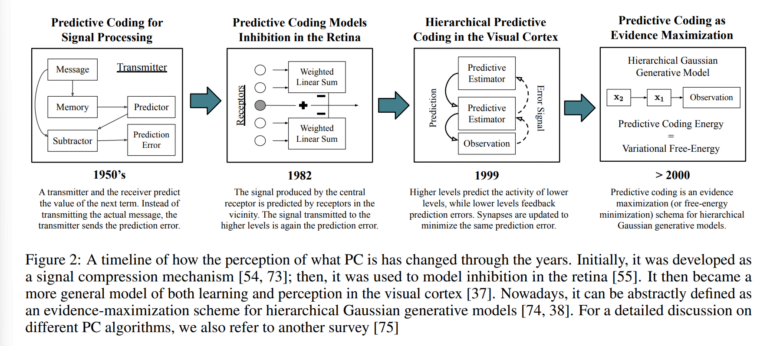

Sie sehen die Hauptvorteile des Predictive Coding in seiner Robustheit und seinem Potenzial für hochparallele und neuromorphe Implementierungen. Es stimmt auch mit dem Wissen über kortikale Struktur und Funktion überein und ist daher biologisch plausibel. Ihre Definition lautet: "Predictive Coding ist ein Schema zur Maximierung der Evidenz (oder Minimierung der freien Energie) für hierarchische generative Gauß-Modelle", in Anlehnung an Fristons Arbeit zum Prinzip der freien Energie.

Predictive Coding könnte sich zu einem leistungsstarken alternativen Paradigma in der KI entwickeln

Auch wenn Predictive Coding noch nicht die Bedeutung von Backpropagation-Methoden erreicht hat, sind die jüngsten Fortschritte vielversprechend für die Weiterentwicklung der künstlichen Intelligenz nach dem Vorbild des Gehirns, so die Forschenden. Predictive Coding hat sich bei Aufgaben wie dem diskriminativen Lernen, der Verarbeitung natürlicher Sprache, dem maschinellen Sehen, der zeitlichen Modellierung, dem lebenslangen Lernen und der Robotik als erfolgreich erwiesen, wobei einige Beispiele die Leistung der Backpropagation bei MNIST oder CIFAR10 erreichen.

Obwohl Potenzial sichtbar sei, ist das Gebiet noch weit von groß angelegten Anwendungen entfernt, die erhebliche Investitionen in die Forschung im Bereich bringen könnten, so das Team. Das Hauptziel des Papers ist es daher, Forschende zu ermutigen, auf den Ergebnissen früherer Forschungsarbeiten aufzubauen und sich auf die Herausforderungen des Predictive Coding zu konzentrieren.

"Es bedarf gemeinsamer Anstrengungen, um das Predictive Coding sowohl aus der Sicht der Software als auch aus der Sicht der Hardware voranzubringen, insbesondere um Berechnungsschemata zu entwickeln, die die sich bietenden Vorteile wie Parallelität und sparsame, lokale und potenziell energieeffiziente Berechnungen nutzen. Obwohl die Forschung auf dem Gebiet des Predictive Coding in den letzten Jahrzehnten kontinuierliche Fortschritte gemacht hat, beginnen wir vielleicht erst jetzt, die Vorteile zu erkennen, die das Reverse Engineering der Großhirnrinde und anderer biologischer Strukturen für die künstliche Intelligenz bietet".

Aus dem Papier.

Bei weiterer Forschung, so die These, könnte Predictive Coding ein leistungsfähiges alternatives Paradigma in der KI werden.

Über das Prinzip der freien Energie bzw. aktive Inferenz haben wir auch mit dem Biologen Franz Kuchling in unserem DEEP MINDS Podcast #11 gesprochen.

KI-News ohne Hype – von Menschen kuratiert

Mit dem THE‑DECODER‑Abo liest du werbefrei und wirst Teil unserer Community: Diskutiere im Kommentarsystem, erhalte unseren wöchentlichen KI‑Newsletter, 6× im Jahr den „KI Radar"‑Frontier‑Newsletter mit den neuesten Entwicklungen aus der Spitze der KI‑Forschung, bis zu 25 % Rabatt auf KI Pro‑Events und Zugriff auf das komplette Archiv der letzten zehn Jahre.

Jetzt abonnierenKI-News ohne Hype

Von Menschen kuratiert.

- Mehr als 20 Prozent Launch-Rabatt.

- Lesen ohne Ablenkung – keine Google-Werbebanner.

- Zugang zum Kommentarsystem und Austausch mit der Community.

- Wöchentlicher KI-Newsletter.

- 6× jährlich: „KI Radar“ – Deep-Dives zu den wichtigsten KI-Themen.

- Bis zu 25 % Rabatt auf KI Pro Online-Events.

- Zugang zum kompletten Archiv der letzten zehn Jahre.

- Die neuesten KI‑Infos von The Decoder – klar und auf den Punkt.