Die Künstliche-Intelligenz-Forscherin Fei-Fei Li von der Stanford Universität gehört zu den Koryphäen ihres Fachgebiets. Sie sieht nichts Künstliches in der Künstlichen Intelligenz, da sie von Menschen gemacht wird.

In einem Aufsatz für die New York Times fordert Li, das Menschsein bei der Entwicklung von Künstlicher Intelligenz stärker einzubeziehen. Sie nennt ihren Ansatz menschenzentrierte Künstliche Intelligenz: Entlang dreier Richtlinien soll die verantwortungsvolle Entwicklung von intelligenten Maschinen gelingen.

Künstliche Intelligenz müsse versuchen, die Tiefe des menschlichen Intellekts besser abzubilden. Die maschinelle Wahrnehmung sei im Vergleich zum menschlichen Wahrnehmungsapparat stark eingeschränkt. Den KI-Systemen mangele es an Verständnis für Kontext und Nuancen.

Sie nennt als Beispiel eine Software für Bilderkennung, die auf einem Foto einen Mann analysiert, der auf einem Pferd reitet. Die Information sei zwar korrekt, schreibt Li, aber die Maschine verschweige, dass auf dem Bild nur eine Statue zu sehen ist.

"Die KI hat keinen Sinn für Ästhetik und nimmt keine Schwingungen und Details wahr, die für Menschen so wichtig sind", schreibt Li.

Die KI als Empathiemaschine

Solange Maschinen im Vergleich zu Menschen nur eingeschränkt wahrnehmungsfähig seien, schreibt Li, könnten sie auch nicht ihre Bedürfnisse antizipieren und entsprechend kaum zu ihrem Wohlergehen beitragen. Damit Maschinen so etwas wie Empathie für Menschen entwickeln könnten, müssten Computerwissenschaftler stärker mit anderen Disziplinen zusammenarbeiten.

Die KI-Forschung müsse vernetzt werden mit den Wahrnehmungswissenschaften, der Psychologie und der Soziologie. "Dann hätten wir eine deutlich bessere Basis für die Entwicklung maschineller Intelligenz", schreibt Li.

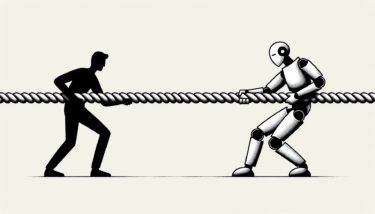

Die aus solchen Kooperationen resultierenden KI-Systeme würden besser kommunizieren, kollaborieren und so auf das eigentliche Ziel der menschenzentrierten Künstlichen Intelligenz einzahlen: Sie soll die Menschheit ergänzen, nicht ersetzen.

Geht es nach Li, dann gibt der Mensch bei kreativen, intellektuellen und emotionalen Aufgaben weiter den Ton an. Die Maschine erledige hingegen jene Jobs, die repetitiv seien bei einer hohen Fehler- oder Verletzungsgefahr.

Universitäten und Regierungen sind gefordert

"Kein Grad an Genialität kann die Angst beseitigen, dass der eigene Job ersetzt wird", schreibt Li. Weitere Stolpersteine bei der Entwicklung von KI-Systemen seien Vorurteile gegen in Datensätzen unterrepräsentierten Gemeinschaften, die Privatsphäre beim KI-Training mit personenbezogenen Daten sowie die geopolitischen Konsequenzen eines weltweiten KI-Wettrennens.

Universitäten und Regierungen müssten dafür sorgen, dass in der KI-Forschung interdisziplinär gearbeitet wird und dass sich Frauen und Minderheiten an der Fortentwicklung Künstlicher Intelligenz beteiligen.

"Keine andere Technologie gibt so stark die Persönlichkeit ihrer Erschaffer wieder", schreibt Li. Die Politik müsse ethische Leitplanken durchsetzen, die Ambition und Verantwortung aufwiegen.

"Egal wie autonom Maschinen werden, ihr Einfluss auf die Welt - ob gut oder schlecht - wird immer unsere Verantwortung sein", schreibt Li.