Das chinesische KI-Startup Deepseek hat sein neuestes KI-Modell offenbar auf Nvidias leistungsstärkstem Chip Blackwell trainiert – trotz US-Exportverbots. Das berichtet Reuters unter Berufung auf einen hochrangigen Vertreter der Trump-Regierung. Das Modell soll bereits nächste Woche veröffentlicht werden. Gerüchte über Chip-Schmuggel gab es bereits Ende letzten Jahres.

Die Blackwell-Chips befinden sich laut dem Beamten vermutlich in einem Rechenzentrum in der Inneren Mongolei. Deepseek werde voraussichtlich technische Hinweise auf die Nutzung der US-Chips entfernen. Wie Deepseek an die Chips gelangte, wollte der Beamte nicht sagen. Nvidia lehnte einen Kommentar ab, Deepseek und das US-Handelsministerium reagierten nicht auf Anfragen von Reuters.

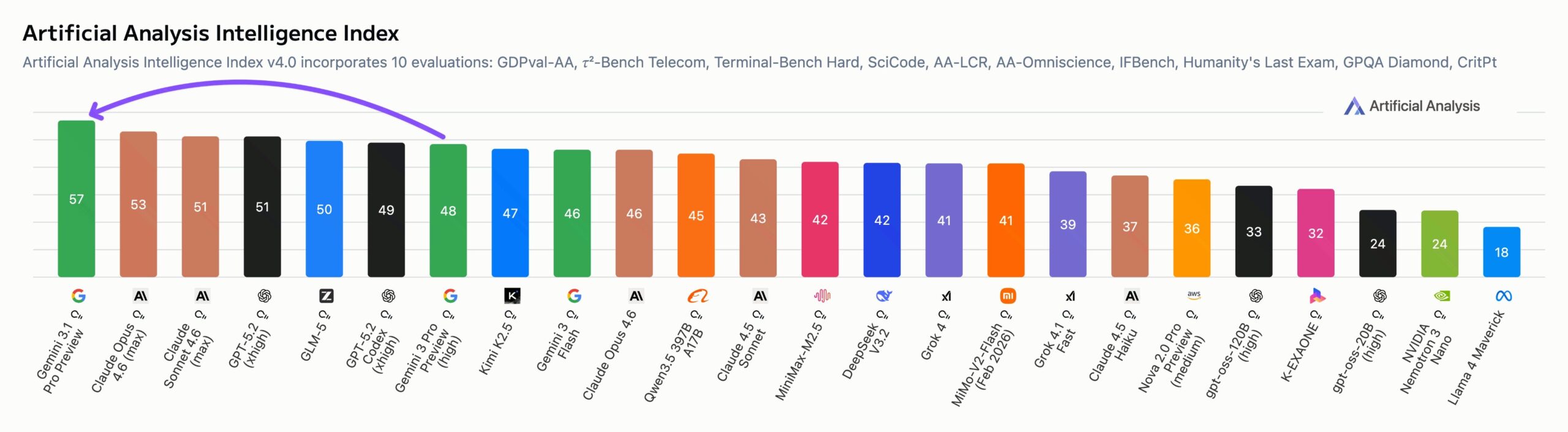

Dass solche Berichte durchgestochen werden, ebenso wie die Beschwerden von Google, OpenAI und Anthropic über Destillations-Angriffe auf die eigenen Modelle seitens chinesischer Startups, und dass OpenAI einen bekannten Coding-Benchmark relativiert, könnten Zeichen dafür sein, dass Deepseek mit seinem neuen Modell erneut sehr gute Ergebnisse zu günstigen Preisen erzielen wird. Schon im Januar 2025 brachte das führende KI-Startup Chinas die US-Tech-Werte unter Druck, die in der KI-Blase hängen.