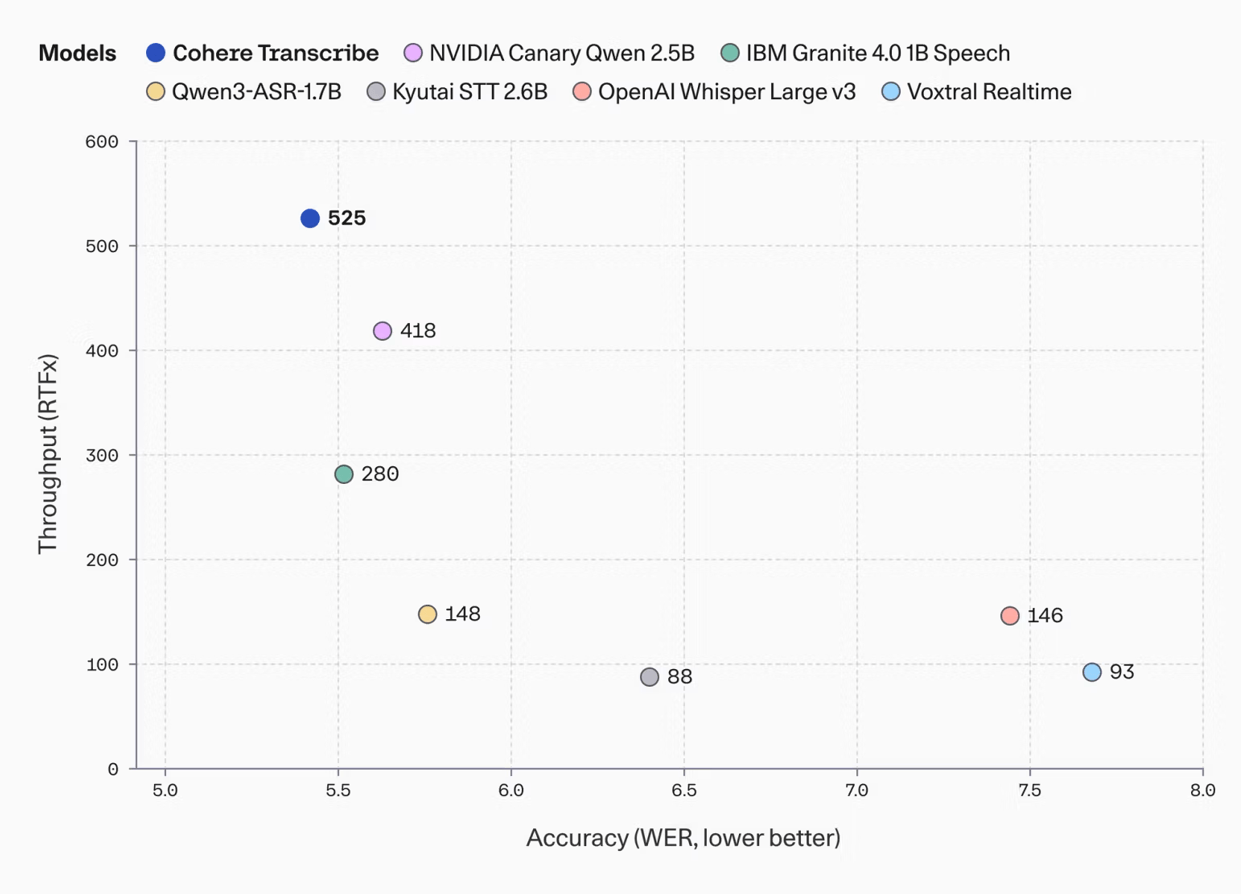

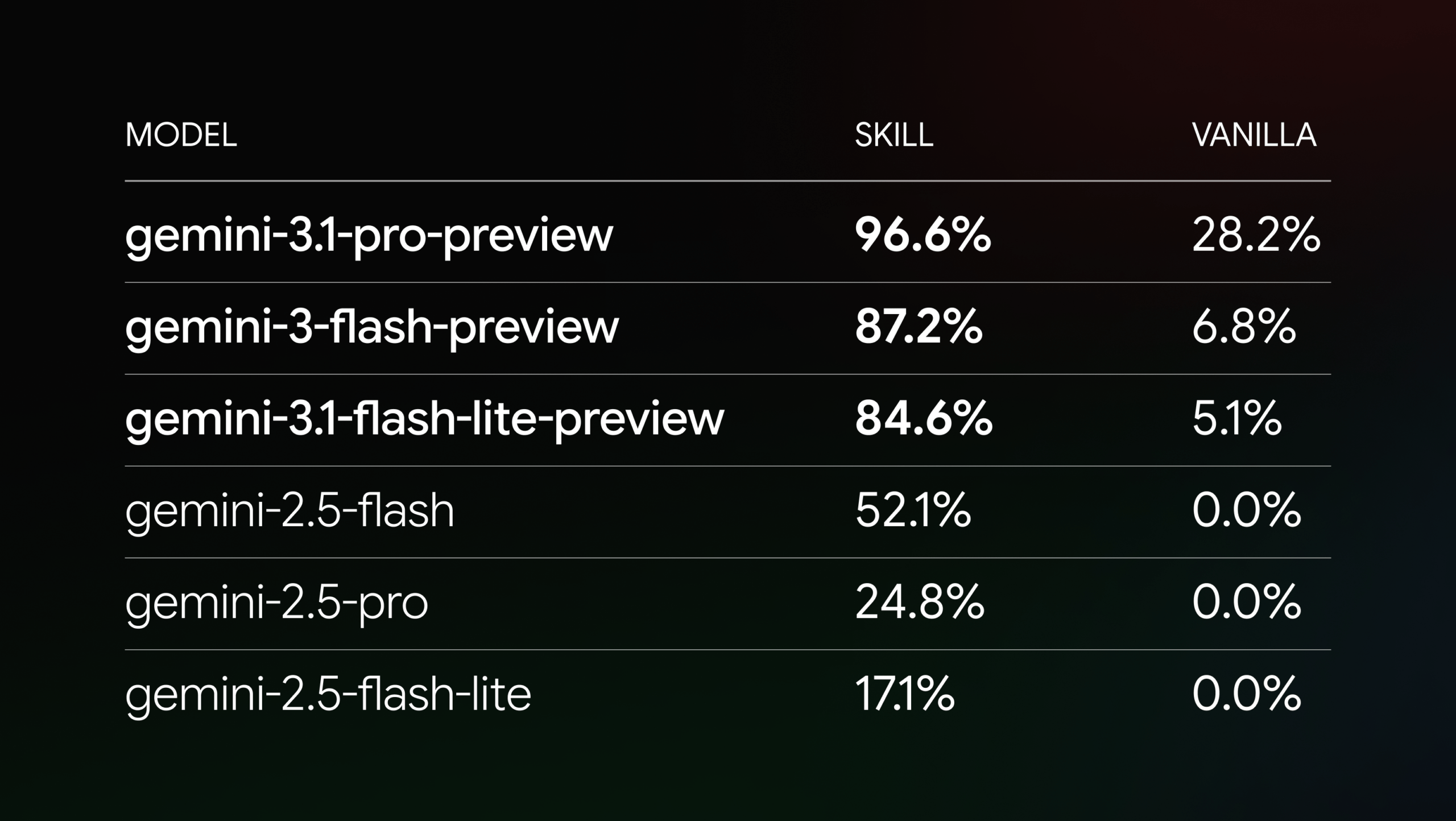

Google hat einen sogenannten "Agent Skill" für die Gemini-API entwickelt, der die Wissenslücke von Sprachmodellen bei schnelllebigen SDK-Änderungen schließen soll. Das Problem: KI-Modelle kennen nach dem Training weder ihre eigenen Updates noch aktuelle beste Lösungen. Der neue Skill liefert Coding-Agenten Informationen zu aktuellen Modellen, SDKs und Beispielcode. In Tests mit 117 Aufgaben stieg die Erfolgsrate des besten Modells (Gemini 3.1 Pro Preview) von 28,2 auf 96,6 Prozent.

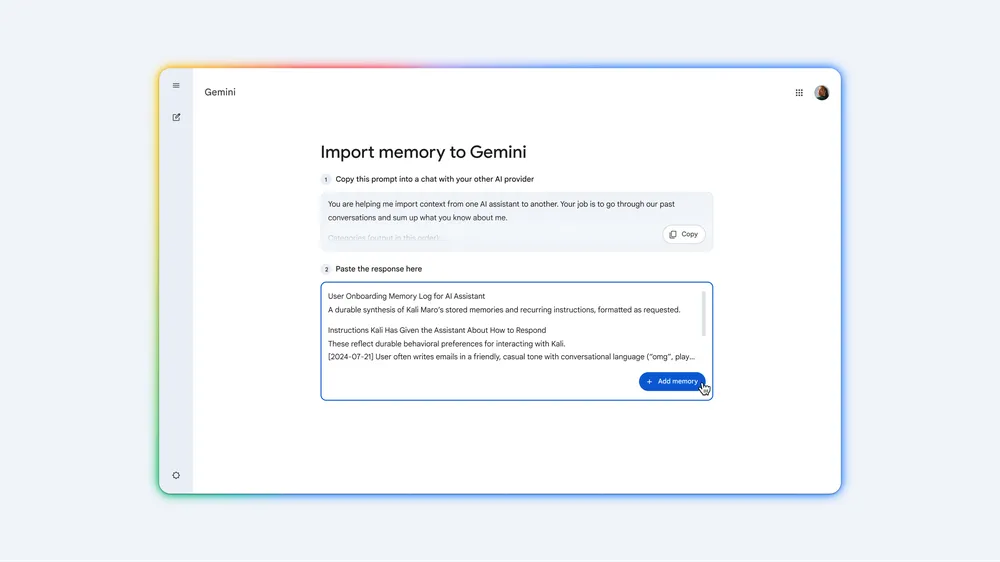

Ältere 2.5-Modelle profitierten deutlich weniger, was laut Google an schwächer ausgeprägtem Reasoning liegt. Eine Vercel-Studie zeigt allerdings, dass direkte Anweisungen via AGENTS.md noch wirksamer sein könnten. Google prüft daher auch andere Wege, darunter MCP-Dienste. Der Skill ist auf GitHub verfügbar.