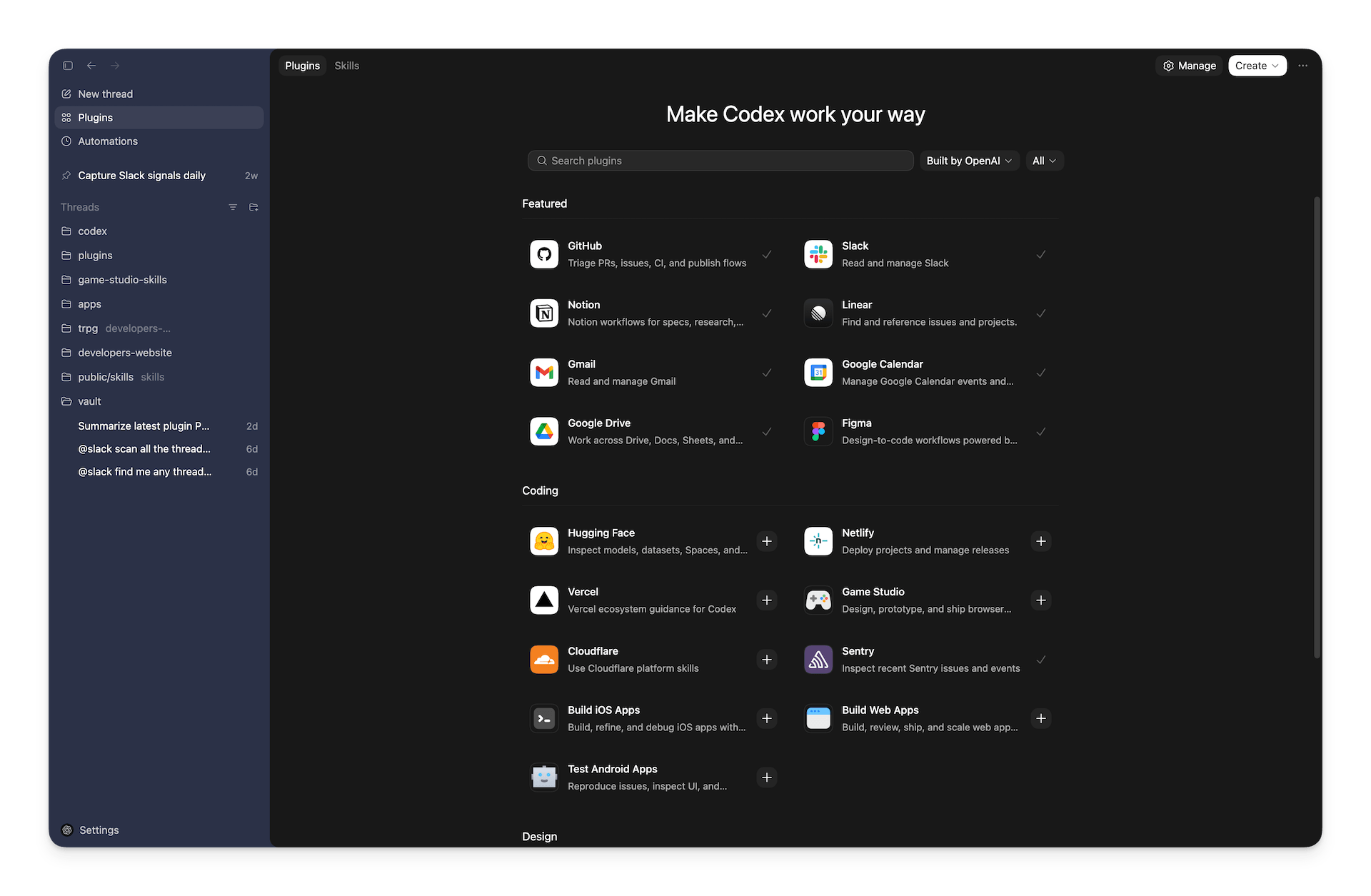

OpenAI führt Plugins für seinen KI-Programmierassistenten Codex ein, um mit gängigen Arbeitstools wie Slack, Figma, Notion, Gmail und Google Drive zusammenzuarbeiten. Laut OpenAI helfen die Plugins nicht nur beim Programmieren, sondern auch bei Planung, Recherche und Koordination. Technisch bündeln Plugins sogenannte Skills (vordefinierte Prompt-Arbeitsabläufe), App-Integrationen und MCP-Server-Konfigurationen in einem installierbaren Paket, ähnlich zur Integration in ChatGPT. Sie lassen sich in der Codex-App, der Codex-Kommandozeile und in IDE-Erweiterungen nutzen. Entwickler können eigene Plugins erstellen und über lokale oder teamweite "Marketplaces" verteilen. Ein offizielles Plugin-Verzeichnis mit kuratierten Plugins von OpenAI ist bereits verfügbar, eine Selbstveröffentlichung soll bald folgen. Weitere Plugins und Anwendungsfälle sollen laut OpenAI schrittweise hinzukommen.

Die Plugins sind Teil von OpenAIs strategischer Neuausrichtung auf Coding-Werkzeuge und Geschäftskunden, die auch eine geplante "Superapp" aus ChatGPT, Codex und dem Browser Atlas umfasst. Codex hat laut OpenAI inzwischen über 1,6 Millionen wöchentlich aktive Nutzer, erst kürzlich folgte eine Windows-Version.