Künstliche Intelligenz: US-Startup stellt riesigen KI-Chip vor

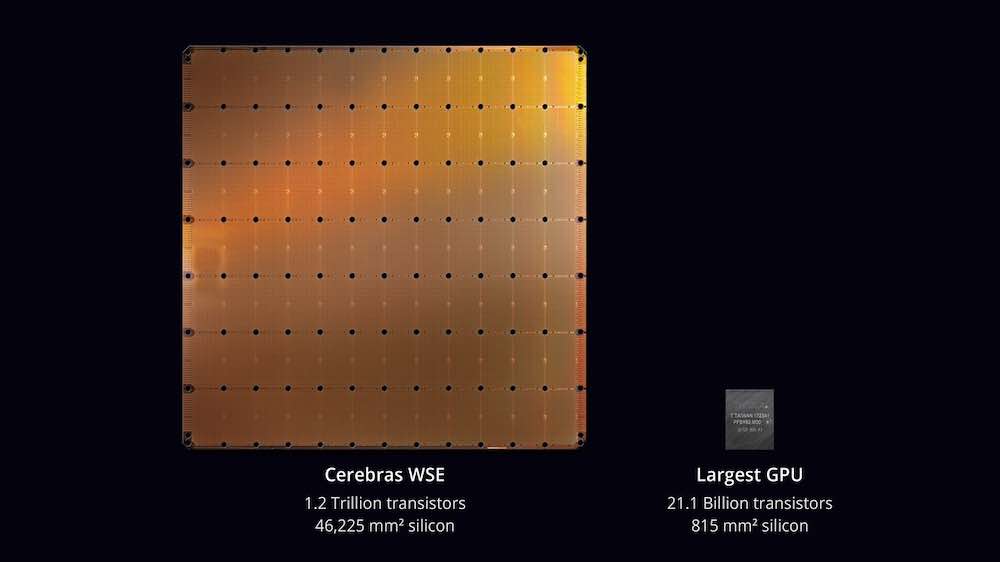

Das US-Startup Cerebras hat einen KI-optimierten Prozessor vorgestellt, der mehr als 50 Mal so groß ist wie die bislang größte GPU.

22 Zentimeter misst der Prozessor auf jeder Seite und ist damit der wohl größte Computerchip, der jemals hergestellt wurde.

Künstliche neuronale Netze werden normalerweise mittels einer Vielzahl miteinander verbundener GPUs trainiert. Der Vorteil von Cerebras' riesigem Chip: Die Daten können dank der integrierten Architektur und größerer Speicheranbindung tausend Mal schneller zwischen den 400.000 KI-optimierten Kernen fließen. 1,2 Billionen Transistoren finden insgesamt Platz auf dem Chip. Zum Vergleich: Eine Geforce RTX 2080 Ti bietet 18,6 Milliarden Transistoren.

Cerebras-Gründer Andrew Feldman zufolge soll der Chip so schnell sein wie hunderte GPUs und dabei weniger Energie und Raum benötigen.

Laut OpenAI hat sich die für KI-Experimente aufgewendete Computerleistung seit 2012 alle dreieinhalb Monate verdoppelt. Mit Folgen: Der Energieverbrauch des KI-Trainings hinterlässt einer kürzlich veröffentlichten Studie zufolge einen fetten CO2-Fußabdruck. Schnellere und energieeffiziente KI-Chips werden in der Industrie daher dringend benötigt.

Ein Wafer, ein Chip

Für die Herstellung des Prozessors arbeitete Cerebras eng mit dem Halbleiterhersteller TSMC zusammen. Der musste den Chip-Herstellungsprozess gründlich umstrukturieren.

Computerchips werden normalerweise in größerer Zahl mittels eines Wafers hergestellt und anschließend aus diesem herausgeschnitten, sodass man aus einem Wafer eine Vielzahl Prozessoren gewinnt. Cerebras' Chipdesign hingegen beansprucht die größtmögliche Fläche eines kompletten Wafers mit 30 Zentimeter Durchmesser.

Gekühlt wird der Riesenprozessor mittels Wasser, entsprechende Leitungen verlaufen entlang des Chips.

Die KI-Industrie muss umstellen

Erste Kunden sollen den Chip bereits testen, etwa für das Design von Medikamenten. Cerebras will komplette Server statt einzelner Chips verkaufen. Wann sie verfügbar sein werden und wie viel sie kosten werden, verrät das Startup nicht.

Der Analyst Jim McGregor von Tirias Research schätzt, dass die Chips mehrere Millionen US-Dollar kosten könnten und dass Datencenter für die neuen Prozessoren umgerüstet werden müssten. Cerebras müsse außerdem neue Software entwickeln, die es Entwicklern und KI-Forschern leichter macht, mit den neuen Chips zu arbeiten.

Große Techkonzerne dürften die Riesenchips trotz dieser Hemmnisse genauer unter die Lupe nehmen wollen, glaubt McGregor. Schließlich entwickeln Amazon, Alibaba, Intel, Baidu und Google schon selbst neue Chips, um KI-Berechnungen zu beschleunigen.

Cerebras wurde 2016 gegründet und erhielt bislang in drei Investitionsrunden 112 Mio. US-Dollar Risikokapital.

Titelbild: Cerebras, Quelle: Wired

KI-News ohne Hype – von Menschen kuratiert

Mit dem THE‑DECODER‑Abo liest du werbefrei und wirst Teil unserer Community: Diskutiere im Kommentarsystem, erhalte unseren wöchentlichen KI‑Newsletter, 6× im Jahr den „KI Radar"‑Frontier‑Newsletter mit den neuesten Entwicklungen aus der Spitze der KI‑Forschung, bis zu 25 % Rabatt auf KI Pro‑Events und Zugriff auf das komplette Archiv der letzten zehn Jahre.

Jetzt abonnierenKI-News ohne Hype

Von Menschen kuratiert.

- Mehr als 20 Prozent Launch-Rabatt.

- Lesen ohne Ablenkung – keine Google-Werbebanner.

- Zugang zum Kommentarsystem und Austausch mit der Community.

- Wöchentlicher KI-Newsletter.

- 6× jährlich: „KI Radar“ – Deep-Dives zu den wichtigsten KI-Themen.

- Bis zu 25 % Rabatt auf KI Pro Online-Events.

- Zugang zum kompletten Archiv der letzten zehn Jahre.

- Die neuesten KI‑Infos von The Decoder – klar und auf den Punkt.