Meta AI kann jetzt sprechen, Bilder verstehen und Videos synchronisieren

Auf der elften jährlichen Connect-Konferenz von Meta hat CEO Mark Zuckerberg Neuigkeiten in den Bereichen Mixed Reality, KI und Wearables vorgestellt.

Besonders im Fokus standen dabei die Fortschritte bei Meta AI, dem hauseigenen KI-Assistenten, sowie die Enthüllung von Orion, dem ersten AR-Brillen-Prototyp des Unternehmens.

400 Millionen nutzen monatlich Meta AI

Meta AI, der KI-Assistent des Unternehmens, erfreut sich laut Zuckerberg wachsender Beliebtheit. Laut Meta nutzen bereits 400 Millionen Menschen den Dienst monatlich, 185 Millionen sogar wöchentlich.

Um die Interaktion mit Meta AI natürlicher zu gestalten, führt das Unternehmen (zunächst nur in Australien, Kanada, Neuseeland und den USA und nur auf Englisch) eine Spracheingabe für den Assistenten auf Facebook, Messenger, WhatsApp und Instagram ein. Zudem sollen bekannte Stimmen wie Awkwafina, Dame Judi Dench und John Cena dem KI-Assistenten mehr Persönlichkeit verleihen.

Video: Meta

Meta experimentiert außerdem mit automatischer Video- und Lippensynchronisation für Reels auf Instagram und Facebook, um Inhalte in verschiedenen Sprachen einem breiteren Publikum zugänglich zu machen. Das könnte an Geschäftsmodellen von dedizierten Start-ups wie HeyGen sägen.

Video: Meta/via @altryne/X

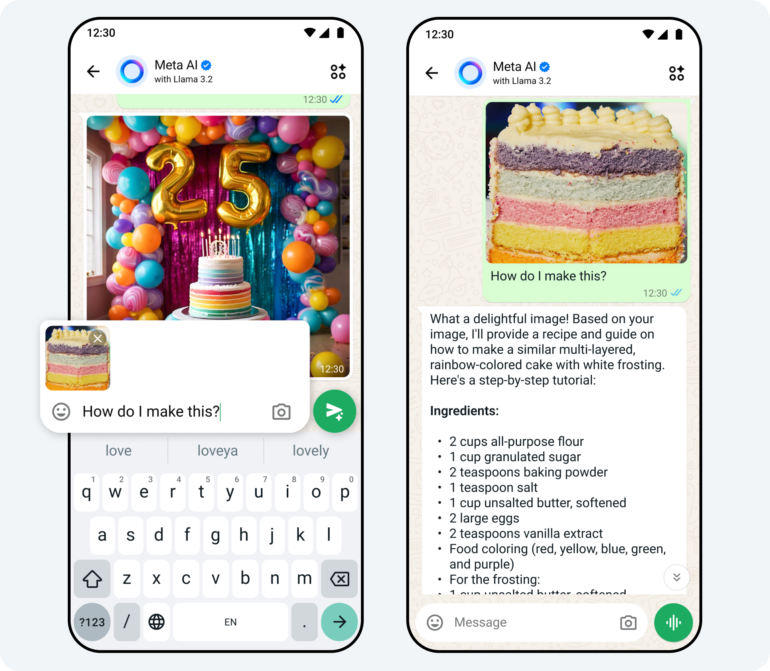

Auch die KI-gestützten Bearbeitungstools werden erweitert: Nutzer:innen können dank der Visionfähigkeiten der neuen Llama-3.2-Modelle nun Fragen zu hochgeladenen Fotos stellen und Elemente in echten Fotos per Sprachbefehl hinzufügen, entfernen oder verändern.

Zudem hat Meta kleinere Modelle mit 1B- und 3B-Parametern veröffentlicht, die speziell für den Einsatz auf Geräten wie Smartphones oder zukünftig auch auf AR-Brillen optimiert sind.

Insgesamt scheint Meta mit immer größeren Schritten zur kommerziellen Konkurrenz von OpenAI aufzuholen; der Leistungsabstand zu Modellen wie GPT-4 schwindet. Mit der Multimodalität und der Sprachschnittstelle gibt es gleich zwei wichtige Funktionen auf einmal, die Endkund:innen im Alltag tatsächlich gebrauchen können.

Ray-Ban Meta Smart Glasses werden zum Stadtführer

Orion: Metas erster AR-Brillen-Prototyp

Ein Höhepunkt der Konferenz war nämlich die Enthüllung von Orion, dem ersten AR-Brillen-Prototyp von Meta, an dem das Unternehmen nach eigener Aussage seit zehn Jahren arbeitet.

Die kabellose Brille wiegt weniger als 100 Gramm und ist mit zehn maßgeschneiderten Siliziumchips sowie hellen Displays mit weitem Sichtfeld (70 Grad) ausgestattet – viel mehr technische Einblicke gibt es allerdings nicht. Ganz im Sinne der Augmented Reality soll es Nutzer:innen ermöglichen, die reale Welt um sich herum zu sehen und gleichzeitig digitale Inhalte einzublenden.

Die Brille verfügt über Sprachsteuerung, Hand- und Augentracking zur Navigation durch die Benutzeroberfläche. Zudem bietet sie eine neue, diskrete und "sozial akzeptable" Interaktionsmöglichkeit über ein EMG-Armband.

Obwohl Orion nur ein Prototyp ist, betont Meta, dass es sich um ein Endkundenprodukt handeln könnte, so weit sei die Entwicklung schon fortgeschritten. Doch auch wenn die Brille so nie auf den Markt kommen wird, könnte es nun schneller zu einer noch besseren Version kommen. Für Meta-CEO Mark Zuckerberg war besonders überraschend, dass die KI-Elemente früher marktreif sind als die eigentliche Hardware - was er vor einigen Jahren noch anders prognostiziert hatte.

KI-News ohne Hype – von Menschen kuratiert

Mit dem THE‑DECODER‑Abo liest du werbefrei und wirst Teil unserer Community: Diskutiere im Kommentarsystem, erhalte unseren wöchentlichen KI‑Newsletter, 6× im Jahr den "KI Radar"‑Frontier‑Newsletter mit den neuesten Entwicklungen aus der Spitze der KI‑Forschung, bis zu 25 % Rabatt auf KI Pro‑Events und Zugriff auf das komplette Archiv der letzten zehn Jahre.

Jetzt abonnierenKI-News ohne Hype

Von Menschen kuratiert.

- Mehr als 16 % Rabatt.

- Lesen ohne Ablenkung – keine Google-Werbebanner.

- Zugang zum Kommentarsystem und Austausch mit der Community.

- Wöchentlicher KI-Newsletter.

- 6× jährlich: “KI Radar” – Deep-Dives zu den wichtigsten KI-Themen.

- Bis zu 25 % Rabatt auf KI Pro Online-Events.

- Zugang zum kompletten Archiv der letzten zehn Jahre.

- Die neuesten KI‑Infos von The Decoder – klar und auf den Punkt.