Mistral AI kündigt Nachfolger des Erfolgsmodells Mistral 7B an

Das französische KI-Unternehmen Mistral AI präsentiert mit Ministral 3B und 8B zwei neue Sprachmodelle, die speziell für den Einsatz auf Endgeräten und in Edge-Computing-Szenarien entwickelt wurden.

Laut Mistral handelt es sich bei den als "Ministraux" bezeichneten Modellen Ministral 3B und Ministral 8B um die derzeit leistungsfähigsten KI-Systeme ihrer Klasse für den Einsatz auf Endgeräten und in Edge-Computing-Umgebungen. Beide Modelle unterstützen laut Unternehmen Kontextlängen von bis zu 128.000 Token.

Vielfältige Einsatzmöglichkeiten von der Übersetzung bis zur Robotik

Die neuen Modelle zielen auf Anwendungsfälle ab, bei denen lokale Verarbeitung und Datenschutz im Vordergrund stehen. Laut Mistral AI eignen sich die Ministraux-Modelle besonders für Aufgaben wie On-Device-Übersetzung, internetlose intelligente Assistenten, lokale Datenanalyse und autonome Robotik.

In Kombination mit größeren Sprachmodellen wie Mistral Large sollen die Ministraux auch als effiziente Vermittler für Funktionsaufrufe in mehrstufigen Arbeitsabläufen dienen können.

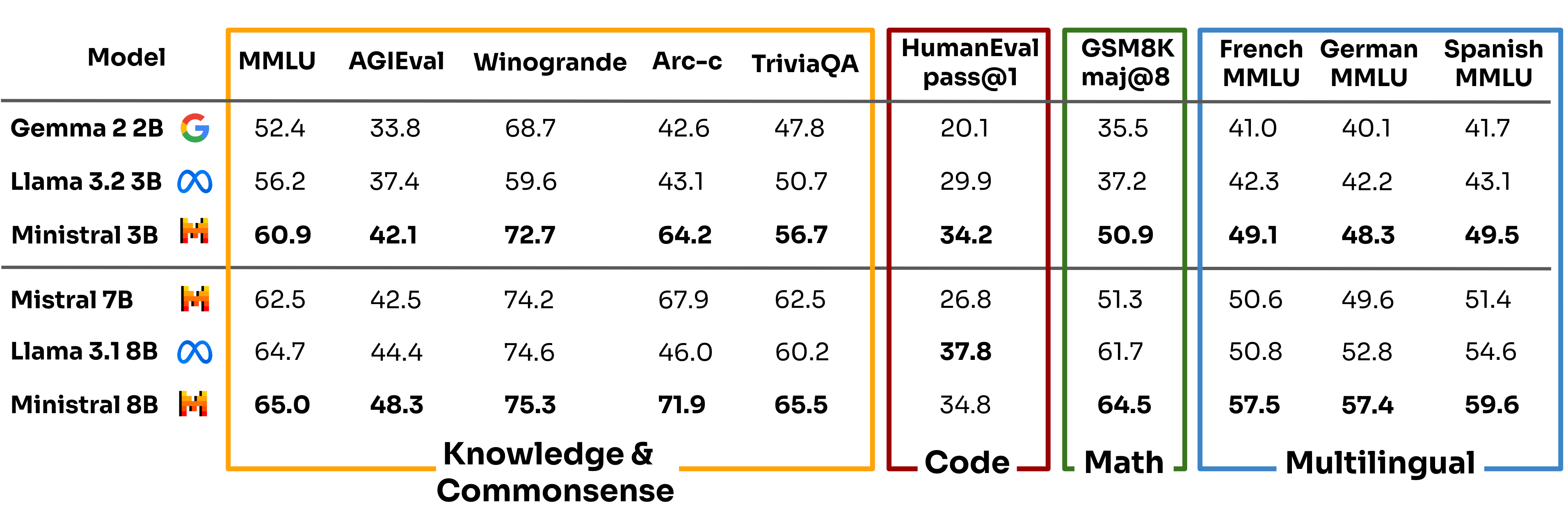

Laut den von Mistral vorgelegten Benchmarks übertreffen Ministral 3B und 8B in vielen Kategorien vergleichbare Modelle wie Gemma 2 2B oder Llama 3.1 8B. Besonders beeindruckend ist laut Mistral AI die Leistung des kleineren Ministral 3B, das in einigen Benchmarks besser abschneidet als sein größerer Vorgänger Mistral 7B, das eines der am weitesten verbreiteten Open-Source-Modelle sein dürfte.

Mistral 8B schlägt Mistral 7B deutlich in allen Benchmarks. Mistral hat es jedoch nicht mit dem neueren Llama 3.2 11B verglichen, das wahrscheinlich etwas besser ist, aber etwas größer. Stattdessen nutzte Mistral das ältere Llama 3.1 8B im Benchmark.

Verfügbarkeit und Preise

Die neuen Modelle sind ab sofort verfügbar. Ministral 8B kann laut Mistral AI über die API für 0,1 US-Dollar pro Million Token genutzt werden, während Ministral 3B für 0,04 US-Dollar pro Million Token zur Verfügung steht. Für den Einsatz auf eigenen Systemen bietet das Unternehmen kommerzielle Lizenzen an.

Für Forschungszwecke stellt Mistral AI die Modellgewichte von Ministral 8B Instruct zur Verfügung. Das Unternehmen kündigt an, dass beide Modelle in Kürze auch über Cloud-Partner wie Google Vertex und AWS verfügbar sein werden.

KI-News ohne Hype – von Menschen kuratiert

Mit dem THE‑DECODER‑Abo liest du werbefrei und wirst Teil unserer Community: Diskutiere im Kommentarsystem, erhalte unseren wöchentlichen KI‑Newsletter, 6× im Jahr den „KI Radar"‑Frontier‑Newsletter mit den neuesten Entwicklungen aus der Spitze der KI‑Forschung, bis zu 25 % Rabatt auf KI Pro‑Events und Zugriff auf das komplette Archiv der letzten zehn Jahre.

Jetzt abonnierenKI-News ohne Hype

Von Menschen kuratiert.

- Mehr als 20 Prozent Launch-Rabatt.

- Lesen ohne Ablenkung – keine Google-Werbebanner.

- Zugang zum Kommentarsystem und Austausch mit der Community.

- Wöchentlicher KI-Newsletter.

- 6× jährlich: „KI Radar“ – Deep-Dives zu den wichtigsten KI-Themen.

- Bis zu 25 % Rabatt auf KI Pro Online-Events.

- Zugang zum kompletten Archiv der letzten zehn Jahre.

- Die neuesten KI‑Infos von The Decoder – klar und auf den Punkt.