Neue Funktionen für Google Translate: Live-Übersetzung und Sprachlernmodus starten

Google hat zwei neue KI-Funktionen für seinen Übersetzungsdienst angekündigt. Nutzer:innen können künftig Live-Gespräche in Echtzeit übersetzen lassen und personalisierte Sprachübungen absolvieren.

Mit der neuen Live-Funktion können Nutzer:innen bidirektionale Gespräche in Echtzeit führen. Die App übersetzt dabei sowohl Audio als auch Text auf dem Bildschirm. Laut Google funktioniert das in mehr als 70 Sprachen, darunter Arabisch, Französisch, Hindi, Koreanisch, Spanisch und Tamil.

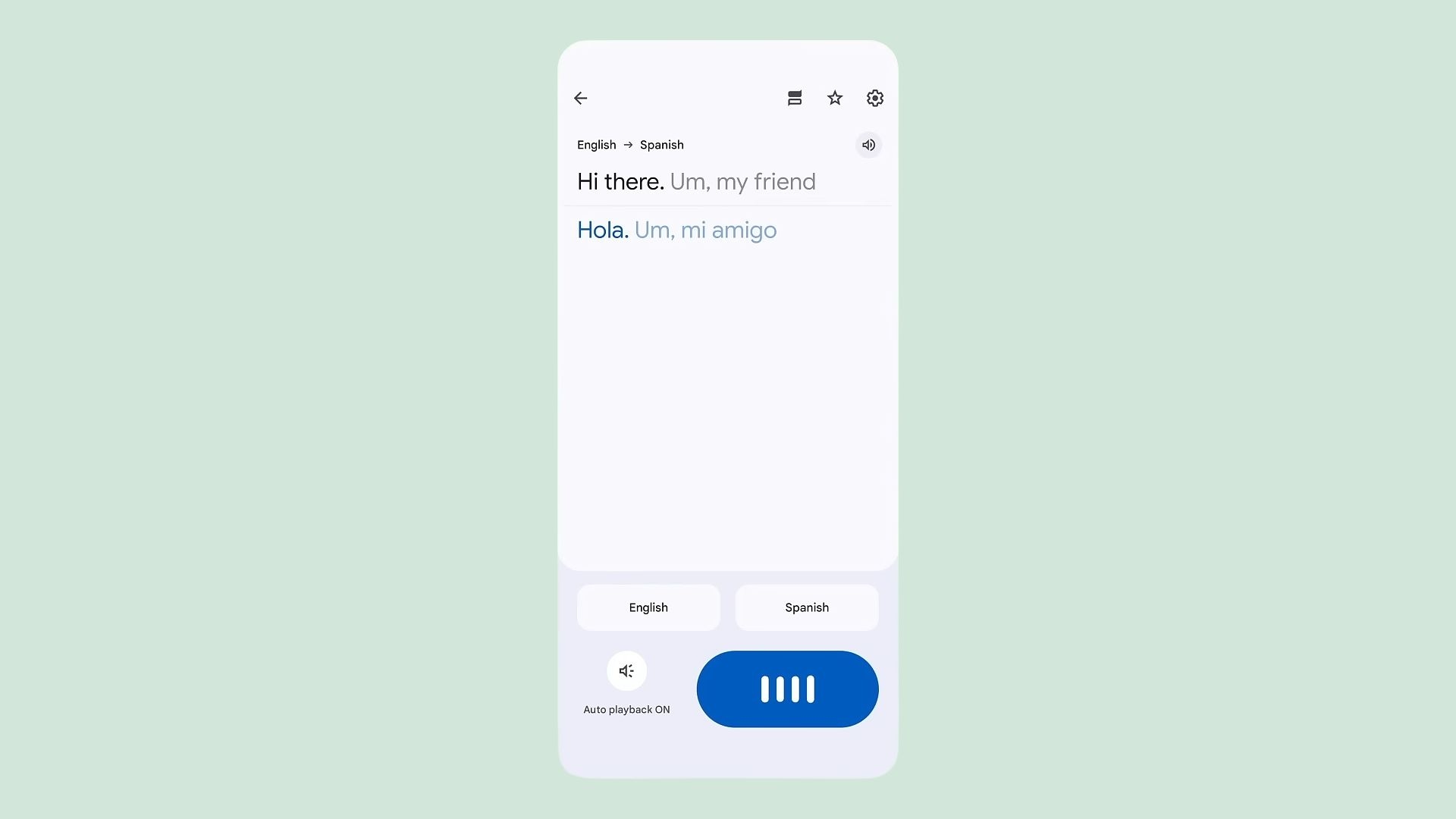

Nutzer:innen tippen in der Android- oder iOS-App auf "Live translate", wählen die gewünschten Sprachen aus und sprechen direkt los. Die App gibt die Übersetzung hörbar aus und zeigt gleichzeitig ein Transkript beider Sprachen auf dem Display an.

Das System wechselt automatisch zwischen den beiden Sprachen der Gesprächspartner:innen. Dabei erkennt es Gesprächspausen, Akzente und Intonationen. Nutzer:innen müssen nur einmal tippen und können dann natürlich sprechen.

Google nutzt für die Live-Funktionen erweiterte Sprach- und Spracherkennungsmodelle, die Geräusche isolieren können. Laut dem Unternehmen funktioniert die Übersetzung daher auch in lauten Umgebungen wie Flughäfen oder Cafés. Die Live-Übersetzung steht ab sofort für Nutzer:innen in den USA, Indien und Mexiko zur Verfügung.

Personalisierte Sprachübungen im Beta-Test

Google testet außerdem eine neue "practice"-Funktion. Diese erstellt maßgeschneiderte Hör- und Sprechübungen für verschiedene Lernziele. Laut Google haben Nutzer:innen zurückgemeldet, dass Konversation beim Sprachenlernen am schwierigsten sei, vor allem das selbstbewusste Hören und Sprechen zu relevanten Themen.

Die neue Funktion generiert spontan interaktive Übungen, die sich an das individuelle Fähigkeitsniveau anpassen. Nutzer:innen können über "practice" in der App ihr Level und ihre Ziele festlegen, Translate erstellt dann passende Szenarien.

Die Übungen teilen sich in zwei Kategorien: Beim Hörverständnis hören Nutzer:innen Gespräche und tippen die Wörter an, die sie verstehen. Bei der Sprechpraxis können sie selbst sprechen und erhalten bei Bedarf Hinweise.

Lernexpert:innen haben laut Google die Übungen auf Basis aktueller Spracherwerbsstudien entwickelt. Die App verfolgt den täglichen Fortschritt und hilft dabei, Kommunikationsfähigkeiten in anderen Sprachen aufzubauen.

Nach positivem Feedback früher Tester:innen rollt Google die Beta-Version diese Woche breiter aus. Sie steht zunächst englischsprachigen Nutzer:innen für Spanisch und Französisch zur Verfügung sowie spanisch-, französisch- und portugiesischsprachigen Nutzer:innen für Englisch.

Gemini-Modelle für Multimodalität und Reasoning

Auf welcher Architektur die neuen Funktionen genau basieren, verrät die Ankündigung nicht. Das Unternehmen gibt jedoch an, dass die beiden neuen Features die erweiterten Reasoning- und multimodalen Fähigkeiten der Gemini-Modelle verwenden.

Seit seiner Einführung im Jahr 2006 ist der Google-Übersetzer kostenlos nutzbar. Auch im offiziellen Blogeintrag zur aktuellen Ankündigung gibt es keine Hinweise auf eine Änderung dieses Modells.

Da KI-gestützte Funktionen wie Übersetzungen jedoch erhebliche Rechenressourcen benötigen, bleibt offen, ob Google bestimmte Features – etwa die Live-Übersetzung – künftig kostenpflichtig anbieten wird. Nach Googles Angaben übersetzen Menschen monatlich rund eine Billion Wörter über Google Translate, Search und die visuellen Übersetzungen in Lens und Circle to Search.

KI-News ohne Hype – von Menschen kuratiert

Mit dem THE‑DECODER‑Abo liest du werbefrei und wirst Teil unserer Community: Diskutiere im Kommentarsystem, erhalte unseren wöchentlichen KI‑Newsletter, 6× im Jahr den "KI Radar"‑Frontier‑Newsletter mit den neuesten Entwicklungen aus der Spitze der KI‑Forschung, bis zu 25 % Rabatt auf KI Pro‑Events und Zugriff auf das komplette Archiv der letzten zehn Jahre.

Jetzt abonnierenKI-News ohne Hype

Von Menschen kuratiert.

- Mehr als 16 % Rabatt.

- Lesen ohne Ablenkung – keine Google-Werbebanner.

- Zugang zum Kommentarsystem und Austausch mit der Community.

- Wöchentlicher KI-Newsletter.

- 6× jährlich: “KI Radar” – Deep-Dives zu den wichtigsten KI-Themen.

- Bis zu 25 % Rabatt auf KI Pro Online-Events.

- Zugang zum kompletten Archiv der letzten zehn Jahre.

- Die neuesten KI‑Infos von The Decoder – klar und auf den Punkt.