Ein Forscherteam präsentiert die erste hochwertige Echtzeit-Renderinglösung für Strahlungsfelder mit Trainingszeiten im Minutenbereich und Renderraten von über 100 FPS.

Forschende von Inria, dem Max-Planck-Institut für Informatik und der Université Côte d'Azur haben einen neuen Ansatz für das hochwertige Echtzeit-Rendering von Strahlungsfeldern aus realen Szenen vorgestellt. Ihre Methode erreicht eine sehr hohe visuelle Qualität bei sehr kurzen Trainingszeiten, die mit früheren schnellen NeRF-Methoden konkurrieren können, und Echtzeit-Rendering weit über dem Goldstandard von 30 fps. Kurz: Aus ein paar dutzend Fotos lassen sich nach wenigen Minuten fotorealistische 3D-Szenen in Echtzeit rendern.

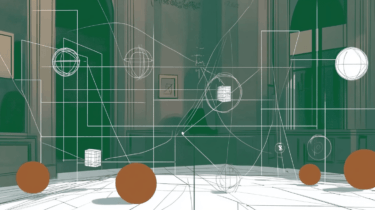

Video: Kerbl, Kopanas et al.

Der Schlüssel liegt in der Darstellung der Szene durch einen Satz von "3D Gaussians", im Wesentlichen hier eine Funktion für flexible 3D-Formen, die auch sehr effizient durch Projektion in 2D gerastert werden kann. Die Methode beginnt mit einem Basissatz von Punkten, die aus einer Standard-Kamerakalibrierungstechnik namens Structure-from-Motion (SfM) stammen. Aus diesen Punkten erzeugt die Methode die Repräsentation. Jede davon hat eine zentrale Position, eine Matrix, die ihre Form und Richtung angibt, sowie ihren Transparenzgrad (Opazität). Unter Verwendung der Eingabebilder als Referenz und anderer Techniken nimmt das Verfahren dann eine Feinabstimmung des Renderings vor, indem es diese Repräsentationen anpasst.

Hochwertiges Rendering mit über 100 FPS

Für ein schnelles Rendering haben die Autoren einen GPU-Rasterizer entwickelt, der die 3D-Formen 2D projiziert. Dieses Werkzeug ordnet die Repräsentationen in einer bestimmten Reihenfolge an und stellt sicher, dass sie korrekt ineinander übergehen und erhält die notwendigen Details jedes Bildes.

Die Methode ermöglicht das Echtzeit-Rendering von 1080p-Ansichten mit mehr als 100 FPS und in einer Qualität, die den derzeit besten Methoden wie Mip-NeRF360, die bis zu 48 Stunden Trainingszeit benötigen, ebenbürtig oder sogar überlegen ist. Die Optimierung dauert jedoch nur wenige Minuten und ist damit konkurrenzfähig zu den derzeit schnellsten Methoden wie InstantNGP.

"Erster Ansatz, der wirklich in Echtzeit ein qualitativ hochwertiges Strahlungsfeld erbringt"

Laut dem Team bietet die neue Methode eine kompakte, flexible Szenendarstellung, die einen neuen Standard setzt: "Wir haben den ersten Ansatz vorgestellt, der wirklich eine qualitativ hochwertige Echtzeitdarstellung von Strahlungsfeldern in einer Vielzahl von Szenen und Aufnahmestilen ermöglicht und dabei Trainingszeiten benötigt, die mit den schnellsten bestehenden Methoden konkurrieren", schreiben sie.

Da mehr als 80 Prozent der Trainingszeit auf Python-Code entfallen, geht das Team davon aus, dass eine Portierung der verbleibenden Optimierungen auf CUDA zu einer weiteren deutlichen Beschleunigung führen könnte. Außerdem wollen sie die verbleibenden Artefakte reduzieren und untersuchen, wie sich ihre Methode mit klassischen Renderformaten wie Meshes kombinieren lässt.

Weitere Informationen, Beispiele und Code sind auf der Projekt-Website verfügbar.