Googles neue Grafik-KI rendert fotorealistische Szenen aus 360-Grad-Aufnahmen und ermöglicht den Einsatz von NeRFs in Alltagsumgebungen.

Neural Radiance Fields (NeRFs) sind künstliche neuronale Netze, die aus einer Reihe von Bildern eine volumetrische Repräsentation eines Objektes lernen und anschließend dieses Objekt auch aus neuen Blickwinkeln darstellen können. Für die fotorealistischen Renderings setzen NeRFs auf eine dem Raytracing ähnliche Technik.

Die Technologie hat in den letzten Jahren große Fortschritte gemacht: Sie erzeugt beeindruckende Szenen, rendert immer schneller und lässt sich schneller trainieren. Forschende von Nvidia sehen Künstliche Intelligenz daher zunehmend als echte Alternative zu herkömmlichen Methoden der Computergrafik.

NeRFs haben Probleme mit komplexen Szenen

Doch die bisher beeindruckendsten Ergebnisse stammen von Foto-Modellen, die ohne Hintergrund dargestellt werden können oder echten Objekten, die in einem begrenzten Raum aus einem relativ stabilen Blickwinkel gezeigt werden.

Bei "unbegrenzten" Szenen, bei denen die Kamera in jede beliebige Richtung zeigen und der Inhalt in beliebiger Entfernung liegen kann - also vollständigen 3D-Szenen vergleichbar mit einem Computerspiel - versagen NeRFs bisher.

Am Rand der Videos ist der unscharfe Hintergrund zu erkennen. | Video: Google

In diesen Fällen erzeugen die KI-Systeme verschwommene und niedrig aufgelöste Renderings und weisen Bildartefakte auf, da sie die Skalierung von nahen und entfernten Objekten nicht korrekt lernen.

Für die Darstellung von Echtwelt-Objekten, die vor natürlichen Hintergründen wie einem Garten stehen, eignen sich NeRFs daher nur, wenn die Kamera sich nicht um das Objekt bewegt, sondern stetig in die gleiche Richtung zeigt.

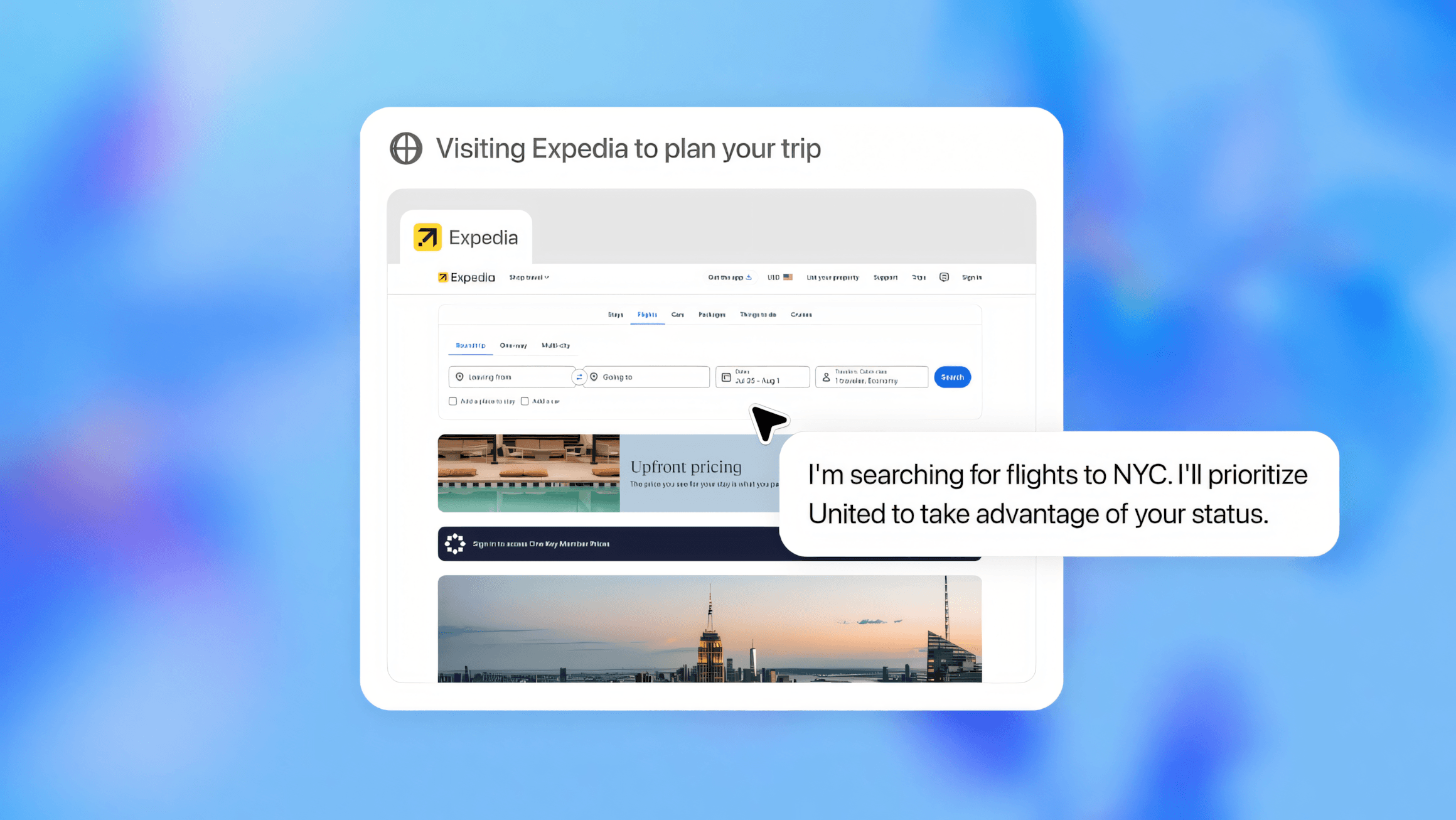

Mip-NeRF 360 verbessert Darstellung von Echtwelt-Aufnahmen

Google-Forschende zeigen nun mip-NeRF 360, ein KI-System, das 360-Grad-Renderings von Echtwelt-Objekten mit komplexen Hintergründen ermöglicht. Die Forschenden verbesserten dafür die Trainingsmethode, wandten etwa eine Grob-zu-Fein-Strategie an, bei der grobe und feine Strahlenintervalle für das Sampling der Szene genutzt werden.

Das Ergebnis sind fotorealistische 360-Grad-Aufnahmen, bei denen auch feinere Details wie Gras oder Blätter im Hintergrund noch erkennbar sind. Mip-NeRF 360 erzeugt außerdem detaillierte Tiefeninformationen für jede Szene.

Video: Google

Die Grenzen des Systems liegen laut Google in sehr feinen Details. Die Qualität nehme zudem ab, wenn die Kamera zu weit von der Mitte der Szene entfernt werde und die Trainingszeit liege wie bei vielen anderen NeRF-Architekturen bei mehreren Stunden.

Weitere Informationen gibt es auf der Projektseite von mip-NeRF 360.

Mehr über Künstliche Intelligenz für Computergrafik gibt’s in unserem DEEP MINDS KI-Podcast zum Thema.