Nvidia G-Assist nutzt 8-Milliarden-Parameter-Modell und läuft ohne Cloud-Anbindung

Nach einer ersten Vorschau auf der Computex 2024 ist das Tool nun für Desktop-RTX-GPU-Nutzer über die Nvidia-App verfügbar, während die Unterstützung für Laptops später folgen soll.

Nvidia hat Project G-Assist veröffentlicht, einen experimentellen KI-Assistenten, der lokal auf GeForce RTX-Grafikkarten läuft. Die Veröffentlichung reiht sich in einen breiteren Trend ein, bei dem große Technologieunternehmen KI-Assistenten speziell für Gamer entwickeln. Microsoft arbeitet beispielsweise an einem "Copilot for Gaming", der zunächst als Chat-Assistent für Spieltipps dienen und später auch Spielszenen in Echtzeit analysieren soll. Auf der Computex in Taiwan hatte Nvidia bereits verschiedene KI-Produkte präsentiert, darunter eine Variante von Project G-Assist für kontextabhängige Hilfe in Spielen, Nvidia ACE für digitale Menschen und das RTX AI Toolkit für Entwickler.

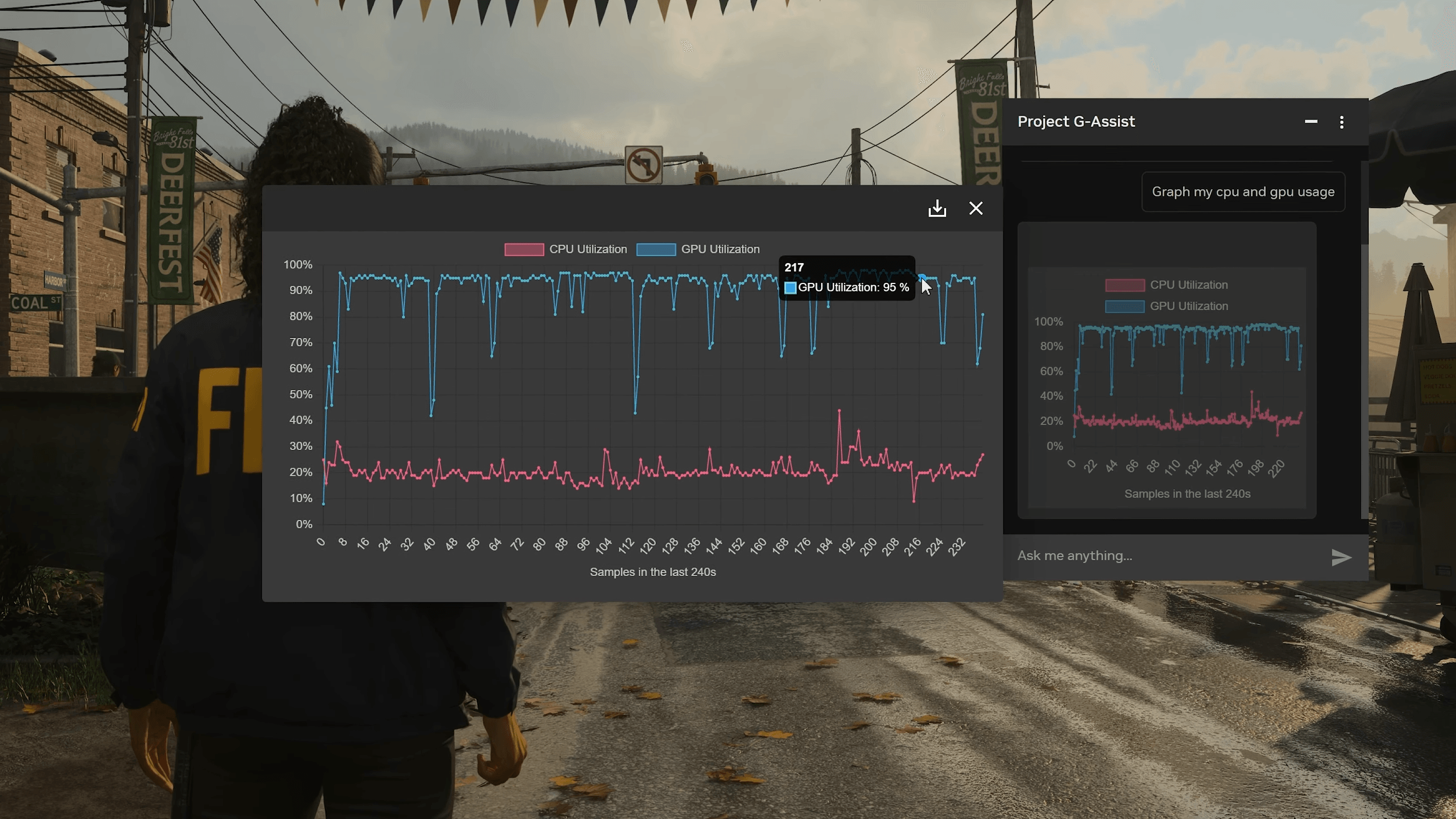

Im Gegensatz zu cloudbasierten KI-Assistenten, die Internetverbindungen und Abonnements erfordern, läuft G-Assist vollständig auf der GeForce RTX-GPU des Nutzers und verwendet ein Llama-basiertes Modell mit 8 Milliarden Parametern. Bei Aktivierung über Alt+G weist die GPU vorübergehend Ressourcen für die KI-Verarbeitung zu, was kurzzeitig die Leistung anderer Anwendungen beeinträchtigen kann. Das System setzt RTX-Grafikkarten der 30er-, 40er- oder 50er-Serie mit mindestens 12 GB VRAM voraus.

G-Assist soll von der Community verbessert werden

G-Assist führt Funktionen wie Systemdiagnose, Spieloptimierung, GPU-Übertaktung und Leistungsüberwachung durch. Der Assistent kann zudem kompatible Peripheriegeräte von Logitech, Corsair, MSI und Nanoleaf steuern. Das Tool konzentriert sich speziell auf PC-bezogene Funktionen und nicht auf allgemeine Konversation.

Nvidia hat G-Assist für Community-Erweiterungen konzipiert und stellt ein GitHub-Repository bereit, in dem Entwickler Plugins mit JSON-Formaten erstellen können. Zu den Beispiel-Plugins gehören Spotify-Integration und Google Gemini-Anbindung. Das Unternehmen bittet aktiv um Nutzerfeedback, um die künftige Entwicklung dieser experimentellen Funktion zu lenken.

Nvidia hat eigenes Sprachmodell für NPCs entwickelt

G-Assist ist nicht Nvidias erster Vorstoß in Richtung lokaler KI-Assistenten. Bereits im Mai 2024 aktualisierte das Unternehmen seinen experimentellen Chatbot ChatRTX für RTX-GPU-Besitzer mit weiteren KI-Modellen, darunter Gemma von Google, ChatGLM3 und OpenAIs CLIP-Modell für die Fotosuche. Zudem präsentierte Nvidia kürzlich mit Nemotron-4 4B Instruct ein kompaktes Sprachmodell, das die Konversationsfähigkeiten von Spielfiguren verbessern soll.

Diese Entwicklung passt zu Nvidias langfristiger Vision, in der KI-Systeme zunehmend in Spiele und andere Anwendungen integriert werden. Bereits Ende 2018 zeigte Nvidia erstmals ein System, das eine interaktive 3D-Stadt in Echtzeit auf Basis von Trainingsvideos generieren konnte.

KI-News ohne Hype – von Menschen kuratiert

Mit dem THE‑DECODER‑Abo liest du werbefrei und wirst Teil unserer Community: Diskutiere im Kommentarsystem, erhalte unseren wöchentlichen KI‑Newsletter, 6× im Jahr den „KI Radar"‑Frontier‑Newsletter mit den neuesten Entwicklungen aus der Spitze der KI‑Forschung, bis zu 25 % Rabatt auf KI Pro‑Events und Zugriff auf das komplette Archiv der letzten zehn Jahre.

Jetzt abonnierenKI-News ohne Hype

Von Menschen kuratiert.

- Mehr als 20 Prozent Launch-Rabatt.

- Lesen ohne Ablenkung – keine Google-Werbebanner.

- Zugang zum Kommentarsystem und Austausch mit der Community.

- Wöchentlicher KI-Newsletter.

- 6× jährlich: „KI Radar“ – Deep-Dives zu den wichtigsten KI-Themen.

- Bis zu 25 % Rabatt auf KI Pro Online-Events.

- Zugang zum kompletten Archiv der letzten zehn Jahre.

- Die neuesten KI‑Infos von The Decoder – klar und auf den Punkt.