Nvidia stellt auf der SIGGRAPH neue Technologien für das industrielle Metaverse vor und veröffentlicht Werkzeuge für KI-Grafik.

Die SIGGRAPH (Special Interest Group on Computer Graphics and Interactive Techniques) ist eine jährliche Konferenz zu Computergrafik und findet seit 1974 statt. Im Rahmen der diesjährigen Veranstaltung zeigt Nvidias Gründer und CEO Jensen Huang, wie das Unternehmen KI, Computergrafik und das (industrielle) Metaverse zusammenbringen möchte.

"Die Kombination von KI und Computergrafik wird das Metaverse, die nächste Evolution des Internets, antreiben", so Huang zu Beginn der Nvidia-Präsentation.

Nvidias Präsentation zeigte in vier Abschnitten unterschiedliche Elemente dieses Projekts: Die neue Nvidia Omniverse Avatar Cloud Engine (ACE), Pläne für den Ausbau des Universal-Scene-Description-Standards (USD), der als "Sprache des Metaverses" dienen soll, umfassende Erweiterungen für Nvidias Omniverse und Werkzeuge für KI-Grafik.

Nvidia will Unternehmen den Einsatz digitaler Avatare ermöglichen

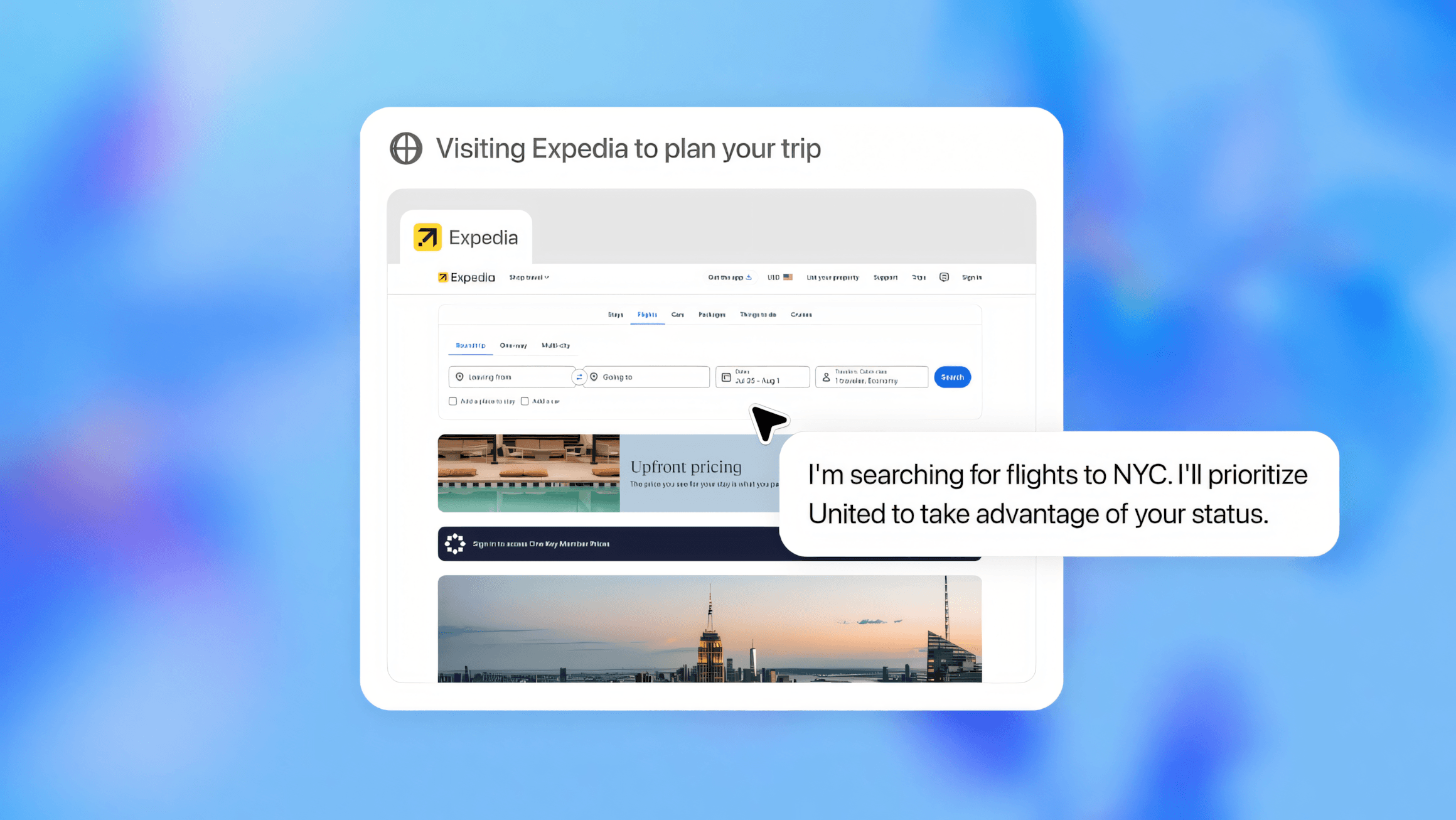

Nvidias Ominiverse Avatar Cloud Engine (ACE) umfasst eine Reihe von KI-Modellen, die die Entwicklung und Anpassung von lebensechten virtuellen Assistenten oder digitalen Menschen erleichtern soll. Dazu gehören etwa Modelle, die Audio in Lippenbewegungen verwandeln oder Emotionen sichtbar machen sollen, sowie Modelle zum Sprachverständnis wie Nvidias Megatron.

Durch die Verlagerung dieser Modelle und Dienste in die Cloud ermögliche ACE Unternehmen jeder Größe den sofortigen Zugriff auf die enorme Rechenleistung, die für die Entwicklung und den Einsatz von Assistenten und Avataren erforderlich sei, so Nvidia. Die Avatare könnten dank KI-Modellen mehrere Sprachen verstehen, auf Sprachaufforderungen reagieren, mit der Umgebung interagieren und intelligente Empfehlungen aussprechen.

Projekte wie Nvidias Maxine nutzten bereits ACE. Omniverse ACE soll im nächsten Frühjahr verfügbar sein und auf eingebetteten Systemen und allen wichtigen Cloud-Diensten laufen.

Nvidia will Universal Scene Description zur Sprache des Metaverse machen

Ein Metaverse benötige eine Standardmethode, um alle Inhalte innerhalb von 3D-Welten zu beschreiben, so Rev Lebaredian, Vizepräsident für Omniverse und Simulationstechnologie bei Nvidia. Das Unternehmen hält Pixars Universal Scene Description (USD) für die Standard-Szenenbeschreibung der nächsten Internet-Ära, fügte Lebaredian hinzu und vergleicht USD mit HTML im 2D-Web.

USD ist ein von Pixar entwickeltes Open-Source-Framework für den Austausch von 3D-Computergrafikdaten und wird in vielen Branchen eingesetzt, etwa Architektur, Design, Robotik und CAD.

Nvidia werde daher in Zusammenarbeit Pixar, sowie Adobe, Autodesk, Siemens und einer Reihe anderer führender Unternehmen eine mehrjährige Strategie verfolgen, um die Fähigkeiten von USD über visuelle Effekte hinaus zu erweitern. So soll USD industrielle Metaverse-Anwendungen in den Bereichen Architektur, Ingenieurwesen, Fertigung, wissenschaftliches Computing, Robotik und industrielle digitale Zwillinge besser unterstützen.

"Unsere nächsten Meilensteine zielen darauf ab, USD für virtuelle Welten und industrielle digitale Zwillinge in Echtzeit leistungsfähig zu machen", sagt Lebaredian. Nvidia will außerdem helfen, Unterstützung für internationale Zeichensätze, geospatiale Koordinaten und Echtzeit-Streaming von IoT-Daten zu entwickeln.

Nvidia setzt auf vernetztes Omniverse

Nvidia zeigte zudem zahlreiche Verbesserungen für Nvidias Omniverse. Huang bezeichnete Omniverse als "eine USD-Plattform, ein Toolkit für die Entwicklung von Metaverse-Anwendungen und eine Compute-Engine für den Betrieb virtueller Welten". Der neue Release enthält mehrere aktualisierte Kerntechnologien und mehr Verbindungen zu gängigen Tools.

Diese Omniverse Connectors genannten Verbindungen seien derzeit für Unity, Blender, Autodesk Alias, Siemens JT, SimScale, das Open Geospatial Consortium und andere in Entwicklung, Beta-Versionen für PTC Creo, Visual Components und SideFX Houdini seien nun verfügbar. Siemens Xcelerator sei zudem Teil des Omniverse-Netzwerks und soll digitale Zwillinge für mehr Industriekunden ermöglichen.

Omniverse erhält zudem neuronale Grafikfunktionen, die von Nvidia entwickelt wurden, darunter Instant NeRF für die schnelle Erstellung von 3D-Objekten und -Szenen aus 2D-Bildern und GauGAN360, eine Weiterentwicklung von GauGAN, die 8K, 360-Grad-Panoramen erzeugt.

Eine Erweiterung für Nvidias Modulus, ein Framework für maschinelles Lernen, ermögliche es zudem Entwickler:innen, KI-basierte Physiksimulationen bis zu 100.000-fach zu beschleunigen.

Fast ein Dutzend Partner werden auf der SIGGRAPH Omniverse-Funktionen vorstellen, darunter Hardware-, Software- und Cloud-Service-Anbieter von AWS und Adobe bis zu Dell, Epic und Microsoft.

In einer Demo zeigte etwa Industrial Light & Magic, wie Teams des Unternehmens mit der KI-Suche Omniverse DeepSearch riesige Asset-Datenbanken mit natürlicher Sprache durchsuchen und selbst dann Ergebnisse erhalten, wenn Metadaten zu den Suchbegriffen fehlen.

Nvidia liefert Werkzeuge für KI-Grafik und verbessert Visual-Effekt-Simulation OpenVDB

Eine der wesentlichen Säulen für das entstehende Metaversum sei neuronale Grafik, so Nvidia. In der neuronalen Grafik (oder neuronalem Rendering) werden neuronale Netze zur Beschleunigung und Verbesserung von Computergrafik eingesetzt.

"Neuronale Grafik verbindet KI und Grafik und ebnet den Weg für eine zukünftige Grafik-Pipeline, die aus Daten lernen kann", so Sanja Fidler, Vice President of AI bei Nvidia. "Neuronale Grafik wird die Art und Weise, wie virtuelle Welten erstellt, simuliert und von den Nutzern erlebt werden, neu definieren."

Instant-NGP kann Gigapixelbilder, SDFs, NeRFs und Neural Volumes in wenigen Sekunden lernen. | Video: Nvidia

Nvidia zeigt auf der SIGGRAPH 16 Forschungsarbeiten zu dem Thema, darunter Instant NGP, ein Werkzeug für verschiedene Anwendungen des neuronalen Rendering. Dieses und weitere KI-Werkzeuge sind nun in der PyTorch-Libary Kaolin Wisp für Neural-Fields-Forschung erhältlich.

Mehr über KI-Grafik erfahrt ihr in unserem DEEP-MINDS-Podcast #8 mit Nvidia-Forscher Thomas Müller.

Nvidia kündigte zudem NeuralVDB an, eine Weiterentwicklung des Open-Source-Standards OpenVDB. In den letzten zehn Jahren habe OpenVDB als Kerntechnologie, die in der Visual-Effects-Industrie eingesetzt wird, Academy Awards gewonnen, so Nvidia.

Seitdem habe sie sich über die Unterhaltungsbranche hinaus auf industrielle und wissenschaftliche Anwendungsfälle ausgeweitet, in denen spärliche volumetrische Daten eine Rolle spielen, etwa Industriedesign und Robotik.

Letztes Jahr zeigte Nvidia bereits mit NanoVDB, eine Unterstützung für GPUs, die die Berechnungen um ein Vielfaches beschleunigen kann. NeuralVDB baut auf diese Arbeit auf und nutzt maschinelles Lernen für kompakte neuronale Repräsentationen, die den Speicherbedarf bis zu 100-fach reduzieren. Das ermögliche die Interaktion mit extrem großen und komplexen Datensätzen in Echtzeit.