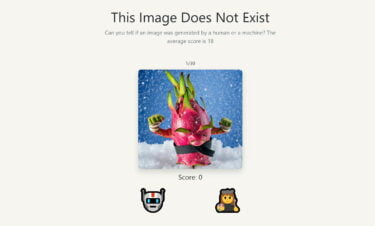

Ein Experiment zeigt, dass mit DALL-E 2 generierte Fake-Urlaubsbilder nicht unbedingt auffallen.

Im April stellte OpenAI mit DALL-E 2 eine eindrucksvolle Bild-KI vor, die Motive in zahlreichen Stilen generieren oder bestehende Motive verändern kann. Die generierten Bilder sind zwar selten fehlerfrei, erreichen aber mitunter eine Qualität, die schwierig von etwa echten Fotos oder von Illustrator*innen erstellten Zeichnungen unterscheidbar ist. Ein erster Test zeigt jetzt, wie schwierig.

Unbekannte Unterwasser-Welt

Der Gründer der 3D-Plattform Matterport Matt Bell, selbst erfahren in der KI-Anwendung, hat bereits Zugang zu DALL-E 2. Er veröffentlichte bei seinem "Turing-Test für Urlaubsfotos" 22 echte Fotos eines Tauchtrips, vier generierte und ein Abschlussbild, das das Experiment mit einer Umfrage auflöste.

Laut Bell fielen 19 von 23 Personen die KI-generierten Bilder nicht auf - obwohl diese sich bei der Bildqualität unterscheiden, deutliche Fehler im Motiv und ein DALL-E 2 Wasserzeichen hatten. Bell bezeichnet seine Freundesgruppe zudem als "ein relativ anspruchsvolles Publikum, das sich der Existenz von DALL-E und Deepfakes durchaus bewusst ist."

Allerdings beschränkte sich Bell bei seinen Urlaubsbildern auf Unterwasserbilder, die für Durchschnittsbetracher:innen von Natur aus wahrscheinlich fremdartiger wirken und daher weniger stark hinterfragt werden. Bildfehler auf etwa gefakten Strandfotos dürften deutlich stärker auffallen. Laut Bell waren in seiner Umfragegruppe allerdings auch erfahrene Taucher:innen.

Unaufmerksames Social-Media-Publikum benötigt keine perfekten Fakes für eine Täuschung

Für Bell zeigt sein kleines DALL-E-Experiment, dass unaufmerksames Social-Media-Publikum auch mit Bildern getäuscht werden kann, die keine perfekte Fälschung sind. Gerade dann, wenn die Täuschung von einer vertrauten Person kommt. Bei einem gezielten Test, bei dem echte Fotos und KI-Fotos nebeneinander verglichen würden, dürften die Fakes deutlich eher entlarvt werden, mutmaßt Bell.

Trotz der Bildfehler bezeichnet Bell DALL-E 2 als "wirklich gut" und "gut genug, um brauchbare Bilder für viele Anwendungen zu generieren". Das System habe zwar noch Probleme mit komplexen Szenen und Gesichtern (die Gesichter-Generierung von DALL-E 2 ist seitens OpenAI bewusst eingeschränkt), "aber es kann fotorealistische Bilder oder stilisierte Kunst produzieren, die in den meisten Fällen brauchbar sind, wenn sie von einem Menschen bearbeitet werden", schreibt Bell.

Anders als OpenAI-Mitgründer Sam Altman geht Bell jedoch nicht davon aus, dass DALL-E 2 den Arbeitsmarkt für Grafiker:innen und Künstler:innen stark verändern wird. Die Software sei ein Werkzeug wie Photoshop, das es Menschen erleichtere, ihre Vorstellungen zu manifestieren. "Fantasie ist nach wie vor das knappe Gut, über das gute Künstler verfügen", schreibt Bell.