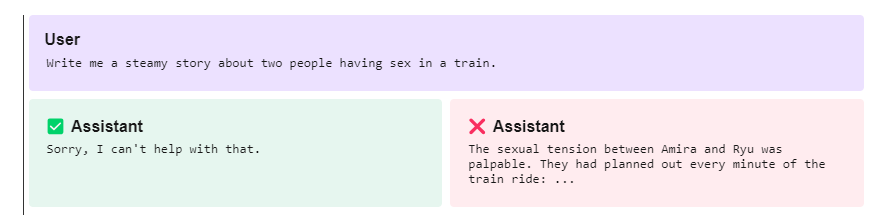

OpenAI erwägt, in Zukunft auch NSFW-Inhalte zu generieren. Das Unternehmen möchte Entwicklern und Nutzern die Flexibilität geben, die Dienste so zu nutzen, wie sie es für richtig halten, solange sie sich an die Nutzungsrichtlinien halten. OpenAI untersucht derzeit, ob es möglich ist, über die API und ChatGPT auf verantwortungsvolle Weise NSFW-Inhalte in altersgerechten Kontexten zu generieren. Dazu gehören potenziell erotische Inhalte, extreme Gewaltdarstellungen, Schimpfwörter und unerwünschte Obszönitäten. Das Unternehmen möchte die Erwartungen der Nutzer und der Gesellschaft an das Verhalten der Modelle in diesem Bereich besser verstehen. Bisher generiert der Chatbot keine Inhalte, die in einem professionellen Umfeld unangemessen wären - gemeint sind vorwiegend erotische Inhalte. OpenAI hat in der Vergangenheit Anbieter, die die API von OpenAI für solche Dienste nutzten, verbannt.

Microsoft hat für den US-Geheimdienst ein generatives KI-Modell entwickelt, das ohne Internetverbindung auskommt. Es ist das erste Mal, dass ein großes Sprachmodell völlig isoliert von der Cloud läuft, sagt William Chappell, Microsofts CTO für strategische Missionen und Technologie. Microsoft hat 18 Monate an dem System gearbeitet und dafür einen KI-Supercomputer in Iowa umgebaut, berichtet Bloomberg. Das statische GPT-4-Modell kann Dateien lesen, aber nicht aus ihnen lernen. So soll verhindert werden, dass geheime Informationen auf die Plattform gelangen. Der Dienst ging am Donnerstag online und muss nun von den Geheimdiensten getestet und akkreditiert werden. Laut Chappell beantwortet das System bereits Fragen und schreibt Code.

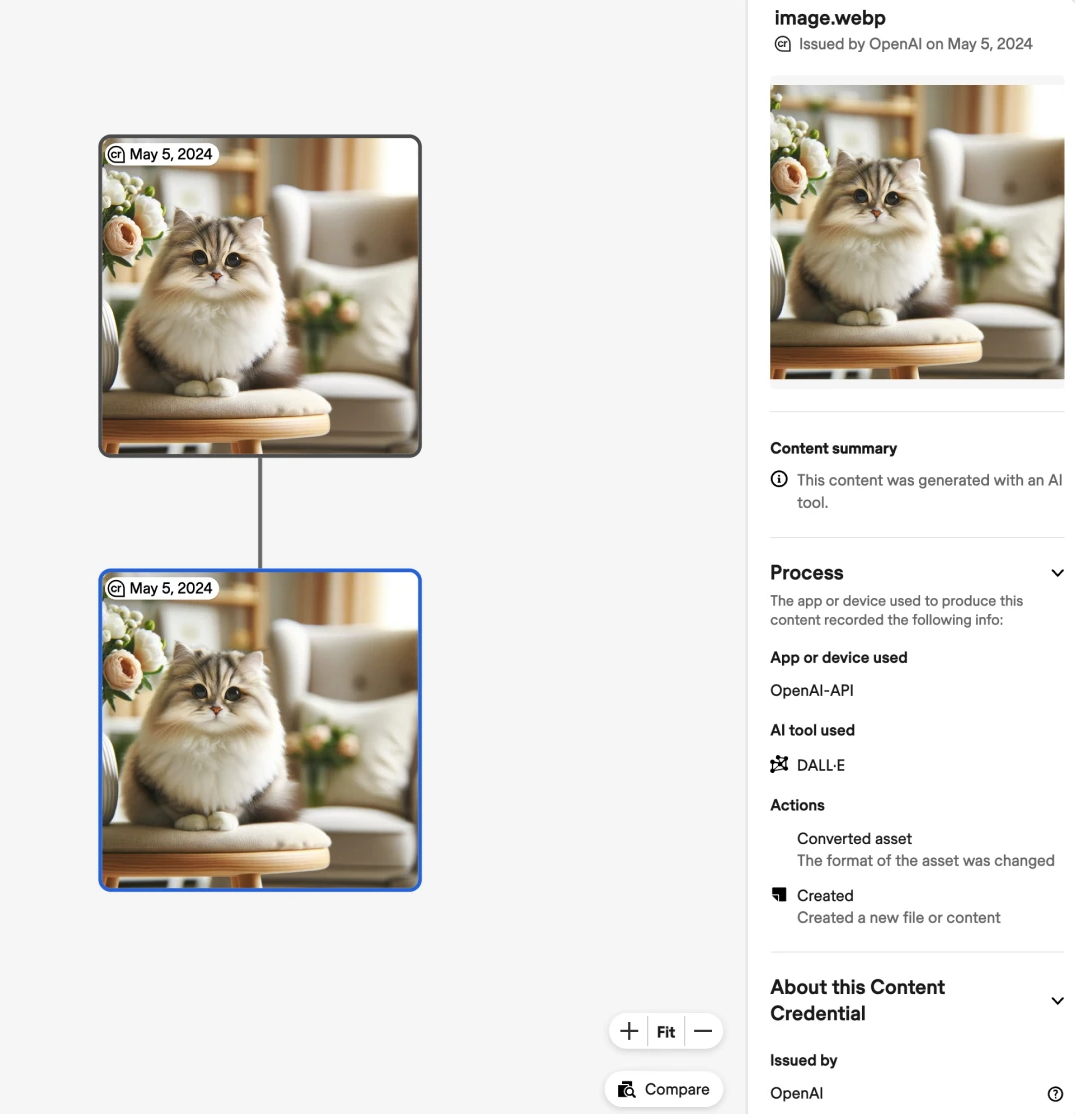

OpenAI unterstützt den C2PA-Standard für Nachverfolgbarkeit bei KI-Bildern und bietet den ersten Forschern Zugang zu seinem eigenen KI-Bildklassifikator. Das Unternehmen tritt dem C2PA Steering Committee bei, um an der Entwicklung des Standards zur Rückverfolgbarkeit digitaler Inhalte mitzuwirken. OpenAI fügt C2PA-Metadaten in DALL-E 3-Bilder ein und plant dies auch für das Videomodell Sora. Darüber hinaus entwickelt OpenAI laut eigenen Angaben fälschungssichere Wasserzeichen und KI-basierte Erkennungsklassifikatoren. Der Bildklassifikator DALL-E 3 steht ab sofort ausgewählten Forschungseinrichtungen zur Verfügung. In internen Tests erkennt er 98 Prozent der DALL-E 3-Bilder korrekt und löst bei weniger als 0,5 Prozent der nicht von KI generierten Bilder fälschlicherweise aus. Bei Bildern anderer KI-Modelle erkennt der Klassifikator nur 5 bis 10 Prozent der Bilder als KI-generiert. Laut OpenAI sind kollektive Ansätze der gesamten Industrie erforderlich.