- OpenAI-CEO Sam Altman hat nach einer Welle der Kritik an der Abschaltung von Codex verkündet, dass Wissenschaftler:innen weiterhin Zugriff auf das Modell haben werden. "Uns war nicht klar, wie sehr Menschen dieses Modell mögen; wir werden es weiterhin für Forschende unterstützen!", schreibt er auf Twitter.

Nur wenige Tage nach einem ersten Hinweis schließt OpenAI den API-Zugang zum KI-Modell Codex. Die kurzfristige Ankündigung sorgt bei einigen Anwendern für Unmut.

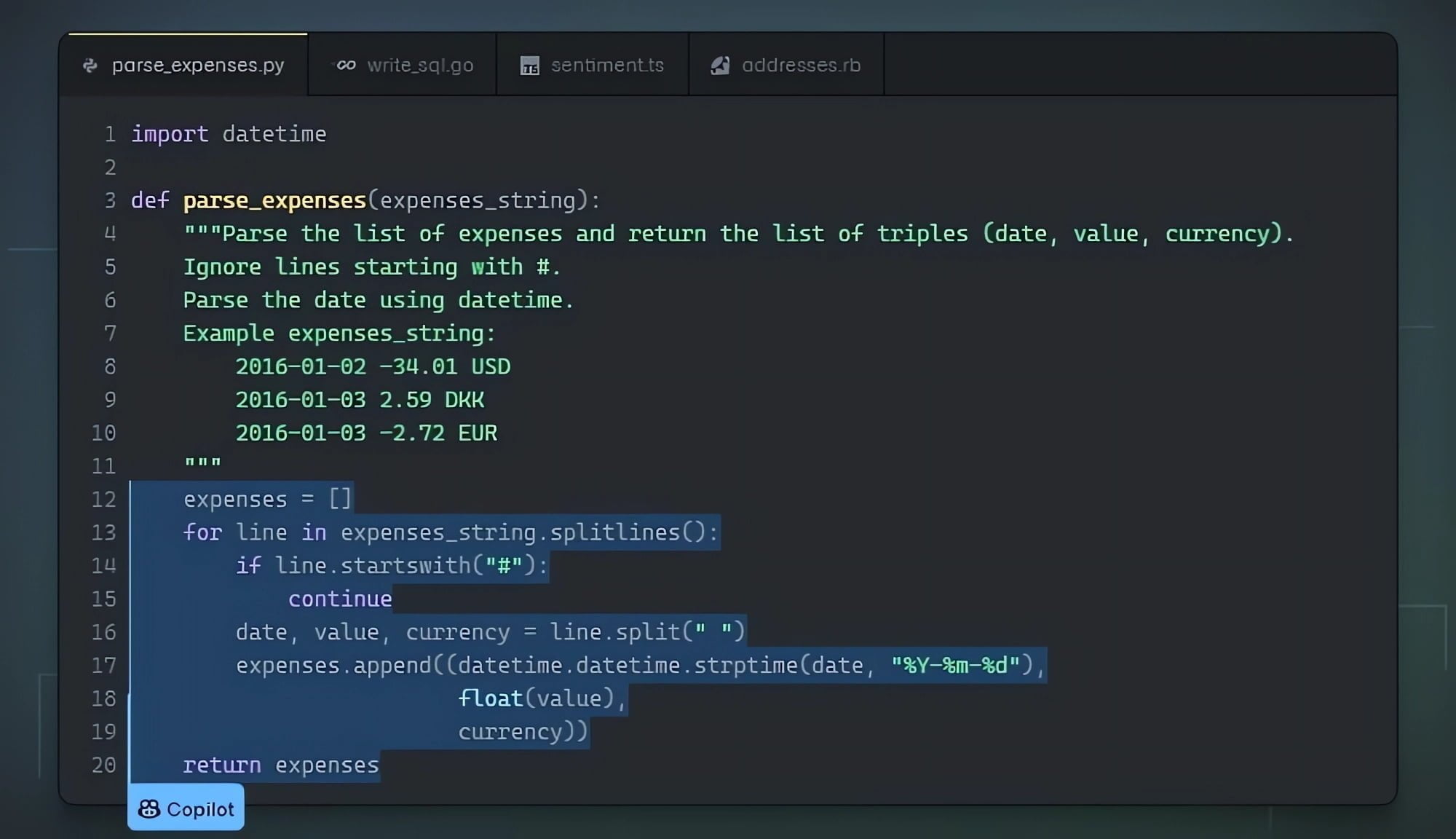

Während ChatGPT (GPT-3.5) und GPT-4 in der KI-Community besonders für ihre Programmierfähigkeiten gelobt werden, waren sie nicht die ersten Sprachmodelle, die für die Erstellung von Programm- und Webseitencode geeignet sind: Mit Codex hat OpenAI 2021 ein Modell vorgestellt, das auf Basis von GPT-3 speziell für diesen Anwendungsfall trainiert wurde und seitdem als kostenlose, eingeschränkte Beta-Version zur Verfügung steht.

Doch noch bevor Codex die Beta-Phase verlassen kann, stellt OpenAI das Modell am 23. März ein. Besonders die Kurzfristigkeit dieser Ankündigung sorgt für Unmut bei den Entwickler:innen. Da der Code und das Modell nicht öffentlich verfügbar sind, entfällt damit jede Möglichkeit, Codex überhaupt zu nutzen. Schließlich kann das Modell nicht einfach heruntergeladen und auf der eigenen Maschine ausgeführt werden.

Whoa - Open AI gave <1 week notice for discontinuing several models critical for many people (Codex), and suggested other deprecations will eventually follow without any specific timeline.

Building on top of OAI seems pretty risky unless they start offering more specific usage… https://t.co/4l41ZzVoIN

— Kevin Fischer (@KevinAFischer) March 21, 2023

GPT-3.5 kann wahrscheinlich besser coden

OpenAI empfiehlt allen Nutzer:innen, von Codex auf GPT-3.5 Turbo umzusteigen, also auf das Modell, das ChatGPT derzeit standardmäßig antreibt. Tatsächlich soll dies die Programmierergebnisse verbessern, was darauf hindeutet, dass große Sprachmodelle als Allzwecksysteme leistungsfähiger sein könnten.

Es stellt jedoch ein Problem für Wissenschaftler:innen dar, die auf Codex basierende Untersuchungen bald nicht mehr rekonstruieren können. Die US-Firma reagiert mit einer Stellungnahme, dass die Rahmenbedingungen von Codex von Anfang an klar kommuniziert wurden.

"Um das klarzustellen: Codex war kostenlos und befand sich in einer begrenzten Beta-Phase, die von Anfang an mit starken Einschränkungen verbunden war", sagt OpenAI-Ansprechpartner Logan Kilpatrick. "Ich werde versuchen, der Dokumentation bald ein Glossar hinzuzufügen, in dem die verschiedenen Begriffe erklärt werden, aber Codex ist ungleich unseren eigentlichen Modellen, die weithin verfügbar sind."

Codex wurde hauptsächlich mit Code aus den öffentlichen Repositories von GitHub trainiert und bildet die Grundlage für Microsofts GitHub Copilot, ein kommerzielles Angebot für assistiertes KI-Coding. GitHub macht weiter Werbung mit Codex, dürfte aber wahrscheinlich ebenfalls auf GPT-3.5 Turbo umsteigen, oder der Github Copilot geht in Microsofts generellem Office-Copilot auf.

Der Programmierer und Rechtsanwalt Matthew Butterick hat im November 2022 Klage gegen Microsoft, Github und OpenAI eingereicht, da GitHub Copilot Code-Ausschnitte von Entwickler:innen ohne Quellangabe wiedergebe und damit gegen Open-Source-Lizenzen verstoße.