RunwayML: KI-Video-Editor kommt aufs iPhone

RunwayML ist ein Videoeditor mit zahlreichen KI-Technologien, der jetzt auch als iPhone App verfügbar ist.

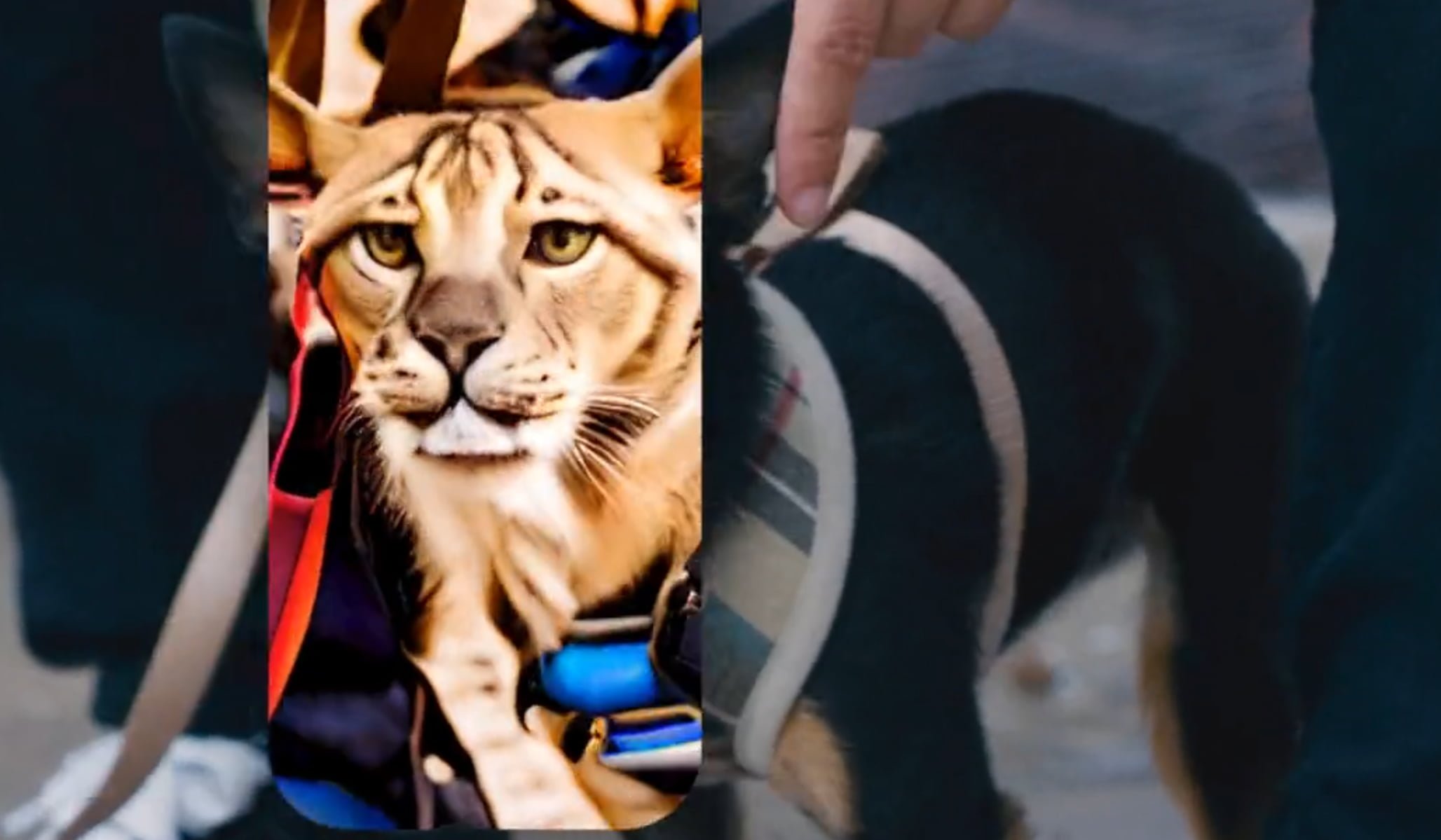

Die iPhone App bietet Funktionen des KI-Modells Gen-1 von RunwayML. Das New Yorker Start-up stellte das Modell im vergangenen Februar vor: Es kann Videos neue Stile verleihen, ähnlich einer Filtertechnologie, wie man sie von Instagram kennt, aber mit einem visuell viel stärkeren Eingriff und deutlich flexibler.

So kann etwa eine realistisch gefilmte Person in eine Claymation-Figur oder eine lebendige Zeichnung verwandelt werden. Die Stadtkulisse verwandelt sich in eine apokalyptische Szene aus einem Roland-Emmerich-Film und der Schoßhund wird zum Tiger (siehe Titelbild). Für den Effekt kann man aus einer Auswahl von Stilen wählen, einen Textbefehl eingeben oder ein Referenzbild angeben.

The magic of Gen-1. Now on your phone.

Download the new Runway iOS app today: https://t.co/kYfzzHfOfp pic.twitter.com/1GySmhJkby

— Runway (@runwayml) April 24, 2023

RunwayML ist ab sofort kostenlos für aktuelle iPhones im App-Store verfügbar. Wer bereits einen Runway-Account für die Web-Version besitzt, kann damit Assets zwischen Smartphone und PC austauschen.

Gen-2 kann schon kurze Videos generieren

RunwayML ist in Sachen KI-Video schon einen Schritt weiter: Das neuere Modell Gen 2 kann bereits kurze Videos aus Texteingaben oder aus einer Kombination von Bild und Text generieren. Gen 2 ist derzeit in einer Beta-Fassung in der Web-Version verfügbar. Bei Twitter teilen die ersten Nutzer:innen einige Beispiele.

My very first text to video with #Gen2

text_prompt: a woman wearing a white dress meditating, standing on water, peaceful day, the most beautiful sceneIf you have access to #Get1 Discord you can go there and find a thread and enjoy #Gen2 That's how I found it. pic.twitter.com/RErmjjHLhH

— Kris Kashtanova (@icreatelife) April 20, 2023

So practical text-to-video generation just happened.

Here's "futuristic car speeding" using Runway v2. It is a short clip, for now... pic.twitter.com/cGV4XRy4My

— Ethan Mollick (@emollick) April 20, 2023

Für wenige Sekunden Video benötigt das System allerdings mehrere Minuten Rechenzeit, zudem enthalten die Videos noch Bildfehler und sind etwas ruckelig. Neben Runway arbeitet Google an Phenaki, einem Text-zu-Video-KI-System, und Meta an Make-a-Video. Meta hat mit Dreamix ein weiteres Modell speziell für die Text-zu-Video-Bearbeitung in Arbeit.

Die Frage wird sein, ob die enorm schnelle Entwicklung bei Bild-KI-Systemen auch für Video-KI-Systeme gelten wird. Wenn ja, dürften zumindest Videodatenbanken für Stock-Material oder kurze Social-Media-Clips ernsthafte KI-Konkurrenz bekommen.

KI-News ohne Hype – von Menschen kuratiert

Mit dem THE‑DECODER‑Abo liest du werbefrei und wirst Teil unserer Community: Diskutiere im Kommentarsystem, erhalte unseren wöchentlichen KI‑Newsletter, 6× im Jahr den "KI Radar"‑Frontier‑Newsletter mit den neuesten Entwicklungen aus der Spitze der KI‑Forschung, bis zu 25 % Rabatt auf KI Pro‑Events und Zugriff auf das komplette Archiv der letzten zehn Jahre.

Jetzt abonnierenKI-News ohne Hype

Von Menschen kuratiert.

- Mehr als 16 % Rabatt.

- Lesen ohne Ablenkung – keine Google-Werbebanner.

- Zugang zum Kommentarsystem und Austausch mit der Community.

- Wöchentlicher KI-Newsletter.

- 6× jährlich: “KI Radar” – Deep-Dives zu den wichtigsten KI-Themen.

- Bis zu 25 % Rabatt auf KI Pro Online-Events.

- Zugang zum kompletten Archiv der letzten zehn Jahre.

- Die neuesten KI‑Infos von The Decoder – klar und auf den Punkt.