Google Deepminds neuer KI-Agent zockt Spiele nur per Sprachfehl

SIMA von DeepMind kann Aufgaben in verschiedenen Videospielwelten wie Valheim oder No Man's Sky via Text-Prompt erledigen.

Forscher von Google DeepMind stellen den Scalable Instructable Multiworld Agent (SIMA) vor, einen KI-Agenten für 3D-Videospielumgebungen, der Anweisungen in natürlicher Sprache in Aktionen umsetzen kann.

SIMA wurde in Zusammenarbeit mit acht Spielestudios und mit neun verschiedenen Videospielen, darunter No Man’s Sky, Valheim und Teardown, trainiert und getestet.

Video: Google Deepmind

Das DeepMind-Team trainierte SIMA mit Spielaufzeichnungen, in denen entweder ein Spieler einem anderen Spieler Anweisungen gab oder sein eigenes Gameplay beschrieb. Das Team hat diese Anweisungen dann mit den Spielaktionen verknüpft.

Der Agent wird primär auf Verhaltensnachahmung trainiert (Behavioral Cloning). Dabei ahmt er die Aktionen nach, die Menschen in den gesammelten Daten ausgeführt haben, während sie den sprachlichen Anweisungen folgten.

Auf diese Weise lernt der Agent, Zusammenhänge zwischen Sprachanweisungen, visuellen Eindrücken und entsprechenden Aktionen herzustellen.

Google Deepmind SIMA nutzt vortrainierte Modelle und lernt von Menschen

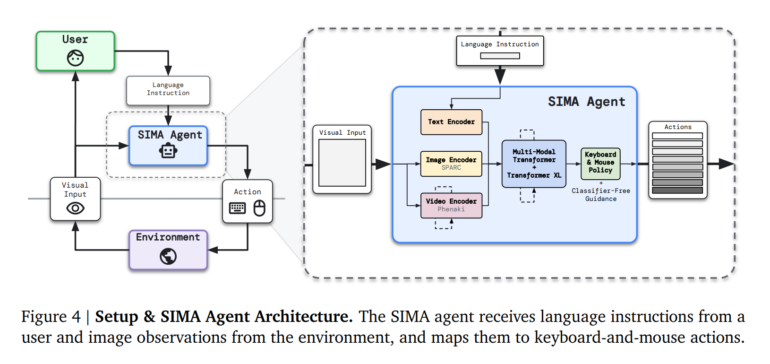

Der Kern des SIMA-Agenten besteht aus mehreren Komponenten, die zusammenarbeiten, um visuelle Eingaben (das, was der Agent "sieht") und Spracheingaben (die Anweisungen, die er erhält) in Aktionen (Tastatur- und Mausbefehle) umzuwandeln.

Bild- und Text-Encoder sind dafür verantwortlich, die visuellen und sprachlichen Eingaben in eine Form zu übersetzen, die der Agent verarbeiten kann. Dazu werden vortrainierte Modelle verwendet, die bereits über ein umfassendes Verständnis von Bildern und Texten verfügen.

Ein Transformer-Modell integriert die Informationen aus den Encodern und den vergangenen Aktionen, um eine interne Repräsentation des aktuellen Zustands zu bilden. Ein spezieller Speichermechanismus hilft dem Agenten, sich an frühere Aktionen und deren Ergebnisse zu erinnern, was für das Verständnis von Aufgaben mit mehreren Schritten entscheidend ist.

Schließlich verwendet der Agent diese Zustandsrepräsentation, um zu entscheiden, welche Aktionen als nächstes ausgeführt werden sollen. Diese Aktionen sind Tastatur- und Mausbefehle, die in der virtuellen Umgebung ausgeführt werden.

SIMA benötigt keinen Zugriff auf den Quellcode des Spiels, sondern nur Bildschirmbilder und Anweisungen in natürlicher Sprache. Der Agent interagiert mit der virtuellen Umgebung über Tastatur und Maus und ist daher potenziell mit jeder virtuellen Umgebung kompatibel.

SIMA beherrscht 600 Fähigkeiten

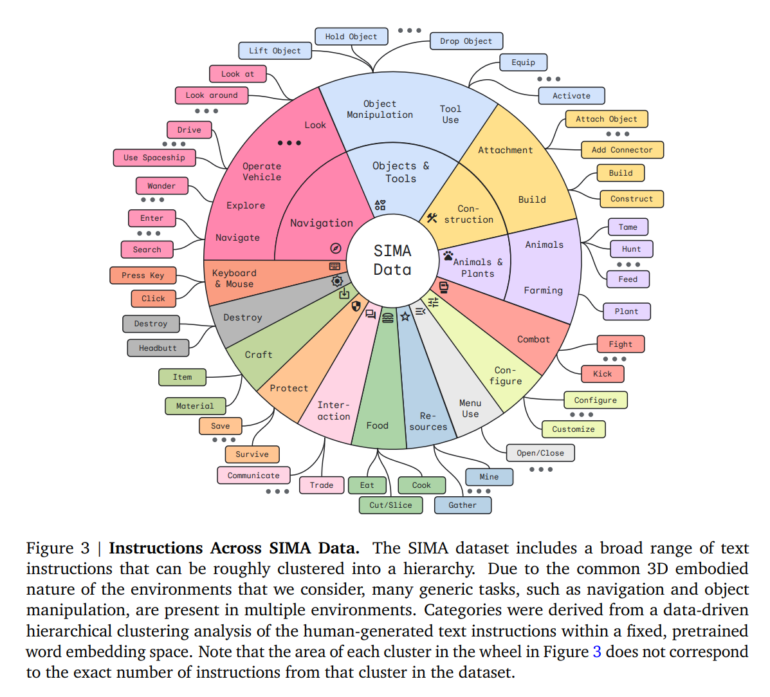

In Tests beherrschte SIMA 600 grundlegende Fähigkeiten wie Navigation, Interaktion mit Objekten und Menübedienung. Das Team geht davon aus, dass zukünftige Agenten in der Lage sein werden, komplexe strategische Planungen und vielschichtige Aufgaben zu bewältigen.

SIMA unterscheidet sich von anderen KI-Systemen für Videospiele durch seinen breiten Ansatz, der das Lernen in einer Vielzahl von Umgebungen umfasst, anstatt sich auf eine oder wenige spezifische Aufgaben zu konzentrieren.

Forschungsergebnisse zeigen, dass ein in vielen Spielen trainierter Agent besser abschneidet als ein auf ein einziges Spiel spezialisierter Agent. Darüber hinaus integriert SIMA vorab trainierte Modelle, um von bereits vorhandenem Wissen über Sprache und visuelle Wahrnehmung zu profitieren, und kombiniert diese mit spezifischen Trainingsdaten aus den 3D-Umgebungen.

Auf diese Weise könnten die Forschungsergebnisse zur Entwicklung einer neuen Generation allgemeiner, sprachgesteuerter KI-Agenten beitragen, hofft das Team. Mit ausgefeilteren Modellen könnten Projekte wie SIMA eines Tages komplexe Ziele erreichen und für Menschen im Internet und in der realen Welt nützlich werden.

KI-News ohne Hype – von Menschen kuratiert

Mit dem THE‑DECODER‑Abo liest du werbefrei und wirst Teil unserer Community: Diskutiere im Kommentarsystem, erhalte unseren wöchentlichen KI‑Newsletter, 6× im Jahr den "KI Radar"‑Frontier‑Newsletter mit den neuesten Entwicklungen aus der Spitze der KI‑Forschung, bis zu 25 % Rabatt auf KI Pro‑Events und Zugriff auf das komplette Archiv der letzten zehn Jahre.

Jetzt abonnierenKI-News ohne Hype

Von Menschen kuratiert.

- Mehr als 16 % Rabatt.

- Lesen ohne Ablenkung – keine Google-Werbebanner.

- Zugang zum Kommentarsystem und Austausch mit der Community.

- Wöchentlicher KI-Newsletter.

- 6× jährlich: “KI Radar” – Deep-Dives zu den wichtigsten KI-Themen.

- Bis zu 25 % Rabatt auf KI Pro Online-Events.

- Zugang zum kompletten Archiv der letzten zehn Jahre.

- Die neuesten KI‑Infos von The Decoder – klar und auf den Punkt.