Stanford-Studie: Open-Source-KI-Modelle bergen keine größeren Risiken als geschlossene Modelle

Sind Open-Source-KI-Modelle gefährlicher als geschlossene Modelle wie GPT-4? Eine neue Studie verneint dies und gibt Empfehlungen für die Politik.

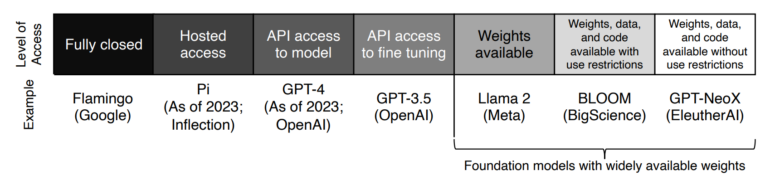

Open Foundation Models (OFM) bieten bedeutende Vorteile, indem sie Wettbewerb fördern, Innovationen beschleunigen und Machtverteilung verbessern, so der Schluss einer Studie des Stanford Institute for Human-Centered Artificial Intelligence. In der Studie untersuchten die Autoren die Auswirkungen von OFMs auf Gesellschaft und Politik, verglichen mögliche Risiken mit denen geschlossener Modelle und geben Empfehlungen an die Politik.

Zu den untersuchten Risiken von Open Foundation Models gehören Desinformation, Biorisiken, Cybersicherheit, Spear-Phishing, nicht einvernehmliche intime Bilder (NCII) und Bilder von Kindesmissbrauch (CSAM). Die Studie kommt zu dem Schluss, dass es derzeit nur begrenzte Belege für das marginale Risiko von OFMs im Vergleich zu geschlossenen Modellen oder bestehenden Technologien gibt.

Dort, wo sie besser dokumentiert sind, wie im Fall von NCII und CSAM, seien Vorschläge, die Verbreitung von OFMs durch die Lizenzierung rechenintensiver Modelle einzuschränken, unangemessen, da die Text-Bild-Modelle, die diese Schäden verursachen, wesentlich weniger Ressourcen zum Trainieren benötigen. Bestehende Sicherheitsmechanismen bei geschlossenen Modellen seien zudem ebenfalls anfällig. Die Autoren betonen jedoch, dass weitere Forschung notwendig ist, um die Risiken besser einschätzen zu können.

Warnung vor Überregulierung für Open-Source-Modelle

Gleichzeitig warnen sie davor, dass einige politische Vorschläge, wie die Haftung für Schäden durch nachgelagerte Nutzung oder strenge Anforderungen an die Herkunft von Inhalten, das Ökosystem der OFMs unverhältnismäßig stark beeinträchtigen könnten. Daher sollten politische Entscheidungsträger bei der Umsetzung solcher Maßnahmen Vorsicht walten lassen und eine angemessene Konsultation mit OFM-Entwicklern durchführen.

Laut dem Team sind die wichtigsten Erkenntnisse:

- OFMs bieten erhebliche Vorteile, indem sie der Marktkonzentration entgegenwirken, Innovationen fördern und die Transparenz verbessern.

- Einige politische Vorschläge zielen darauf ab, OFMs einzuschränken. Die entscheidende Frage ist das marginale Risiko offener Stiftungsmodelle im Vergleich zu (a) geschlossenen Modellen oder (b) bestehenden Technologien, aber die derzeitige Evidenz für dieses marginale Risiko ist recht begrenzt.

- Einige Interventionen zielen besser auf Stellen ab, die der Ebene des OFMs nachgelagert sind - also etwa auf Ebene einer Anwendung und nicht auf Modellebene.

- Einige aktuelle politische Vorschläge (z.B. Haftung für nachgeschaltete Schäden, Lizenzierung) könnten den Entwicklern offener Basismodelle unverhältnismäßig großen Schaden zufügen.

- Politische Entscheidungsträger sollten mögliche unbeabsichtigte Folgen der KI-Regulierung für das dynamische Innovationsökosystem rund um offene Basismodelle explizit berücksichtigen.

Metas KI-Chef Yann LeCun bezeichnete die Studie auf LinkedIn als einen "Haufen Nägel im Sarg der Idee, dass Open-Source-KI-Modelle gefährlicher sind als geschlossene". Damit zielt er auch auf OpenAI ab, das bereits mit GPT-2 begonnen hatte, seine Modelle zunächst nur eingeschränkt und schließlich gar nicht mehr zu veröffentlichen. "Seit der Veröffentlichung von Llama-2 hat es eine Explosion von Anwendungen gegeben, die auf Open-Source-LLMs basieren, und keines der von den Untergangspropheten der KI vorhergesagten Katastrophenszenarien".

KI-News ohne Hype – von Menschen kuratiert

Mit dem THE‑DECODER‑Abo liest du werbefrei und wirst Teil unserer Community: Diskutiere im Kommentarsystem, erhalte unseren wöchentlichen KI‑Newsletter, 6× im Jahr den "KI Radar"‑Frontier‑Newsletter mit den neuesten Entwicklungen aus der Spitze der KI‑Forschung, bis zu 25 % Rabatt auf KI Pro‑Events und Zugriff auf das komplette Archiv der letzten zehn Jahre.

Jetzt abonnierenKI-News ohne Hype

Von Menschen kuratiert.

- Mehr als 16 % Rabatt.

- Lesen ohne Ablenkung – keine Google-Werbebanner.

- Zugang zum Kommentarsystem und Austausch mit der Community.

- Wöchentlicher KI-Newsletter.

- 6× jährlich: “KI Radar” – Deep-Dives zu den wichtigsten KI-Themen.

- Bis zu 25 % Rabatt auf KI Pro Online-Events.

- Zugang zum kompletten Archiv der letzten zehn Jahre.

- Die neuesten KI‑Infos von The Decoder – klar und auf den Punkt.