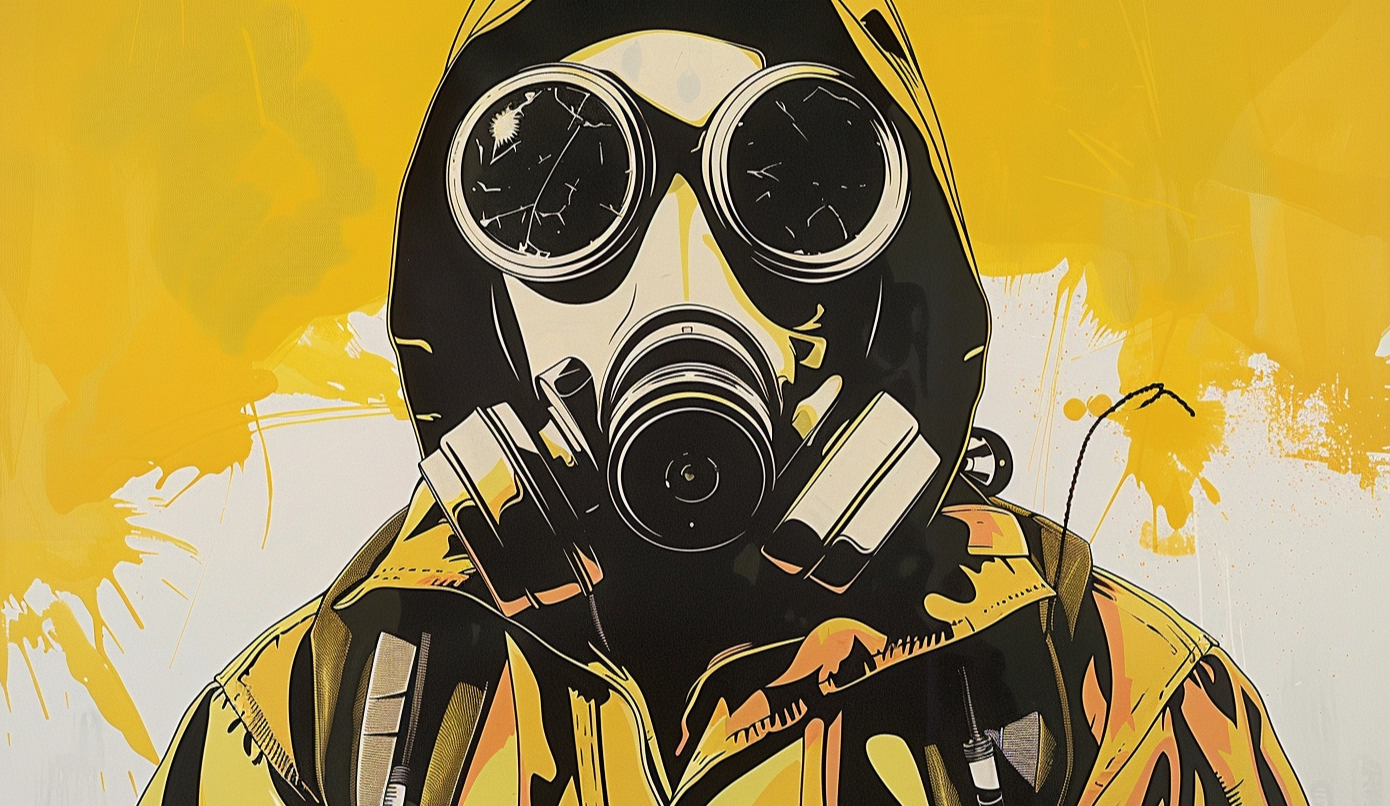

Wissenschaftler warnen vor Missbrauch von KI für Biowaffen-Entwicklung

Eine internationale Gruppe von Wissenschaftlern hat sich für verantwortungsvolle Praktiken beim KI-gestützten Proteindesign ausgesprochen, um die Entwicklung von Biowaffen zu verhindern.

Die Gruppe veröffentlichte eine Erklärung, in der sie das enorme Potenzial der KI-Technologie hervorhebt, das von schnelleren Reaktionen auf Infektionskrankheiten bis hin zur Energiegewinnung reicht. Gleichzeitig warnen die Unterzeichner vor dem Missbrauchspotenzial, das biologische Giftstoffe und Biowaffen einschließt.

Die derzeit 131 Unterzeichner und Unterzeichnerinnen, darunter Nobelpreisträgerin Frances Arnold und Turing-Preisträger Yann LeCun, fordern ein proaktives Risikomanagement, um möglichen Gefahren durch Missbrauch vorzubeugen.

Die Gruppe verpflichtet sich, Forschung ausschließlich zum Wohle der Gesellschaft zu betreiben und gefährliche Praktiken zu vermeiden. Ebenso sollen DNA-Synthesedienstleistungen nur von Anbietern bezogen werden, die standardisierte Biosicherheitsprüfungen durchführen. Auch die kontinuierliche Evaluierung von KI-Software und die Identifizierung von Sicherheitsrisiken sind Teil der Selbstverpflichtung.

Die Unterzeichner betonen die Bedeutung von Offenheit und wissenschaftlicher Freiheit, erkennen aber auch die Notwendigkeit an, den Zugang zu KI-Systemen zu beschränken, wenn diese ungelöste Risiken bergen. Die Technologie soll durch internationale Zusammenarbeit und integrative Forschungsansätze breiten Nutzen bringen.

Zugang zu Ausrüstung ist das größere Risiko

Trotz der Befürchtungen argumentieren die Wissenschaftler, dass das eigentliche Risiko nicht in der KI selbst liegt, sondern in der Ausrüstung zur Herstellung neuen genetischen Materials, das für die Entwicklung von Biowaffen benötigt wird.

"Da kein rechnerisch entworfenes Protein in der realen Welt Schaden anrichten kann, wenn es nicht physisch hergestellt wird, stellt die Herstellung synthetischer DNA einen wichtigen Kontrollpunkt für die Biosicherheit im Bereich des rechnerischen Proteindesigns dar", schreiben die Forschenden.

Die Konvention fordert Sicherheitsmaßnahmen für DNA-Produktionsanlagen, um zu verhindern, dass sie mit schädlichen Materialien verwendet werden, sowie Sicherheits- und Zuverlässigkeitsprüfungen für neue KI-Modelle vor ihrer Freigabe.

Die Wissenschaftler plädieren nicht für eine Beschränkung dieser Technologien, sondern für einen freien Zugang, damit die wissenschaftliche Gemeinschaft sie erforschen und dazu beitragen kann. Die Gruppe verpflichtet sich außerdem, die Prinzipien und Verpflichtungen regelmäßig zu überprüfen und neue zu entwickeln.

Die Erklärung wurde im Anschluss an eine Konferenz am 25. Oktober 2023 am Institut für Protein-Design der Universität Washington von Vertretern der Wissenschaft, des Privatsektors und staatlicher Organisationen verfasst.

Eine kürzlich veröffentlichte OpenAI-Studie hat ergeben, dass große Sprachmodelle wie GPT-4 die Entwicklung von Biowaffen nur geringfügig erleichtern, da die benötigten Informationen auch ohne KI relativ leicht im Internet zu finden sind. OpenAI hat ein Frühwarnsystem entwickelt, um potenziellen Missbrauch zu identifizieren.

KI-News ohne Hype – von Menschen kuratiert

Mit dem THE‑DECODER‑Abo liest du werbefrei und wirst Teil unserer Community: Diskutiere im Kommentarsystem, erhalte unseren wöchentlichen KI‑Newsletter, 6× im Jahr den "KI Radar"‑Frontier‑Newsletter mit den neuesten Entwicklungen aus der Spitze der KI‑Forschung, bis zu 25 % Rabatt auf KI Pro‑Events und Zugriff auf das komplette Archiv der letzten zehn Jahre.

Jetzt abonnierenKI-News ohne Hype

Von Menschen kuratiert.

- Mehr als 16 % Rabatt.

- Lesen ohne Ablenkung – keine Google-Werbebanner.

- Zugang zum Kommentarsystem und Austausch mit der Community.

- Wöchentlicher KI-Newsletter.

- 6× jährlich: “KI Radar” – Deep-Dives zu den wichtigsten KI-Themen.

- Bis zu 25 % Rabatt auf KI Pro Online-Events.

- Zugang zum kompletten Archiv der letzten zehn Jahre.

- Die neuesten KI‑Infos von The Decoder – klar und auf den Punkt.