WonderWorld: KI generiert interaktive 3D-Welten in Sekundenschnelle

Forscher der Stanford University und des MIT haben ein KI-System entwickelt, das aus einem einzelnen Bild interaktiv 3D-Szenen generieren kann.

Ein Forscherteam der Stanford University und des MIT hat mit WonderWorld ein KI-System vorgestellt, das aus einem einzigen Bild interaktiv zusammenhängende 3D-Szenen erzeugen kann. Die Technologie ermöglicht es Nutzern, virtuelle Welten schrittweise aufzubauen und zu erkunden, indem sie Inhalte und Layout der generierten Szenen kontrollieren.

Die größte Herausforderung bei der Entwicklung von WonderWorld war laut den Forschern die schnelle Generierung von 3D-Szenen. Bisherige Ansätze benötigen oft Dutzende Minuten bis Stunden, um eine einzelne Szene zu erzeugen. WonderWorld kann dagegen innerhalb von 10 Sekunden auf einer Nvidia A6000-GPU eine neue Szene generieren, was eine laut dem Team eine Echtzeitinteraktion ermöglicht.

Video: Yu, Duan et al.

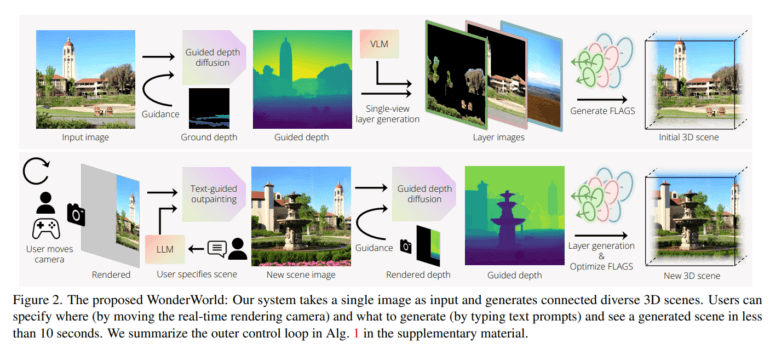

Das System funktioniert wie folgt: Ausgehend von einem Eingabebild wird zunächst eine 3D-Szene generiert. Anschließend läuft eine Schleife ab, in der abwechselnd ein Szenenbild und die entsprechenden FLAGS erzeugt werden. Der Nutzer kann dabei steuern, wo eine neue Szene generiert werden soll, indem er die Kamera bewegt. Zudem kann er über Texteingaben bestimmen, welche Art von Szene generiert werden soll.

Die FLAGS-Darstellung besteht aus drei Ebenen: Vordergrund, Hintergrund und Himmel. Jede Ebene enthält eine Menge von sogenannten Surfels. Ein Surfel ist durch seine 3D-Position, Orientierung, Skalierung, Deckkraft und Farbe definiert. Die Surfels werden mithilfe von geschätzten Tiefen- und Normalenkarten initialisiert und dann optimiert.

Die geführte Tiefendiffusion nutzt ein vortrainiertes Diffusionsmodell für Tiefenkarten. Dabei wird die Tiefenschätzung so angepasst, dass sie mit der Geometrie bereits existierender Szenenteile übereinstimmt. Dies reduziert geometrische Verzerrungen an den Übergängen zwischen Szenen.

Team sieht Potenzial in der Spieleentwicklung

In Experimenten zeigte sich, dass WonderWorld deutlich schneller arbeitet als bisherige Methoden zur 3D-Szenengenerierung, etwa WonderJourney, LucidDreamer und Text2Room. Während andere Ansätze mehrere Minuten pro Szene benötigen, erzeugt WonderWorld eine Szene in weniger als 10 Sekunden. In Nutzerstudien wurden die generierten Szenen zudem als visuell überzeugender bewertet.

Video: Yu, Duan et al.

Video: Yu, Duan et al.

Allerdings weisen die Wissenschaftler auch auf Einschränkungen hin. So können mit WonderWorld nur nach vorne gerichtete Oberflächen erzeugt werden - Nutzer können sich in der Welt also nicht weiter als etwa 45 Grad drehen. Die Welten wirken aktuell wie ein Papierschnitt. Zudem hat das System Schwierigkeiten bei der Darstellung detaillierter Objekte wie Bäumen, was zu "Löchern" oder "schwebenden" Elementen führen kann, wenn sich der Blickwinkel ändert.

Die Forscher sehen Anwendungsmöglichkeiten für Systeme wie WonderWorld in der Spieleentwicklung, wo Designer iterativ 3D-Welten aufbauen möchten. Auch für Virtual Reality und Videospiele könnte das System genutzt werden, um größere und vielfältigere Inhalte zu generieren. Langfristig könnte es Nutzern ermöglichen, frei erkundbare, sich dynamisch entwickelnde virtuelle Welten zu erschaffen.

Mehr Beispiele zum selbst ausprobieren gibt es auf der Projektseite von WonderWorld.

KI-News ohne Hype – von Menschen kuratiert

Mit dem THE‑DECODER‑Abo liest du werbefrei und wirst Teil unserer Community: Diskutiere im Kommentarsystem, erhalte unseren wöchentlichen KI‑Newsletter, 6× im Jahr den "KI Radar"‑Frontier‑Newsletter mit den neuesten Entwicklungen aus der Spitze der KI‑Forschung, bis zu 25 % Rabatt auf KI Pro‑Events und Zugriff auf das komplette Archiv der letzten zehn Jahre.

Jetzt abonnierenKI-News ohne Hype

Von Menschen kuratiert.

- Mehr als 16 % Rabatt.

- Lesen ohne Ablenkung – keine Google-Werbebanner.

- Zugang zum Kommentarsystem und Austausch mit der Community.

- Wöchentlicher KI-Newsletter.

- 6× jährlich: “KI Radar” – Deep-Dives zu den wichtigsten KI-Themen.

- Bis zu 25 % Rabatt auf KI Pro Online-Events.

- Zugang zum kompletten Archiv der letzten zehn Jahre.

- Die neuesten KI‑Infos von The Decoder – klar und auf den Punkt.