Yann LeCun will den AGI-Begriff abschaffen und durch "Superhuman Adaptable Intelligence" ersetzen

Ein neues Paper von Forschern der Columbia University und NYU, darunter Yann LeCun, argumentiert, dass AGI ein fehlerhaftes Konzept ist. Menschliche Intelligenz sei nicht allgemein, sondern spezialisiert. Stattdessen schlagen sie den Begriff der "Superhuman Adaptable Intelligence" vor.

Der Begriff AGI ist laut einem neuen Paper von Forschern der Columbia University, NYU und des Start-ups Distyl mehr Hindernis als Orientierung in der KI-Debatte. Mitautor ist der prominente KI-Forscher Yann LeCun.

Die zentrale These: Menschliche Intelligenz ist nicht allgemein, sondern durch Evolution hochspezialisiert. Wir nehmen unsere eigenen blinden Flecken schlicht nicht wahr. Die Forscher illustrieren das am Beispiel von Schach-Weltmeister Magnus Carlsen: Gemessen an Computern sei er objektiv schlecht im Schach. Unsere Wahrnehmung seiner Fähigkeiten spiegle lediglich die Grenzen menschlicher Leistungsfähigkeit wider.

Bestehende AGI-Definitionen scheitern an ihren eigenen Ansprüchen

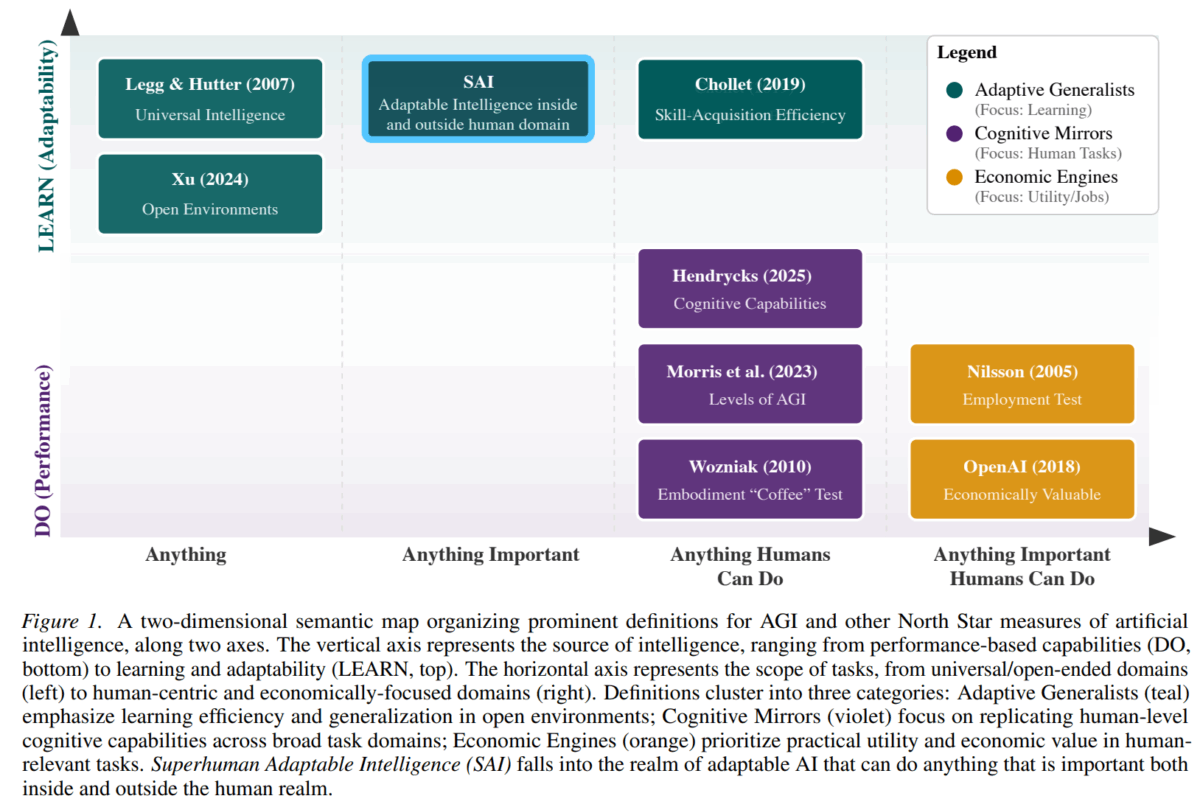

Das Paper analysiert gängige AGI-Definitionen systematisch und kommt zum Schluss, dass keine die eigenen Kriterien erfüllt. Definitionen, die "echte" Allgemeinheit beanspruchen, scheitern am No-Free-Lunch-Theorem: Kein einzelner Algorithmus kann bei allen Problemen optimal sein. Definitionen, die sich auf menschliche Fähigkeiten beschränken, seien per Definition nicht allgemein. Andere, etwa von OpenAI oder Demis Hassabis, seien entweder nicht messbar oder intern widersprüchlich.

Zum Vorwurf, ihr Verständnis von AGI würde allgemeine mit universeller Intelligenz verwechseln, betonen sie: Selbst wenn man die theoretische Turing-Vollständigkeit des Gehirns zugestehe, decke es unter realen Einschränkungen wie endlichem Gedächtnis, endlicher Zeit und Aufmerksamkeit nur einen "winzigen Bruchteil" möglicher Probleme ab.

"Die KI, die Proteine faltet, sollte nicht die Wäsche falten"

Statt AGI schlagen die Autoren "Superhuman Adaptable Intelligence" (SAI) vor: eine Intelligenz, die lernen kann, Menschen bei jeder wichtigen Aufgabe zu übertreffen, und die auch Aufgaben außerhalb des menschlichen Bereichs bewältigen kann. Entscheidend sei aber nicht eine Checkliste von Fähigkeiten, sondern die Geschwindigkeit der Anpassung an neue Aufgaben.

Technisch deute SAI auf selbstüberwachtes Lernen und Weltmodelle als vielversprechende Wege hin, nicht auf autoregressive Sprachmodelle. Deren Fehler würden sich mit jeder weiteren Vorhersage vervielfachen und so immer unzuverlässiger werden, so die Forscher. Die aktuelle Monokultur von GPT-artigen Architekturen bremse den Fortschritt.

KI-News ohne Hype – von Menschen kuratiert

Mit dem THE‑DECODER‑Abo liest du werbefrei und wirst Teil unserer Community: Diskutiere im Kommentarsystem, erhalte unseren wöchentlichen KI‑Newsletter, 6× im Jahr den "KI Radar"‑Frontier‑Newsletter mit den neuesten Entwicklungen aus der Spitze der KI‑Forschung, bis zu 25 % Rabatt auf KI Pro‑Events und Zugriff auf das komplette Archiv der letzten zehn Jahre.

Jetzt abonnierenKI-News ohne Hype

Von Menschen kuratiert.

- Mehr als 16 % Rabatt.

- Lesen ohne Ablenkung – keine Google-Werbebanner.

- Zugang zum Kommentarsystem und Austausch mit der Community.

- Wöchentlicher KI-Newsletter.

- 6× jährlich: “KI Radar” – Deep-Dives zu den wichtigsten KI-Themen.

- Bis zu 25 % Rabatt auf KI Pro Online-Events.

- Zugang zum kompletten Archiv der letzten zehn Jahre.

- Die neuesten KI‑Infos von The Decoder – klar und auf den Punkt.