Das Dilemma der KI-Genauigkeit: ChatGPTs Kampf mit der Korrektheit persönlicher Daten

Wer ChatGPT nach einer bestimmten Person fragt, bekommt nicht unbedingt korrekte Informationen über sie zurück. Ein neues Formular zur Datenentfernung soll den Schaden minimieren, wird das Problem aber nicht langfristig lösen.

ChatGPT-Entwickler OpenAI sieht sich zunehmender Kritik ausgesetzt. Der KI-Chatbot neigt wie andere große Sprachmodelle dazu, falsche Informationen über Personen zu generieren.

Damit verstößt es in den Augen der österreichischen Non-Profit-Organisation noyb (None of Your Business) gegen die Datenschutz-Grundverordnung (DSGVO) der Europäischen Union.

Jetzt hat noyb eine Beschwerde gegen OpenAI eingereicht und prangert das Versäumnis des Unternehmens an, diese Probleme zu beheben.

Das Erfinden falscher Informationen ist schon für sich genommen höchst problematisch. Aber wenn es um falsche Informationen über Personen geht, kann das ernsthafte Konsequenzen haben. Es ist klar, dass Unternehmen derzeit nicht in der Lage sind, Chatbots wie ChatGPT mit dem EU-Recht in Einklang zu bringen. Wenn ein System keine genauen und transparenten Ergebnisse liefern kann, darf es nicht zur Erstellung von Personendaten verwendet werden. Die Technologie muss den rechtlichen Anforderungen folgen, nicht umgekehrt.

Maartje de Graaf, Datenschutzanwältin bei noyb

Die Beschwerde von noyb betraf eine anonyme Person des öffentlichen Lebens, die die Berichtigung oder Löschung unrichtiger personenbezogener Daten beantragt hatte, die von ChatGPT generiert worden waren. OpenAI lehnte diesen Antrag jedoch ab.

Das Unternehmen argumentierte, dass eine Korrektur der Daten nicht möglich sei, ohne die Fähigkeit von ChatGPT zu beeinträchtigen, alle Informationen über diese Person zu filtern.

Es sei zwar möglich, Anfragen zu blockieren, die den Namen enthielten, dies sei jedoch keine dauerhafte Lösung.

Darüber hinaus reagierte OpenAI nicht angemessen auf den Antrag des Beschwerdeführers auf Zugang zu seinen personenbezogenen Daten, ein Recht, das Nutzern gemäß der Datenschutz-Grundverordnung gewährt werden sollte.

DSGVO-Formular für Datenlöschung eingerichtet

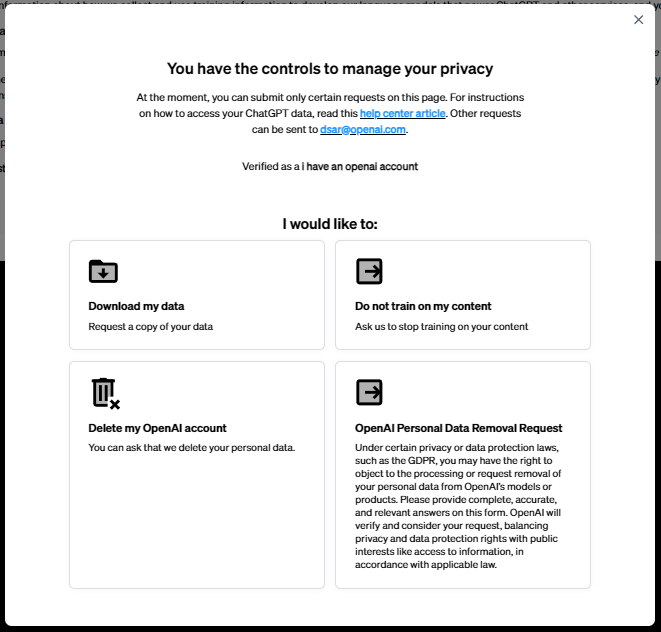

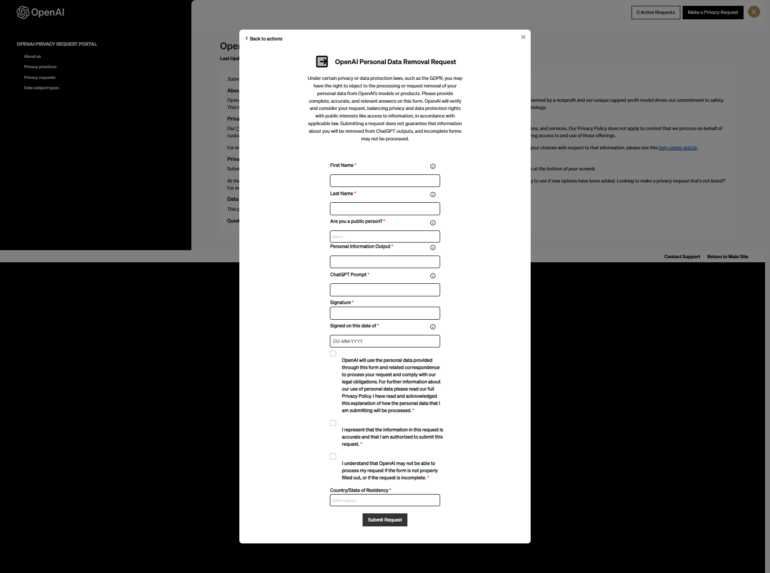

Möglicherweise als Reaktion auf die wachsenden Bedenken hat OpenAI kürzlich ein Formular zur Löschung personenbezogener Daten auf seiner Website eingeführt.

Einzelpersonen können der Verarbeitung widersprechen oder verlangen, dass ihre personenbezogenen Daten aus den Modellen oder Produkten von OpenAI entfernt werden, angeblich in Übereinstimmung mit Datenschutzgesetzen wie der DSGVO. OpenAI betont jedoch auch:

OpenAI prüft und berücksichtigt Ihre Anfrage unter Abwägung der Rechte auf Schutz der Privatsphäre und des Datenschutzes mit den öffentlichen Interessen, wie dem Zugang zu Informationen, in Übereinstimmung mit dem geltenden Recht. Das Einreichen einer Anfrage garantiert nicht, dass Informationen über Sie aus den ChatGPT-Ausgaben entfernt werden, und unvollständige Formulare werden möglicherweise nicht bearbeitet.

OpenAI Personal Data Removal Request (maschinell übersetzt)

In der Vergangenheit war OpenAI immer wieder in Konflikt mit Datenschutzbehörden geraten, teilweise mit drastischen Folgen. Italien schaltete den Chatbot im Zuge dessen zwischenzeitlich ab, doch auch in Frankreich, Irland und Deutschland haben Regulatoren ein Auge auf das US-Unternehmen.

So unbefriedigend die Reaktion von OpenAI auf die Bitte um Löschung oder Korrektur persönlicher Daten auch ist, technisch ist sie leider nachvollziehbar. Ein einmal trainiertes Sprachmodell lässt sich nicht modular verändern, sondern nur mit großem Aufwand verfeinern oder eben Anfragen mit bestimmten Inhalten blockieren. Das ist aber kein skalierbarer Weg für die Zukunft.

Eine Verbesserung könnte das derzeit in der Gerüchteküche kursierende "ChatGPT Search" sein, das - besser als die bereits integrierte Browsing-Funktion - Suchergebnisse bei der Antwort berücksichtigen soll.

Das inhärente Problem von LLMs, bei Unwissenheit Informationen zu halluzinieren, ist damit aber noch lange nicht gelöst.

KI-News ohne Hype – von Menschen kuratiert

Mit dem THE‑DECODER‑Abo liest du werbefrei und wirst Teil unserer Community: Diskutiere im Kommentarsystem, erhalte unseren wöchentlichen KI‑Newsletter, 6× im Jahr den „KI Radar"‑Frontier‑Newsletter mit den neuesten Entwicklungen aus der Spitze der KI‑Forschung, bis zu 25 % Rabatt auf KI Pro‑Events und Zugriff auf das komplette Archiv der letzten zehn Jahre.

Jetzt abonnierenKI-News ohne Hype

Von Menschen kuratiert.

- Mehr als 20 Prozent Launch-Rabatt.

- Lesen ohne Ablenkung – keine Google-Werbebanner.

- Zugang zum Kommentarsystem und Austausch mit der Community.

- Wöchentlicher KI-Newsletter.

- 6× jährlich: „KI Radar“ – Deep-Dives zu den wichtigsten KI-Themen.

- Bis zu 25 % Rabatt auf KI Pro Online-Events.

- Zugang zum kompletten Archiv der letzten zehn Jahre.

- Die neuesten KI‑Infos von The Decoder – klar und auf den Punkt.