KI soll potenzielle Kriminelle an Gesichtszügen erkennen

Eine neue KI soll Verbrecher an ihrem Gesicht erkennen. Kann das funktionieren?

Forscher der amerikanischen Privat-Universität Harrisburg stellen in einem Artikel eine neue Künstliche Intelligenz vor: Sie soll angeblich mit einer Genauigkeit von 80 Prozent Kriminelle anhand ihrer Gesichtszüge erkennen – und das bevor sie überhaupt ein Verbrechen begangen haben.

Einzige Vorrausetzung: eine Porträtaufnahme. Mit Vorurteilen bei Geschlecht oder Herkunft soll die KI keine Probleme haben.

In ihrem Artikel loben die Forscher, darunter Professoren der Universität, die eigene Arbeit in höchsten Tönen: Sie zeige, dass KI-Werkzeuge winzige Bildmerkmale identifizieren könnten, die die kriminelle Neigung einer Person mit hoher Wahrscheinlichkeit vorhersagen.

Man suche jetzt strategische Partner, um vorurteilsfreie und von Emotionen unbelastete KI-Werkzeuge für den Einsatz bei der Polizei oder im Militär zu entwickeln, heißt es im Artikel.

Der wiederum wurde kurz nach der Veröffentlichung von der Webseite gelöscht. Dort erscheint jetzt folgende Meldung: "Der Artikel wurde auf Wunsch der beteiligten Fakultät von der Website entfernt. Die Fakultät aktualisiert das Forschungspapier, um den aufgeworfenen Bedenken Rechnung zu tragen", heißt es anstelle des ursprünglichen Beitrags. Dieser soll erneut aktualisiert werden, sobald das Forschungspapier in einem wissenschaftlichen Journal veröffentlicht wurde.

Was an den Behauptungen der Forscher dran ist und wie die KI trainiert wurde, ist ohne das bislang noch nicht veröffentlichte wissenschaftliche Forschungspapier nicht nachvollziehbar. Ein Blick auf vergleichbare KI-Projekte sorgt allerdings für Zweifel an der Wissenschaftlichkeit des Projekts.

Vergleichbare KI-Projekte sind Nonsens

Andere KI-Projekte der gleichen Stoßrichtung zeigen, dass solche Gesichtsanalysen fundamentale Mängel aufweisen: falsche oder nicht zu Ende gedachte Thesen, Fehlschlüsse, unsaubere Daten und unklare Begriffsdefinitionen sorgen für unzulässige Rückschlüsse.

Pseudowissenschaftliche Gesichtsforschung als theoretische Grundlage

Mit dem oben erwähnten Projekt vergleichbare KI-Software setzt auf Varianten der Physiognomik, wie sie der italienische Kriminologe Cesare Lombroso beschrieb. Er hatte in seinem 1880 veröffentlichten Buch "L’uomo delinquente" versucht, Verbrecher anhand äußerer Körpermerkmale zu identifizieren. Seine Ideen fanden im nationalsozialistischen Deutschland Zuspruch, wo sie für medizin-eugenische Programme verwendet wurden. Heute gilt Lombrosos Theorie als pseudowissenschaftlich.

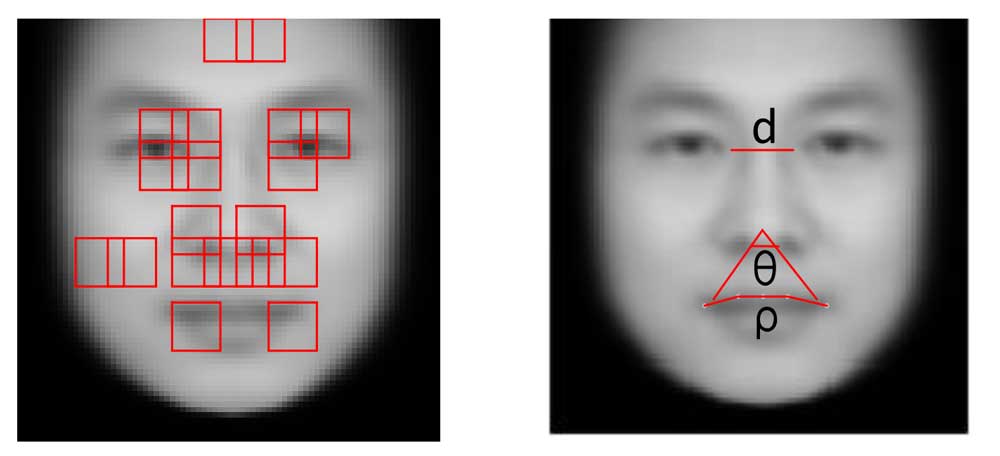

Seine Vorstellung, Verbrecher ließen sich an ihren Gesichtern erkennen, lebt jedoch in aktuellen KI-Projekten weiter: Die amerikanischen KI-Forscher Mahdi Hashemi und Margeret Hall nehmen in ihrer Veröffentlichung vom Januar 2020 direkt Bezug auf Lombrosos Werk von 1880. Sie wollen wie Lombroso anhand visueller Merkmale im Gesicht Rückschlüsse auf das kriminelle Potenzial einer Person ziehen.

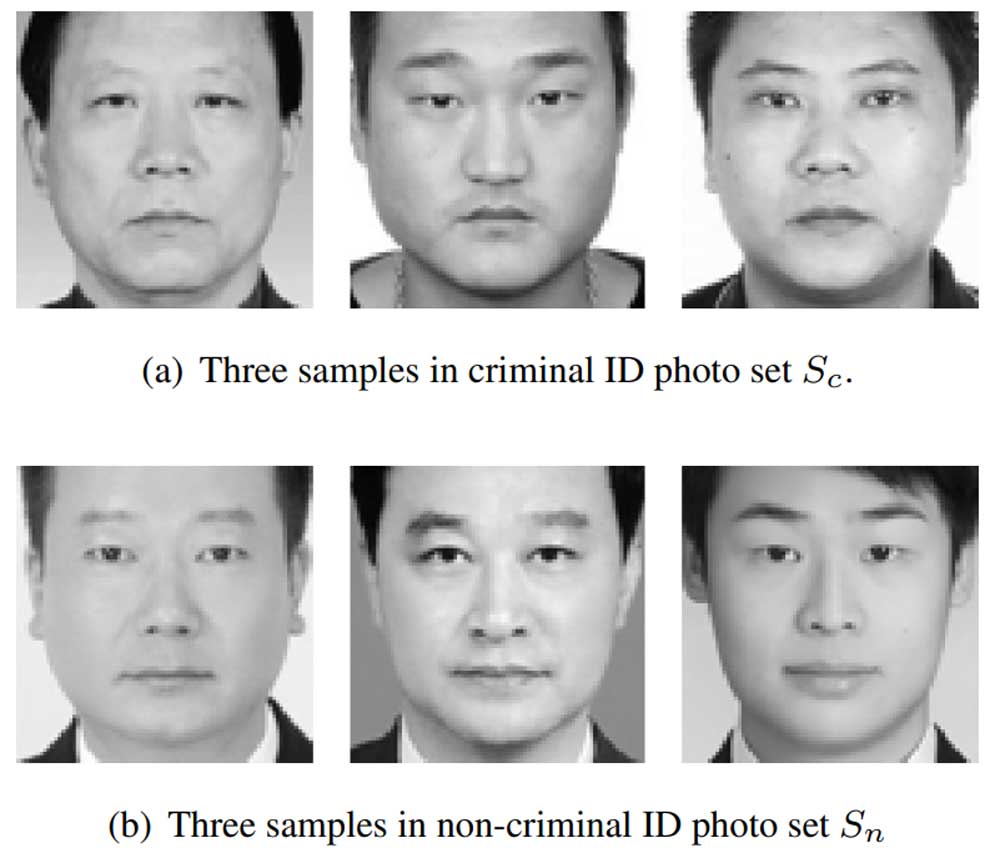

Auch chinesische Forscher wollen anhand von Fotos automatisiert das kriminelle Potenzial einzelner Personen erkennen. In ihrer Veröffentlichung von 2016 berichten Xiaolin Wu und Xi Zhang von einer hohen Genauigkeit bei Tests und sehen diese als empirischen Beweis für Thesen, wie sie Lombroso vertrat.

Unzulässige Schlussfolgerungen

Ein Blick in die Veröffentlichung legt den Verdacht nahe, dass die Wissenschaftler einen logischen Fehlschluss begehen:

Annahme:

Möglicherweise sind Verbrecher anhand von Gesichtsmerkmalen zu erkennen.

Beobachtung:

Eine KI erkennt mit hoher Wahrscheinlichkeit Verbrecher in einer Reihe von Gesichtsfotos.

Schlussfolgerung:

Verbrecher sind anhand ihrer Gesichtszüge identifizierbar.

Diese Schlussfolgerung ist vorschnell und schlecht begründet. Ein Blick auf die Trainingsdaten verdeutlicht, weshalb das so ist: Es gibt eine Reihe weiterer unterschiedlicher Erklärungen, warum eine KI Verbrecher anhand eines Fotos korrekt identifiziert. Sie haben nichts mit den Gesichtszügen zu tun.

KI-Training mit Polizeifotos und Facebook

Für das Training wählten die chinesischen und amerikanischen Forscher jeweils zwei Datensätze: Fotos von verurteilten Verbrechern und Porträts aus öffentlichen Datensätzen oder von Facebook.

Nach dem KI-Training konnten die Systeme mit einer Genauigkeit von 75 bis 97 Prozent Verbrecher auf den Fotos identifizieren. Auf welcher Grundlage die KIs genau urteilen, ist jedoch nicht geklärt.

Der Verdacht liegt nahe, dass es zwischen den Datensätzen Unterschiede gibt, die nichts mit kriminellen Merkmalen in Gesichtszügen zu tun haben, sondern eher mit der Aufnahmesituation.

Im Datensatz der chinesischen Forscher fallen etwa Unterschiede in der Mimik zwischen der oberen (Kriminelle) und unteren Reihe auf. Mimik zählt nicht zu den unveränderlichen Gesichtsmerkmalen, nach denen die KI-Forscher Kriminelle identifizieren wollen.

Die amerikanischen Forscher greifen gar auf Polizeifotos zurück. Die Umstände, unter denen solche Aufnahmen geschossen werden, lassen jedoch eine neutrale Mimik kaum zu. Darauf weisen die Forscher selbst in ihrem Fazit hin. Sie ignorieren aber, dass dieser Fakt die Aussagekraft ihrer Untersuchung gegen Null treibt.

Was ist kriminell?

Abseits der fragwürdigen und rückwärtsgewandten Idee, anhand von Gesichtszügen Rückschlüsse auf das Wesen einer Person ziehen zu wollen, den naiven Schlussfolgerungen und der unsauberen Datenlage beim KI-Training hat die Cyber-Physiognomik ein grundlegendes Definitionsproblem: Was ist kriminell?

Mord, Totschlag oder Diebstahl werden in fast allen Kulturen mit einer kriminellen Handlung gleichgesetzt. Das ist leicht. Aber wie sieht es mit Ehebruch, Homosexualität oder Drogenbesitz aus? Sind Soldaten kriminell, weil sie bereit sind, zu töten?

Die Antwort der Autoren der veröffentlichten Studien lautet: Kriminell ist, wer verhaftet wird. Das ist in jeder Hinsicht zu kurz gedacht und als Ausgangspunkt für die Entwicklung einer KI-Software, die tatsächlich von Behörden für die Strafverfolgung eingesetzt werden soll, schlichtweg kriminell.

Die beschriebenen KI-Experimente unterstreichen, wie wichtig eine interdisziplinäre KI-Forschung ist. Ein kurzes Gespräch mit einem Kriminologen, Sozialwissenschaftler oder auch Psychologen hätte diese wissenschaftlich mangelhaften KI-Projekte wohl verhindert.

Titelbild: Wu et al.

KI-News ohne Hype – von Menschen kuratiert

Mit dem THE‑DECODER‑Abo liest du werbefrei und wirst Teil unserer Community: Diskutiere im Kommentarsystem, erhalte unseren wöchentlichen KI‑Newsletter, 6× im Jahr den „KI Radar"‑Frontier‑Newsletter mit den neuesten Entwicklungen aus der Spitze der KI‑Forschung, bis zu 25 % Rabatt auf KI Pro‑Events und Zugriff auf das komplette Archiv der letzten zehn Jahre.

Jetzt abonnierenKI-News ohne Hype

Von Menschen kuratiert.

- Mehr als 20 Prozent Launch-Rabatt.

- Lesen ohne Ablenkung – keine Google-Werbebanner.

- Zugang zum Kommentarsystem und Austausch mit der Community.

- Wöchentlicher KI-Newsletter.

- 6× jährlich: „KI Radar“ – Deep-Dives zu den wichtigsten KI-Themen.

- Bis zu 25 % Rabatt auf KI Pro Online-Events.

- Zugang zum kompletten Archiv der letzten zehn Jahre.

- Die neuesten KI‑Infos von The Decoder – klar und auf den Punkt.