KI-Radar #2: Warum KI-Produktivität zwischen Benchmark und Bilanz verschwindet

Generative KI spart bei vielen Aufgaben messbar Zeit. Doch zwischen schnelleren Einzelresultaten und echter wirtschaftlicher Wirkung klafft eine Lücke: Kontrollaufwand, schwache Messgrößen und organisatorische Trägheit verhindern oft, dass aus Benchmarkerfolgen Produktivitätsgewinne werden.

6 × im Jahr nimmt die THE DECODER-Redaktion im "KI-Radar" ein grundlegendes KI-Thema besonders gründlich unter die Lupe – als Newsletter und exklusiv hier auf der Seite für THE DECODER-Abonnenten. Ausgabe #2: Die messbaren Auswirkungen von KI auf die Produktivität. Ausgabe #1 behandelt den aktuellen Stand bei agentischer KI.

KI macht schneller. Das zeigen inzwischen so viele Studien, dass es kaum noch jemand ernsthaft bestreitet. Die eigentlich interessante Frage ist eine andere: Warum kommt von dieser Geschwindigkeit so wenig in Unternehmensbilanzen und Volkswirtschaftsdaten an?

Unser Eindruck ist, dass die Debatte an einer entscheidenden Stelle falsch abbiegt. Sie behandelt den Weg von der beschleunigten Einzelaufgabe zur Wertschöpfung als selbstverständlich. Tatsächlich ist genau dieser Weg der schwierige Teil. Dazwischen liegen Prozesse, Anreize, Kontrollaufwand und die schlichte Tatsache, dass viele Unternehmen Produktivität in der Wissensarbeit gar nicht direkt messen.

Die aktuelle Forschungslage lässt zwei Aussagen gleichzeitig zu, ohne dass sie sich widersprechen: Auf der Ebene einzelner Tätigkeiten gibt es überzeugende Hinweise auf teils erhebliche KI-Gewinne. Auf der Ebene ganzer Firmen und erst recht der Gesamtwirtschaft bleiben diese Gewinne gedämpft und schwer messbar.

Die Mikro-Evidenz ist stärker als viele annehmen

Die Debatte über gesamtwirtschaftliche Produktivitätsdaten greift zu kurz. Denn auf der Ebene einzelner Tätigkeiten liefern die bekanntesten Studien klare Belege für messbare Leistungsgewinne.

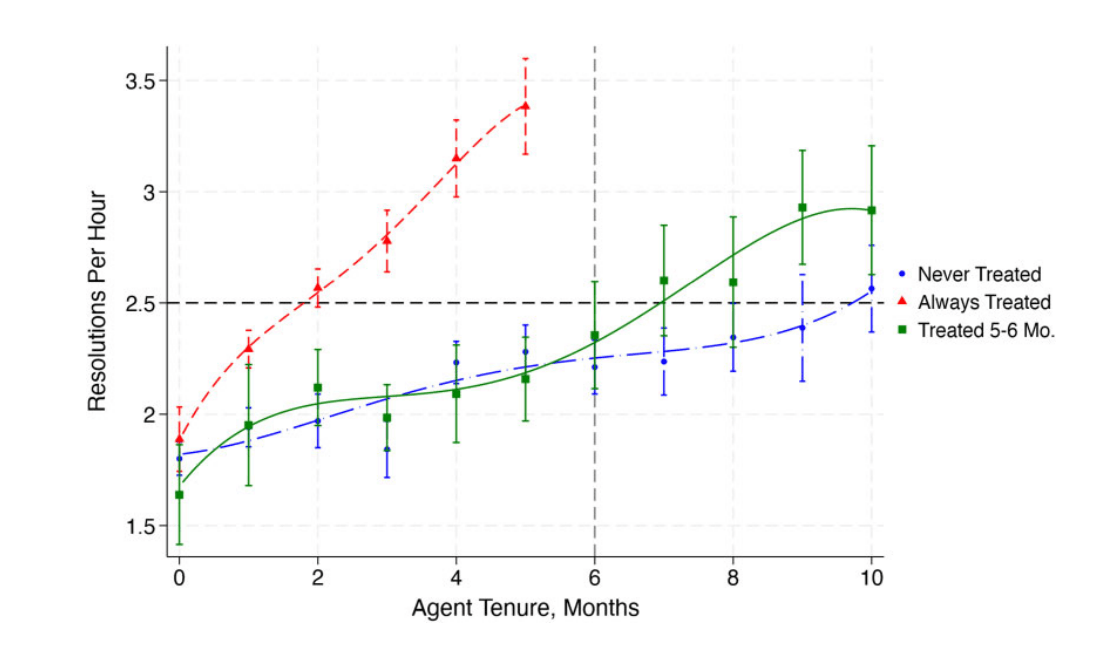

Im Kundenservice stieg laut einer im Quarterly Journal of Economics veröffentlichten Studie die Zahl gelöster Probleme pro Stunde nach Einführung eines generativen KI-Assistenten um rund 14 bis 15 Prozent. Besonders stark profitierten weniger erfahrene Beschäftigte. Noy und Zhang fanden für professionelle Schreibaufgaben, dass ChatGPT schon 2023 die Bearbeitungszeit deutlich senkte und die Qualität im Mittel verbesserte.

Ergebnisse aus der Softwareentwicklung stützen dieses Muster. Eine frühe GitHub-Copilot-Studie ergab bei einer klar definierten Programmieraufgabe eine um 55,8 Prozent schnellere Erledigung. In drei Feldexperimenten bei Microsoft, Accenture und einem Fortune-100-Unternehmen stieg die Zahl erledigter Aufgaben mit KI-Unterstützung im Mittel um rund 26 Prozent. In einem randomisierten Experiment bei Google arbeiteten Entwickler bis zu 20 Prozent schneller.

Diese Studien sind teils älter und wurden mit weniger leistungsfähigen Modellen durchgeführt. Mittlerweile gibt es spezialisierte Coding-Werkzeuge wie Claude Code und deutlich stärkere Modelle wie Claude Opus 4.6 oder GPT-5.4-Thinking. Erfahrene Praktiker wie der bekannte KI-Forscher und Softwareentwickler Andrej Karpathy sahen Ende 2025 eine neue Fähigkeitsschwelle der Modelle beim Programmieren. Für viele Anwendungsfälle werde Code zunehmend billig, flüchtig und leicht veränderbar.

Diese Resultate machen eine einfache Annahme sehr unplausibel: dass KI zwar beeindruckend aussehe, aber keine echten Leistungsgewinne liefere.

Gleichzeitig erklärt die methodische Stärke dieser Studien auch ihre Begrenzung. Sie messen, was sich relativ sauber beobachten lässt. Also die Zeit bis zur Fertigstellung, den Output pro Stunde oder die Qualität eines standardisierten Ergebnisses. Je enger die Aufgabe, desto klarer das Ergebnis. Dass ein Assistent einen Kundendienstfall schneller schließt, bedeutet aber noch lange nicht, dass ein ganzes Team oder Unternehmen im gleichen Maße produktiver wird.

Reale Arbeit ist kein Benchmark

Arbeit besteht jedoch selten aus einer einzelnen Aufgabe. Sie besteht aus Ketten von Teilaufgaben, Rückfragen, Wartezeiten, Freigaben und Systembrüchen. Ein KI-Modell kann bei einer eng gefassten Aufgabe beeindrucken und im Alltag dennoch nur begrenzten Nettoeffekt haben, weil der eigentliche Engpass woanders liegt.

Das Microsoft/NBER-Feldexperiment zeigt das eindrücklich. Die Autoren untersuchten 66 Firmen und 7.137 Wissensarbeiter in einem randomisierten Setting. In der zweiten Hälfte des sechsmonatigen Experiments verbrachten die aktiven Nutzer rund zwei Stunden weniger pro Woche mit E-Mail und arbeiteten seltener außerhalb regulärer Stunden. Doch die Autoren fanden keine klaren Hinweise darauf, dass die freigewordene Zeit in andere Aufgaben floss oder sich die inhaltliche Zusammensetzung der Arbeit verschob. Individuelle Entlastung gab es also durchaus, eine umfassende Reorganisation der Arbeit dagegen blieb aus.

Auch die Softwareentwicklung zeigt den Unterschied zwischen Fähigkeit und Prozess. METR hatte 2025 berichtet, dass erfahrene Open-Source-Entwickler mit KI bei vertrauten Aufgaben im Mittel 19 Prozent langsamer wurden.

Im Februar 2026 relativierte METR selbst diese Ergebnisse. Die neuen Rohdaten deuteten eher auf eine Beschleunigung hin, weil die Tools besser geworden seien. Allerdings sei auch diese neue Erkenntnis mit Vorsicht zu genießen. Denn je besser die KI-Werkzeuge werden, desto fester integrieren Entwickler sie in ihren Alltag. Für eine aussagekräftige Studie müsste eine Kontrollgruppe freiwillig auf diese Werkzeuge verzichten. Doch wer stark davon profitiert, wird das kaum tun. Übrig bleiben Entwickler, die KI ohnehin weniger nutzen. Die Kontrollgruppe ist damit keine repräsentative Vergleichsbasis mehr und die Studie verliert ihre Aussagekraft.

Neuere Agenten-Benchmarks zeigen ebenfalls, dass punktuelle Fähigkeit und verlässliche Ausführung in längeren, offenen Arbeitsprozessen noch weit auseinanderliegen. APEX-Agents testet lange, werkzeuggestützte Aufgaben aus Investment Banking, Beratung und Recht. Das beste System löst dort nur 24 Prozent der Aufgaben im ersten Versuch.

FeatureBench misst die vollständige Umsetzung von Funktionen in realen Codebasen. Selbst ein starkes Modell kommt dort nur auf 11 Prozent erfolgreich abgeschlossene Aufgaben.

ResearchGym bewertet vollständige Forschungsabläufe mit objektiver Ausführungsmessung. Der beste getestete Agent verbessert bestehende Vergleichswerte nur in 1 von 15 Durchläufen und erledigt im Mittel 26,5 Prozent der Teilaufgaben.

Anders gesagt: Die meisten Benchmarks zeigen primär, wie gut ein System in einem ausgewählten Testszenario abschneidet. Das gilt auch für Agenten-Benchmarks. Einmal erstellt, nehmen die KI-Unternehmen sie schnell als Ziel ins Auge und lösen sie durch gezieltes Training. Offen bleibt dabei, wie weit sich diese Ergebnisse auf den Alltag übertragen lassen. Dort sind Aufgaben weniger standardisiert, Kontexte wechselhafter und Fehlerfolgen kostspieliger.

Wissensarbeit hat kein Förderband

In der Industrie lässt sich Produktivität relativ gut beobachten, etwa über Stückzahlen, Ausschussquoten oder Durchlaufzeiten. In der Wissensarbeit ist die Lage grundlegend anders.

Ein Analyst, eine Produktmanagerin oder ein Jurist produzieren keine standardisierten Einheiten. Sie treffen Entscheidungen, schaffen Anschlussfähigkeit und reduzieren Risiken. Also genau jene Dinge, die sich in klassischen Produktivitätsmetriken nur unvollkommen abbilden lassen.

Ein vielzitierter Überblick zur Messung von Wissensarbeiter-Produktivität unterstreicht das. Es gibt keine einzelne, allgemein anerkannte Universalmetrik. Unterschiedliche Tätigkeiten verlangen unterschiedliche Kombinationen aus Quantität, Qualität, Relevanz und Wirkung.

Viele Organisationen erfassen zwar eine Fülle von Daten. Etwa die Anzahl verschickter E-Mails, Meeting-Minuten, bearbeitete Tickets oder Antwortzeiten. Diese Maße erfassen aber vor allem Aktivität und Sichtbarkeit. Laut Deloitte ziehen 60 Prozent der befragten Führungskräfte solche Aktivitätsindikatoren als Produktivitätsmaß heran. Gleichzeitig verbringen Beschäftigte im Schnitt 32 Prozent ihrer Zeit mit performativer Arbeit, die Produktivität nur sichtbar macht, aber sie gar nicht steigert.

Wenn ein Unternehmen bisher gar nicht erfasst, wie sich Durchlaufzeit, Fehlerrate oder ökonomischer Beitrag ganzer Prozesse in der Wissensarbeit verändern, kann es den Einfluss von KI kaum belastbar messen. Dann bleiben bestenfalls Anekdoten oder im besseren Fall qualitative Fallforschung.

Dabei sollten Unternehmen beachten, dass das Messproblem in der KI-Nutzung schnell in ein Anreizproblem umschlagen kann. Generative KI erhöht oft zuerst das Sichtbare. Mehr Entwürfe, mehr beantwortete Mails, mehr geschlossene Tickets, mehr erzeugte Codevorschläge. Solche Größen lassen sich leicht zählen und landen deshalb schnell in Dashboards, Pilotberichten und ROI-Folien.

Wie Jan Sauermann aus der Arbeitsökonomik beschreibt, entsteht dann ein bekanntes Verzerrungsproblem. Sobald einzelne beobachtbare Maße in Bewertung oder Anreize eingehen, wird genau auf diese sichtbaren Größen hin optimiert.

Bei KI bedeutet das konkret: Unternehmen werden schnell besser darin, beschleunigten Output zu messen. Besser darin, dessen wirtschaftlichen Nutzen zu erkennen, werden sie dadurch aber noch lange nicht. Gerade weil KI kurzfristig so viele zählbare Ergebnisse produziert, wächst die Gefahr, Produktivität mit Sichtbarkeit zu verwechseln.

Mehr Output heißt nicht mehr Wert

Wer es schafft, Veränderungen im Output quantitativ und qualitativ zu messen, steht direkt vor dem nächsten Missverständnis der KI-Debatte. Viele verwechseln Output mit Outcome. Wenn ein Team mit KI doppelt so viele Entwürfe, Mails oder Codevorschläge produziert, ist das zunächst nur mehr Output. Ob daraus Wert entsteht, hängt davon ab, was dieser Output bewirkt. Mehr Varianten helfen nur, wenn sie zu besseren Entscheidungen führen. Mehr Ticketabschlüsse bringen nur dann Gewinn, wenn die Qualität dabei gleich bleibt.

| Ebene | Was gemessen wird | Was fehlt |

|---|---|---|

| Aufgabe | Zeit, Menge, Qualität eines Einzelergebnisses | Wirkung auf den Gesamtprozess |

| Prozess | Durchlaufzeit, Fehlerquote, Nacharbeit | Ökonomischer Wert des Ergebnisses |

| Unternehmen | Umsatz, Marge, Kundenzufriedenheit | Kausalzuschreibung zur KI |

| Volkswirtschaft | BIP pro Arbeitsstunde | Isolation des KI-Effekts von anderen Faktoren |

Die Umfragedaten der St. Louis Fed machen das deutlich. Beschäftigte, die generative KI nutzen, sparen im Schnitt 5,4 Prozent ihrer Arbeitszeit. Über alle Beschäftigten hinweg entsprach das 1,4 Prozent der Gesamtstunden. Die Autoren leiten daraus ein potenzielles Plus der Produktivität von rund 1,1 Prozent ab. Zugleich betonen sie, dass offen ist, ob und wann sich diese Potenziale in den gemessenen Produktivitätsdaten niederschlagen. Ohne Anpassung von Arbeitsprozessen, Zielen und Verantwortlichkeiten kann die gesparte Zeit im Alltag einfach versickern. Als Puffer, als informelle Pause oder als zusätzliche Kommunikation.

Die schärfste Prüfung liefert die dänische Registerstudie von Anders Humlum und Emilie Vestergaard. Sie verknüpft Nutzungsumfragen mit administrativen Arbeitsmarktdaten und findet zwei Jahre nach Einführung von Chatbots keinerlei Effekte auf Einkommen und erfasste Arbeitsstunden. Effekte von mehr als 2 Prozent schließen die Autoren weitgehend aus. Gleichzeitig beobachten sie durchaus Veränderungen in Aufgaben und beruflicher Mobilität. Der Befund lautet also: KI leistet etwas. Aber lokale Effizienzgewinne springen eben noch lange nicht automatisch auf klassische Arbeitsmarktergebnisse über.

Die europäische Firmenstudie von Aldasoro und Kollegen liefert eine leicht positivere Lesart. KI-Adoption erhöht die Arbeitsproduktivität demnach im Schnitt um vier Prozent, ohne kurzfristigen Beschäftigungsrückgang. Entscheidend ist aber, wo die Effekte auftreten. Sie sind stärker bei mittleren und großen Unternehmen und dort, wo ergänzende Investitionen in Software, Daten und Training bereits vorhanden sind. Auch das spricht gegen die simple Formel "mehr Output gleich mehr Wert".

Modellrechnungen von Penn Wharton, der OECD und auch vom Modellhersteller Anthropic erwarten ebenfalls keine explosionsartigen Effekte. Sie rechnen eher mit zusätzlichen Produktivitätsbeiträgen von einigen Zehnteln bis etwa einem Prozentpunkt pro Jahr, je nach Land und Szenario. Der Grund dafür ist dreifach. Nur ein Teil der Arbeit ist betroffen. Nur ein Teil der Firmen hat KI tief integriert. Und nur ein Teil der Zeitersparnis wird tatsächlich in Wertschöpfung übersetzt.

Die Anreizfalle: Niemand sagt die ganze Wahrheit

Produktivität ist schwer zu messen und sozial heikel zugleich. Wer offenlegt, dass dieselbe Arbeit nun in drei statt in fünf Stunden erledigt werden kann, lädt zusätzliche Aufgaben und eine Neubewertung der eigenen Rolle geradezu ein. Beschäftigte haben also gute Gründe, Zeitgewinne vorsichtig zu kommunizieren.

Führungskräfte und Tool-Anbieter haben den spiegelbildlichen Anreiz. Sie müssen Budgets rechtfertigen und Transformationserzählungen tragen. Unter solchen Bedingungen ist es erwartbar, dass frühe ROI-Berichte positiver klingen als spätere Nüchternheitsphasen.

Workday berichtet zudem, dass Beschäftigte zwar häufig über spürbare Zeiteinsparungen sprechen, Unternehmen diese freigewordene Kapazität aber nicht in bessere Ergebnisse übersetzen.

Es geht dabei gar nicht darum, einer Seite Täuschung zu unterstellen. Entscheidend ist vielmehr der unterschiedliche Blickwinkel. Beschäftigte sehen vor allem lokale Zeiteffekte. Unternehmen können jedoch erst dann einen Nutzen verbuchen, wenn diese Zeit tatsächlich in bessere Ergebnisse fließt.

Genau deshalb ist die KI-Produktivitätsdebatte so anfällig für Über- und Untertreibung zugleich.

Versteckte Kosten fressen die Bruttogewinne

Eine große Schwäche vieler Produktivitätsdebatten ist auch, dass sie Bruttogewinne betrachten und Nettogewinne vernachlässigen. Ein Tool, das fünf Minuten Schreibarbeit spart, aber zehn Minuten Prüfung auslöst, sieht im Prompt-Fenster beeindruckend aus. Den Gesamtprozess verbessert es aber womöglich kaum. Weil generative KI probabilistisch arbeitet, entsteht ein Teil ihres zusätzlichen Arbeitsaufwands erst nach der Antwort. In Verifikation, Nachbearbeitung und Absicherung.

Die BCG-Studie zu "AI Brain Fry" beschreibt auf Basis einer Befragung von 1.488 US-Beschäftigten eine Form kognitiver Erschöpfung, die aus ständiger Aufsicht und Bewertung mehrerer KI-Systeme entsteht. Rund 14 Prozent der KI-Nutzenden berichteten solche Symptome. KI ersetzt also bestehende Arbeitsprozesse teilweise, erzeugt aber gleichzeitig neue Arbeit des Prüfens und Entscheidens.

BetterUp und das Stanford Social Media Lab nennen ein weiteres Phänomen "Workslop". Gemeint sind formal plausible, aber inhaltlich dünne KI-Inhalte, die nachgelagert weiterverarbeitet werden müssen. In ihrer Befragung berichten 40 Prozent der Beschäftigten, im letzten Monat solchen Output erhalten zu haben. Die Bearbeitung koste im Schnitt fast zwei Stunden pro Vorfall. Was als individuelle Effizienz erscheint, taucht im Unternehmen als verschobene Nacharbeitslast wieder auf.

Langfristiger wirken Lern- und Kompetenzkosten. Eine Anthropic-Studie mit 52 Softwareentwicklern zeigt, dass intensive KI-Nutzung beim Erlernen einer neuen Bibliothek zwar minimal schneller machte, im Wissenstest aber zu 17 Prozent schlechteren Ergebnissen führte. Ein Unternehmen kann heute also Arbeit beschleunigen und zugleich das Ausbildungsfundament der nächsten Jahre schwächen. Entscheidend war hier der Nutzungsmodus: Wer KI zur Erklärung verwendete, lernte deutlich besser als jene, die stark delegierten.

Dazu kommt ein metakognitives Problem. Eine Studie in Computers in Human Behavior zeigt, dass ChatGPT bei Denkaufgaben zwar die Leistung verbessert, gleichzeitig aber die Selbsteinschätzung verzerrt. Die Nutzer waren besser, hielten sich aber systematisch für zu kompetent. Ein Werkzeug, das Output beschleunigt und zugleich das Gefühl eigener Kompetenz verstärkt, kann Fehlerrisiken gerade dort erhöhen, wo die subjektive Sicherheit hoch und das tatsächliche Verständnis begrenzt ist.

Und schließlich fallen Betriebs-, Integrations- und Governancekosten an. Was es kostet, ein Modell sicher, revisionsfest, rechtlich verantwortbar und technisch anschlussfähig in eine Organisation einzubetten, taucht in der öffentlichen Produktivitätsdebatte kaum auf. Wer nur die Geschwindigkeit des ersten Entwurfs misst, aber die Vollkosten von Review, Freigabe, Monitoring und Training außer Acht lässt, misst Brutto- statt Nettoproduktivität.

Was stattdessen gemessen werden müsste

Die klassische KI-Frage lautet: "Wie viel schneller wird die Aufgabe?" Die bessere Frage wäre: "Was verändert sich im Prozess, und was davon schafft Wert?"

Ein sinnvolleres Messsystem müsste mindestens fünf Ebenen auseinanderhalten.

- Erstens die Durchlaufzeit ganzer Prozesse statt nur die Bearbeitungszeit einzelner Aufgaben.

- Zweitens: Fehler- und Nacharbeitsquoten statt bloßer Outputmenge.

- Drittens das Qualitätsniveau, also ob Ergebnisse mindestens gleich gut werden.

- Viertens den Kundennutzen, etwa schnellere Antworten, höhere Zufriedenheit oder geringere Eskalationen.

- Und fünftens die wirtschaftliche Wirkung, also Umsatz, Marge, Conversion oder bessere Allokation hochqualifizierter Arbeitszeit.

Mindestens ebenso wichtig ist die Frage, was mit freigewordener Kapazität passiert. Die Studien der St. Louis Fed und des Microsoft/NBER-Feldexperiments zeigen, dass Zeitersparnisse real sein können. Diese Zeit ist aber erst dann im ökonomischen Sinn produktiv, wenn sie in wertschöpfende Arbeit fließt. "Zeit gespart" bleibt ohne diese zweite Stufe eine halbe Produktivitätsmetrik.

Der Wert entsteht jenseits des Benchmarks

Die US-Produktivitätsdaten für 2025 sehen robuster aus, die KI-Nutzung nimmt laut OECD weiter zu, Firmendaten deuten auf reale Produktivitätssteigerungen hin. Aber dieselben Jahre sind geprägt von Messrauschen, Revisionen und der Tatsache, dass persönliche Nutzung schneller wächst als tiefe organisatorische Integration. Laut dem Budget Lab der Yale University sollte man die Daten noch nicht als Beleg für einen KI-Boom lesen.

Das Narrativ "KI spart Zeit" greift also auf allen Ebenen zu kurz. Zeitersparnis ist nur die erste, leicht messbare Stufe. Wert entsteht erst auf der zweiten. Dann nämlich, wenn Prozesse kürzer, Entscheidungen besser, Fehler seltener oder Grenzkosten niedriger werden. Die eigentliche Frage lautet daher, unter welchen organisatorischen Bedingungen aus lokaler Beschleunigung tatsächlich wirtschaftliche Wirksamkeit wird.

Drei Szenarien: Baseline, Beschleunigung, Verlangsamung

Generative KI spart bei einzelnen Aufgaben messbar Zeit. Das belegen zahlreiche Studien. Zwischen dieser Mikroeffizienz und echter wirtschaftlicher Produktivität klafft jedoch eine systematische Lücke. Kontrollaufwand, fehlende Messgrößen für Wissensarbeit, versteckte Kosten und organisatorische Trägheit verhindern, dass Benchmarkerfolge in Unternehmensbilanzen und Volkswirtschaftsdaten ankommen. Die Debatte behandelt den Weg von der beschleunigten Einzelaufgabe zur Wertschöpfung als selbstverständlich. Tatsächlich ist genau dieser Weg der schwierige Teil.

Basisszenario: Die Übersetzungslücke (Baseline)

Bei unveränderter Dynamik werden KI-Werkzeuge in den kommenden zwei bis drei Jahren weiter in Arbeitsabläufe einsickern. Unternehmen werden dabei ihre Prozesse, Messverfahren und Anreizsysteme kaum grundlegend anpassen. Die individuellen Zeitersparnisse bleiben real, versickern aber großteils in Puffern, zusätzlicher Kommunikation und sichtbarkeitsorientierter Scheinproduktivität.

Gesamtwirtschaftliche Produktivitätsgewinne bewegen sich im Bereich weniger Zehntel-Prozentpunkte pro Jahr. Das deckt sich mit den Vorausberechnungen von Penn Wharton, OECD und Anthropic. Die Kluft zwischen begeisterten Pilotberichten und nüchternen Volkswirtschaftsdaten bleibt bestehen. Sie nährt sowohl Übertreibungs- als auch Enttäuschungserzählungen.

Szenario Beschleunigung: Durchbruch durch Prozessumbau und bessere Messung

Ein Beschleunigungsszenario tritt ein, wenn drei Faktoren zusammenkommen. Erstens deutlich zuverlässigere Modelle. Zweitens systematischer Prozessumbau in Unternehmen. Drittens die Entwicklung belastbarer Wertschöpfungskennzahlen für Wissensarbeit. Auslöser wären etwa ein Durchbruch bei eigenständig arbeitenden Programmieragenten, die ganze Entwicklungszyklen abschließen. Die heutigen Erfolgsraten von 11–24 Prozent bei komplexen Aufgaben müssten sich vervielfachen.

Ebenso denkbar wären branchenweite Maßstäbe für KI-gestützte Arbeitsablaufmessung. Die Produktivitätsgewinne auf Unternehmensebene könnten dann spürbar werden, im Bereich von drei bis fünf Prozent jährlich in stark digitalisierten Branchen. Die Kehrseite wäre ein erhöhter Anpassungsdruck auf Beschäftigte. Deren Aufgabenprofile würden sich schneller verändern, als Weiterbildungssysteme reagieren können.

Szenario Verlangsamung: Die Nettofalle

Die Bremsfaktoren sind bereits sichtbar. Dazu zählen wachsende geistige Erschöpfung durch ständige KI-Aufsicht, zunehmende Qualitätsprobleme durch oberflächlich plausible, aber inhaltlich dünne KI-Ergebnisse, schleichender Kompetenzabbau bei Nachwuchskräften und steigende Kosten für Vorschrifteneinhaltung und Absicherung.

Kommt dazu eine Phase stagnierender Modellfähigkeiten oder ein aufsehenerregender Schadensfall, könnte eine breite Ernüchterungswelle einsetzen. Unternehmen würden KI-Ausgaben kürzen oder auf eng eingegrenzte Anwendungsfälle zurückfahren. Die gesamtwirtschaftlichen Produktivitätseffekte blieben dann über Jahre im statistischen Grundrauschen verborgen.

Unser Standpunkt

Wir halten das Basisszenario für mit Abstand am wahrscheinlichsten. Die Forschungslage zeigt ein gleichbleibendes Muster: Die Technik funktioniert auf Aufgabenebene, doch Organisationen verändern sich langsam.

Geschichtliche Vergleiche mit PC, Internet und Cloud-Diensten zeigen, dass zwischen technologischer Verfügbarkeit und messbarer Produktivitätswirkung üblicherweise ein Jahrzehnt liegt.

Der entscheidende Engpass ist nach unserer Einschätzung die organisatorische Aufnahmefähigkeit: Abläufe umbauen, Messverfahren entwickeln, Anreizsysteme anpassen, Verantwortungsstrukturen aufbauen. Solange Unternehmen vorrangig Tätigkeitskennzahlen statt Wertschöpfungskennzahlen verwenden und Beschäftigte nachvollziehbare Gründe haben, Effizienzgewinne zu verschweigen, bleibt die Produktivitätslücke ein Strukturproblem. Das gilt unabhängig davon, wie leistungsfähig die nächste Modellgeneration wird.

KI-News ohne Hype – von Menschen kuratiert

Mit dem THE‑DECODER‑Abo liest du werbefrei und wirst Teil unserer Community: Diskutiere im Kommentarsystem, erhalte unseren wöchentlichen KI‑Newsletter, 6× im Jahr den „KI Radar"‑Frontier‑Newsletter mit den neuesten Entwicklungen aus der Spitze der KI‑Forschung, bis zu 25 % Rabatt auf KI Pro‑Events und Zugriff auf das komplette Archiv der letzten zehn Jahre.

Jetzt abonnierenKI-News ohne Hype

Von Menschen kuratiert.

- Mehr als 20 Prozent Launch-Rabatt.

- Lesen ohne Ablenkung – keine Google-Werbebanner.

- Zugang zum Kommentarsystem und Austausch mit der Community.

- Wöchentlicher KI-Newsletter.

- 6× jährlich: „KI Radar“ – Deep-Dives zu den wichtigsten KI-Themen.

- Bis zu 25 % Rabatt auf KI Pro Online-Events.

- Zugang zum kompletten Archiv der letzten zehn Jahre.

- Die neuesten KI‑Infos von The Decoder – klar und auf den Punkt.