Das israelische Startup D-ID will mit Deepfakes Überwachungsvideos anonymisieren. Zielgruppe der Technologie sind Unternehmen, die Videos fürs Marketing auswerten wollen.

Stellt euch vor, es existiert ein Video von euch, in dem eure Handlungen und Merkmale wie Alter, Geschlecht und Größe originalgetreu eingefangen sind - aber in dem ihr trotzdem nicht mehr als ihr selbst identifiziert werden könnt, weil eure Augenpartie verändert ist, ihr eine andere Hautfarbe oder einen dicken Schnurrbart im Gesicht habt.

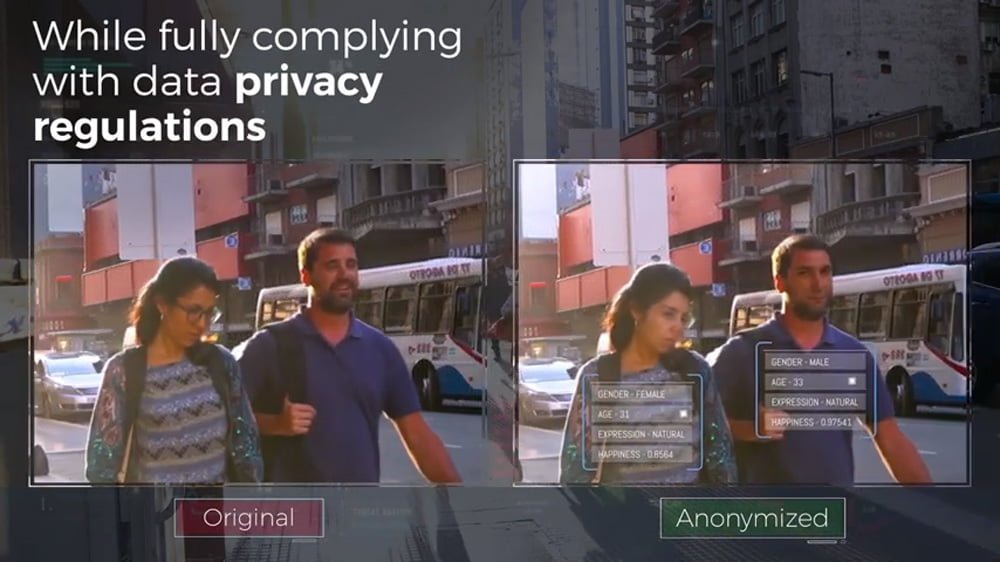

Genau diese Form der Video-Anonymisierung ermöglicht das israelische Startup D-ID automatisiert mit Deepfakes: Gefilmte Personen werden mit der KI-gestützten Pixelumrechnungstechnologie in nicht identifizierbare Deepfake-Avatare ihrer selbst verwandelt. "Smarte Anonymisierung" nennt D-ID diesen Prozess.

Was ist das Anwendungsszenario? Laut D-ID verwenden Unternehmen die Technologie, die Menschen beispielsweise für Marketing-Auswertungen filmen wollen, ohne zuvor eine Einwilligung der gefilmten Person abzuholen.

Denn wenn die Person ohnehin nicht mehr identifizierbar ist - was sollte sie dagegen haben, gefilmt zu werden?

Datenschutzgrundverordnung vs. D-ID

Das jedenfalls ist D-IDs Standpunkt. Die Technologie wird laut D-ID in Europa schon bei großen Händlern sowie Sicherheits- und Autofirmen eingesetzt.

Laut D-ID werden bei den Aufnahmen samt der anschließenden Umwandlung keine sensiblen Daten analysiert, beschrieben oder gespeichert. Entsprechend läge kein Verstoß gegen Datenschutzgesetze vor.

Datenschutz-Experten (via MIT) hingegen gehen davon aus, dass allein die Aufnahme des Gesichts schon ein Verstoß gegen den Datenschutz ist.

Außerdem könnten die Deepfake-Avatare womöglich auf die ursprünglich gefilmte Person rückverfolgt werden. Denn die Videos enthalten weitere Informationen wie Ort oder Uhrzeit, die mit anderen verfügbaren Daten wie Kreditkartenabrechnungen oder Social-Media-Profilen abgeglichen werden könnten. Sie wären somit nicht vollständig anonym - und würden daher eine Verletzung der europäischen Datenschutzgrundverordnung darstellen.

D-ID hat noch ein zweites Anwendungsszenario für Deepfakes im Kontext der Privatsphäre, das dem oben beschriebenen Szenario diametral entgegengesetzt ist: Minimale Pixelverschiebungen im Gesicht einer gefilmten Person sollen dafür sorgen, dass die Person von anderen Menschen wie gewohnt erkannt wird - aber für eine Maschine nicht mehr identifzierbar ist.

Quelle: Technology Review