EfficientViT soll autonomes Fahren & medizinische Bildgebung verbessern

EfficientViT bringt effiziente Computer-Vision-Funktionen für hochauflösende Kameras und könnte zu genaueren Ergebnissen beim autonomen Fahren oder in der Medizin führen.

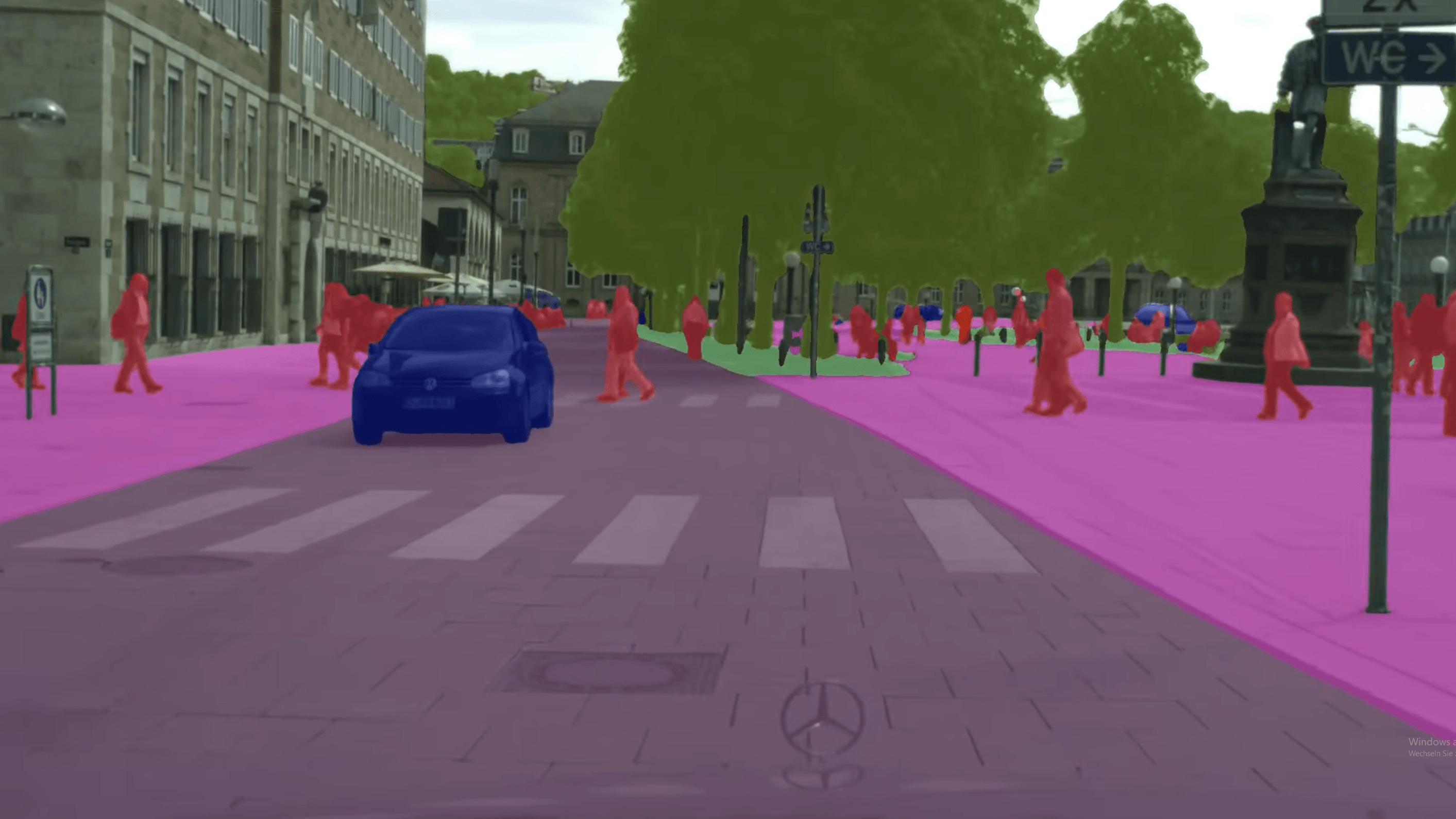

Forschende des MIT haben ein neues Computer-Vision-Modell vorgestellt, das die semantische Segmentierung von hochauflösenden Bildern wesentlich effizienter durchführen kann als bisherige Modelle. Bei der semantischen Segmentierung werden alle Pixel eines Bildes markiert und kategorisiert. So können etwa autonome Fahrzeuge Objekte wie andere Autos, Fußgänger:innen und Umgebung genau erkennen oder medizinische KI-Systeme Tumorgewebe.

EfficientViT reduziert Rechenkomplexität von Vision Transformern

Das neue Modell namens EfficientViT basiert auf dem Vision Transformer, verändert aber den Aufmerksamkeitsmechanismus des Modells. Denn herkömmliche Vision Transformer leiden unter dem gleichen Nachteil wie klassische Transformer für die Sprachverarbeitung: Die Rechenkomplexität des Aufmerksamkeitsmechanismus steigt quadratisch an, was die Verarbeitung hochauflösender Bilder extrem rechenintensiv und damit eine Echtzeitverarbeitung auf aktuellen Edge-Geräten unmöglich macht.

Das Modell der Forschenden, EfficientViT, vereinfacht den Prozess der Erstellung sogenannter "attention maps", also von Repräsentationen, die die Beziehungen zwischen den verschiedenen Teilen des Bildes festhalten. Diese helfen dem Modell, ein "globales rezeptives Feld" zu bilden, was bedeutet, dass es auf alle relevanten Teile des Bildes zugreifen kann.

EfficientViT verwendet eine lineare Funktion anstelle der sonst üblichen nicht linearen Ähnlichkeitsfunktion - die Komplexität der Berechnung steigt dadurch nicht mehr quadratisch, sondern linear.

Team gleicht Genauigkeitsverlust mit weiteren Komponenten aus

Mit der linearen Funktion geht allerdings auch ein Genauigkeitsverlust einher, da die lineare Ähnlichkeitsfunktion nur den globalen Kontext des Bildes erfasst, nicht aber lokale Informationen. Das Team kompensiert diesen Genauigkeitsverlust durch zwei Komponenten, die lokale Merkmale sowie große und kleine Objekte erfassen können.

In Tests erreichte EfficientViT die gleiche oder eine bessere Leistung als weniger effiziente Modelle und verarbeitete hochauflösende Bilder bis zu neunmal schneller.

Diese effizientere Verarbeitung könnte die Segmentierung in Echtzeit für autonome Fahrzeuge, medizinische Bildgebung, VR-Brillen und andere Edge-Anwendungen ermöglichen.

Code und Modell sind auf GitHub verfügbar.

KI-News ohne Hype – von Menschen kuratiert

Mit dem THE‑DECODER‑Abo liest du werbefrei und wirst Teil unserer Community: Diskutiere im Kommentarsystem, erhalte unseren wöchentlichen KI‑Newsletter, 6× im Jahr den "KI Radar"‑Frontier‑Newsletter mit den neuesten Entwicklungen aus der Spitze der KI‑Forschung, bis zu 25 % Rabatt auf KI Pro‑Events und Zugriff auf das komplette Archiv der letzten zehn Jahre.

Jetzt abonnierenKI-News ohne Hype

Von Menschen kuratiert.

- Mehr als 16 % Rabatt.

- Lesen ohne Ablenkung – keine Google-Werbebanner.

- Zugang zum Kommentarsystem und Austausch mit der Community.

- Wöchentlicher KI-Newsletter.

- 6× jährlich: “KI Radar” – Deep-Dives zu den wichtigsten KI-Themen.

- Bis zu 25 % Rabatt auf KI Pro Online-Events.

- Zugang zum kompletten Archiv der letzten zehn Jahre.

- Die neuesten KI‑Infos von The Decoder – klar und auf den Punkt.