Inflection-2: LLM des Deepmind-Gründers soll das zweitbeste der Welt sein

Das neue Sprachmodell des KI-Start-ups Inflection soll direkte Konkurrenten wie Google PaLM-2 und Claude 2 übertreffen und sich nur GPT-4 unterordnen müssen.

Das neue Modell soll deutlich leistungsfähiger sein als sein Vorgänger Inflection-1 und zeigt nach Angaben des Start-ups ein verbessertes Faktenwissen, eine bessere stilistische Kontrolle und eine deutlich verbesserte Argumentation.

Inflection-1 wurde erst im Juli veröffentlicht. Das Modell lag etwa auf dem Niveau von GPT-3.5 und PaLM-540B. Inflection-2 soll jetzt zu GPT-4 aufschließen.

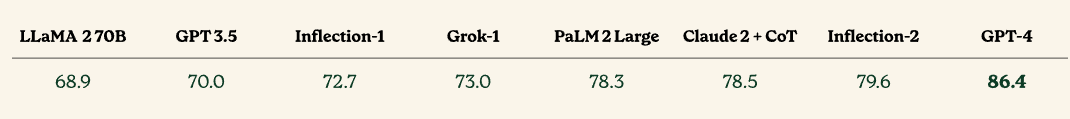

Inflection-2 ist in Benchmarks besser als Claude 2 und PaLM 2 Large

Inflection-2 wurde auf 5.000 NVIDIA H100 GPUs mit einer Mischpräzision von fp8 für etwa 10²⁵ FLOPs trainiert. Damit gehört es laut Inflectioon zur gleichen Trainingsklasse wie Googles Flaggschiffmodell PaLM 2 Large, das jedoch demnächst durch Gemini ersetzt werden soll.

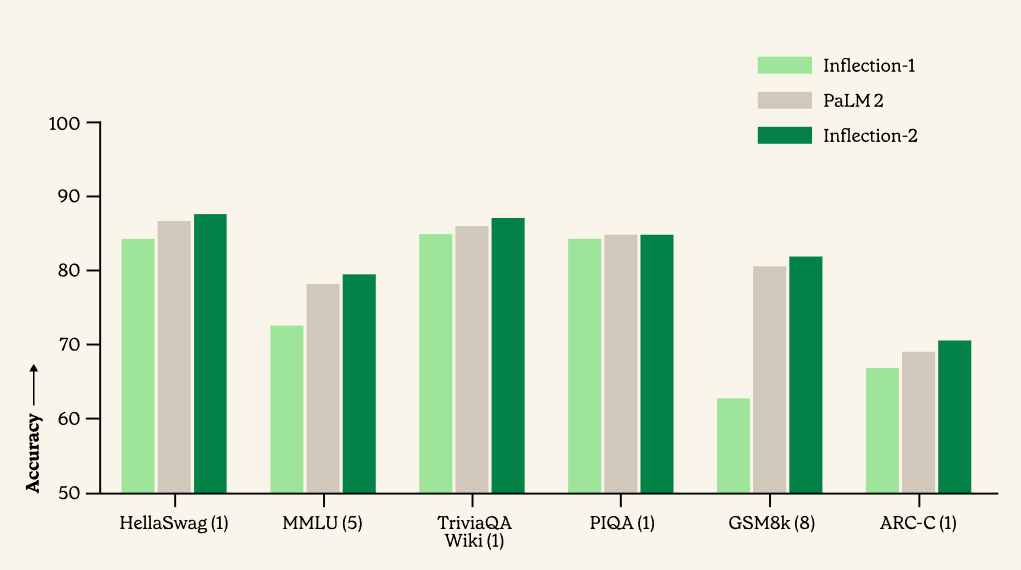

Inflection-2 übertrifft PaLM 2 Large jedoch in den meisten Standard-KI-Leistungstests, einschließlich des bekannten MMLU-Benchmarks, der eine breite Palette von Aufgaben vom Highschool- bis zum professionellen Niveau abdeckt, und anderer Sprachtests wie TriviaQA, HellaSwag und GSM8k.

Im Vergleich zu GPT-4 erreicht Inflection-2 bei HellaSwag 10-shot einen Wert von 89,0 und nähert sich damit GPT-4 mit 95,3 Punkten an. Darüber hinaus soll Inflection-2 Claude 2 beim Chain-of-Thought-Reasoning übertreffen, also bei einem bereits optimierten Prompting-Verfahren.

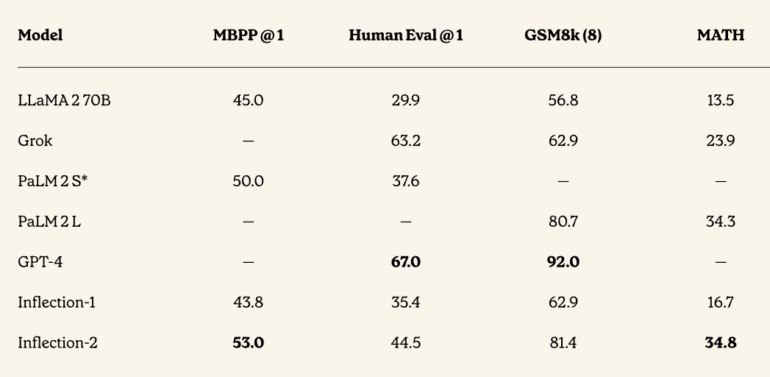

Bei Coding- und Mathe-Aufgaben fällt Inflection-2 deutlich hinter GPT-4 zurück, schneidet aber besser ab als z. B. Metas Llama 2. Inflection-2 sei nicht für das Coding optimiert, schreibt Inflection, daher gebe es hier für zukünftige Modelle noch Raum für Verbesserungen.

Chatbot Pi läuft bald mit Inflection-2

Inflection-2 wird demnächst den Chatbot Pi des Unternehmens antreiben. Die Infrastruktur wird von Nvidia A100 auf H100 GPUs umgestellt, was die Inferenz, also die Verarbeitung der Eingaben durch das KI-Modell, beschleunigen soll. So soll Inflection-2 trotz seiner vielfachen Größe (175 Milliarden Parameter) kostengünstiger und schneller sein als Inflection-1.

Inflection plant bereits, noch größere Modelle auf der vollen Kapazität des 22.000 GPU-Clusters zu trainieren. Das nächste KI-Modell soll circa zehnmal größer werden und in rund einem halben Jahr erscheinen. Pi kann auf Pi.ai/talk getestet werden.

Hinsichtlich der Sicherheit und der Verantwortung eines Modellentwicklers hat sich Inflection freiwillig den Verpflichtungen des Weißen Hauses vom Juli 2023 angeschlossen.

Inflection wird von großen Namen unterstützt

Inflection ist erstmals im März 2022 an die Öffentlichkeit getreten. Das KI-Start-up, das von Linkedin-Gründer Reid Hoffman, Deepmind-Mitbegründer Mustafa Suleyman und dem ehemaligen Deepmind-Forscher Karén Simonyan gegründet wurde, konzentriert sich auf die Generierung und das Verstehen natürlicher Sprache als persönliche Schnittstelle zum Computer.

Im Mai 2022 schloss Inflection AI eine Investitionsrunde über 225 Millionen US-Dollar ab und im Juni 2023 gab das Unternehmen eine weitere Investitionsrunde bekannt, bei der Microsoft, Reid Hoffman, Bill Gates, Eric Schmid und Nvidia insgesamt 1,3 Milliarden US-Dollar investierten. Die Unternehmensbewertung lag zu diesem Zeitpunkt bei vier Milliarden US-Dollar.

Seit der Enthüllung des Start-ups sollen KI-Forscher wie Heinrich Kuttler von Meta AI und Maarten Bosma sowie Rewon Child, ehemals Google Brain, bei Inflection AI eingestiegen sein. Google-Produktmanager Joe Fenton soll das Geschäftsmodell von Inflection AI mitentwickeln.

KI-News ohne Hype – von Menschen kuratiert

Mit dem THE‑DECODER‑Abo liest du werbefrei und wirst Teil unserer Community: Diskutiere im Kommentarsystem, erhalte unseren wöchentlichen KI‑Newsletter, 6× im Jahr den "KI Radar"‑Frontier‑Newsletter mit den neuesten Entwicklungen aus der Spitze der KI‑Forschung, bis zu 25 % Rabatt auf KI Pro‑Events und Zugriff auf das komplette Archiv der letzten zehn Jahre.

Jetzt abonnierenKI-News ohne Hype

Von Menschen kuratiert.

- Mehr als 16 % Rabatt.

- Lesen ohne Ablenkung – keine Google-Werbebanner.

- Zugang zum Kommentarsystem und Austausch mit der Community.

- Wöchentlicher KI-Newsletter.

- 6× jährlich: “KI Radar” – Deep-Dives zu den wichtigsten KI-Themen.

- Bis zu 25 % Rabatt auf KI Pro Online-Events.

- Zugang zum kompletten Archiv der letzten zehn Jahre.

- Die neuesten KI‑Infos von The Decoder – klar und auf den Punkt.