Wie würden Ryu, Ken und Co. aus Street Fighter als reale Menschen aussehen? Den digitalen Pinsel muss man für solche Experimente nicht mehr selbst anlegen: Ein bisschen Training und einige Textbefehle reichen aus, den Rest erledigt die KI. StyleCLIP zeigt das ohne großen Aufwand.

Das Anfang 2021 von OpenAI veröffentliche KI-Modell CLIP kombinierte erstmals Bild- mit Textdaten. Dank dieses multimodalen Trainingsprozesses kann CLIP im Zusammenspiel mit einem GAN (Deepfake Geschichte) anhand von Texteingaben neue Bilder generieren.

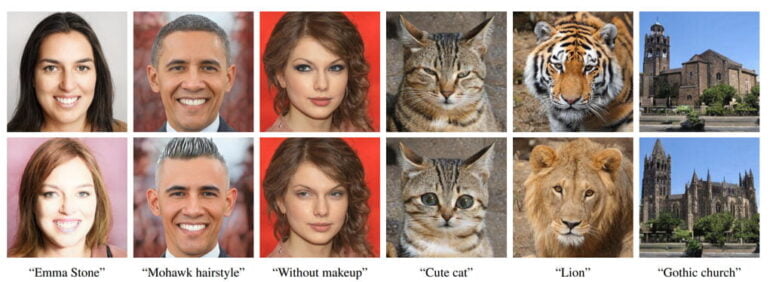

Adobe und Foscher:innen aus Israel stellten im März 2021 StyleCLIP vor, eine Kombination aus CLIP und Nvidias StyleGAN, das per Texteingabe gesteuert wird. Innerhalb einer Domäne, also etwa von Gesicht zu Gesicht, kann so mit einem einfachen Befehl wie "Gesicht → niedliches Gesicht" oder "Gesicht → Roboter" das Aussehen eines Bildes grundlegend verändert werden, ohne dass man selbst den Photoshop-Pinsel anlegen muss. Die Feinjustierung erfolgt über Zahlenwerte und per Versuch und Irrtum.

Mit Style(CLIP) zu menschlichen Videospielhelden

Bei Twitter zeigt der Street Fighter-Fan Sasha Toksubaev die Figuren seines favorisierten Videospiels als Porträts echter Menschen. Den Umwandlungsprozess hat er mit StyleCLIP moderiert.

Interessant ist, dass die in der Realität recht eindeutige Unterscheidung zwischen Frau und Mann im von Künstlicher Intelligenz generierten Bild verschwimmen kann, das zeigen etwa die Mensch-Versionen der bekanntesten Kämpfer Ken und Ryu.

Protagonist himself pic.twitter.com/dfA9vBLgAX

— Siberian_644 (@Siberian_644) August 30, 2021

Ken #2 (vanilla) pic.twitter.com/EyfrnbKxPz

— Siberian_644 (@Siberian_644) August 30, 2021

Probleme hat StyleCLIP mit Accessoires auf dem Kopf oder im Gesicht, zum Beispiel mit einer Mütze oder einer Ninja-Maske - die wird kurzerhand zum 3-Tage-Bart.

Ibuki (i just can't ?) pic.twitter.com/dxl6aiMeWQ

— Siberian_644 (@Siberian_644) August 30, 2021

Mitunter ist die maschinelle Fantasie erfindungsreich, wenn sie das Original nicht genau einordnen kann. Aus der Gesichtsbemalung des japanischen Sumō-Kriegers Honda etwa macht StyleCLIP eine schicke Brille. Bei dem Prozess scheint Honda allerdings auch seine asiatische Herkunft zu verlieren.

Edmond Honda pic.twitter.com/zPEMSDH2YU

— Siberian_644 (@Siberian_644) August 31, 2021

Viele weitere Street Fighter-Menschen findet ihr im Twitter-Account von Toksubaev.

StyleCLIP und Co. selbst verwenden

Die Einrichtung dieser CLIP-GAN-Systeme ist relativ einfach, hier findet ihr eine Anleitung für Bigsleep, eine Kombination aus CLIP und Nvidias BigGAN. StyleCLIP direkt ist als Open Source-Software bei Github verfügbar.

Das kürzlich vorgestellte StyleGAN-Nada übertrumpft StyleCLIP noch: Es kann Bilder und Stile ohne Zusatztraining über Domänen hinweg generieren. Aus den Street Fighter-Porträts oben könnten neben echten Menschen also gezeichnete Street Fighter-Porträts oder Tiergesichter werden - allein per Textbefehl.