KI-Videogenerator Pika Labs stellt Modell 2.0 und neue Funktionen vor

Das KI-Start-up Pika Labs hat die Version 2.0 seines Videogenerators vorgestellt. Die wichtigste Neuerung ist eine Funktion namens "Scene Ingredients", mit der man eigene Bilder in KI-generierte Videos einbauen kann.

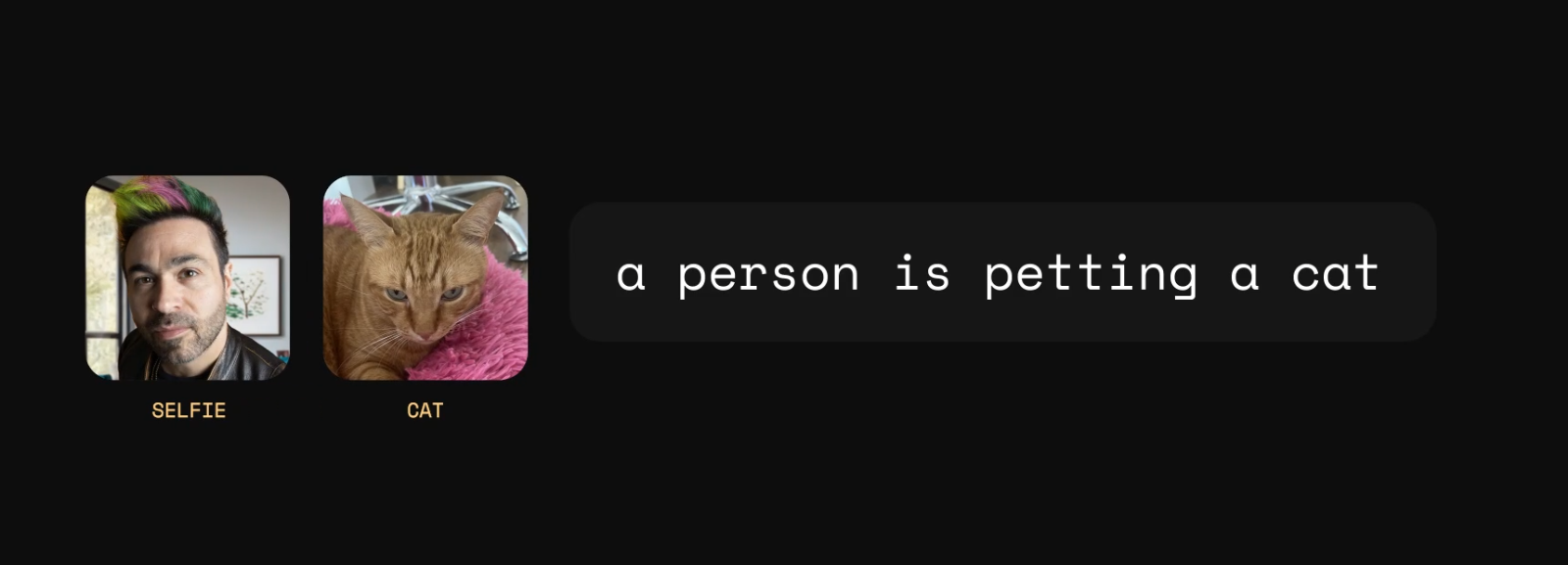

Laut Pika Labs ermöglicht die neue Funktion, eine Szene aus verschiedenen visuellen Elementen zusammenzustellen. Nutzer können Bilder von Personen, Objekten, Kleidung und Umgebungen hochladen. Laut Pika Labs erkennt die KI automatisch die Rolle der hochgeladenen Bilder und fügt sie zu einer zusammenhängenden Szene zusammen.

Ein Beispiel veranschaulicht die Funktionsweise: Lädt ein Benutzer ein Bild von einer Person und einem Bild von einer Katze hoch und ergänzt es mit der Textanweisung "eine Person streichelt eine Katze", erkennt das Modell die gewünschte Interaktion und animiert die Szene entsprechend.

Nutzer können so Bilder von Personen, Objekten, Kleidung und Umgebungen kombinieren und mit weiteren Textanweisungen ergänzen. Erste Nutzer-Beispiele zeigen etwa historische Gemäldefiguren in modernen Szenen oder aus verschiedenen Elementen zusammengesetzte Tanzszenen.

Veröffentlichung in der EU

Das neue Modell 2.0 bietet nach Angaben des Unternehmens eine verbesserte Prompt-Befolgung und visuelle Qualität. Zudem erscheint das Modell in der EU und sei für alle zugänglich.

Pika stichelt hier ein wenig gegen OpenAI, das seinen neuen KI-Videogenerator Sora in vollem Funktionsumfang nur Nutzern des teuren Pro-Abonnements und angeblich aus regulatorischen Gründen vorerst nicht in der EU zur Verfügung stellt.

Video: Pika Labs

Pika Labs wurde von den Stanford-Studierenden Demi Guo und Chenlin Meng gegründet. Zum Team gehören ehemalige KI-Forscher von Google, Meta und Uber. Das Start-up hat bereits 80 Millionen Dollar eingesammelt und wird mit 470 Millionen Dollar bewertet.

Vor Version 2.0 hatte das Unternehmen unter anderem ein generatives Audiomodell für Soundeffekte und vorgefertigte Video-Effekte auf den Markt gebracht. Die neue Version ist über die Website pika.art und Discord verfügbar.

KI-News ohne Hype – von Menschen kuratiert

Mit dem THE‑DECODER‑Abo liest du werbefrei und wirst Teil unserer Community: Diskutiere im Kommentarsystem, erhalte unseren wöchentlichen KI‑Newsletter, 6× im Jahr den "KI Radar"‑Frontier‑Newsletter mit den neuesten Entwicklungen aus der Spitze der KI‑Forschung, bis zu 25 % Rabatt auf KI Pro‑Events und Zugriff auf das komplette Archiv der letzten zehn Jahre.

Jetzt abonnierenKI-News ohne Hype

Von Menschen kuratiert.

- Mehr als 16 % Rabatt.

- Lesen ohne Ablenkung – keine Google-Werbebanner.

- Zugang zum Kommentarsystem und Austausch mit der Community.

- Wöchentlicher KI-Newsletter.

- 6× jährlich: “KI Radar” – Deep-Dives zu den wichtigsten KI-Themen.

- Bis zu 25 % Rabatt auf KI Pro Online-Events.

- Zugang zum kompletten Archiv der letzten zehn Jahre.

- Die neuesten KI‑Infos von The Decoder – klar und auf den Punkt.