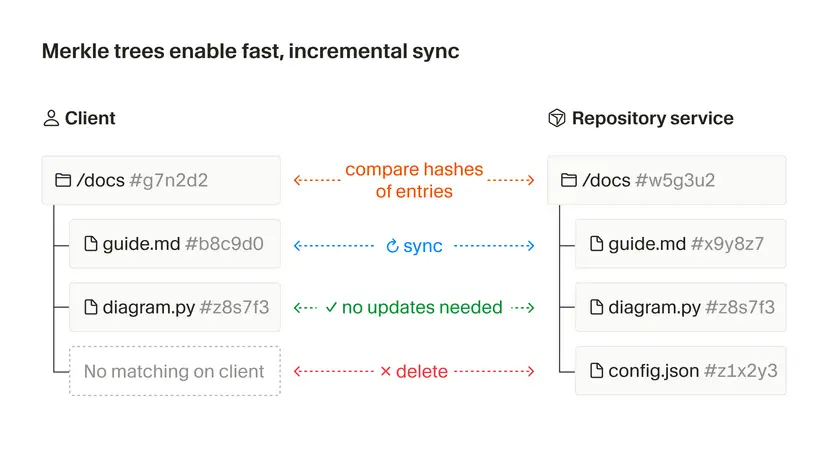

Der KI-Coding-Assistent Cursor soll die Indexierungszeit großer Codebasen von über vier Stunden auf 21 Sekunden verkürzen. Statt bei jedem neuen Nutzer einen Index von Grund auf neu zu erstellen, nutzt Cursor bestehende Indizes von Teammitgliedern wieder. Das funktioniere, weil Kopien derselben Codebasis innerhalb eines Teams im Durchschnitt zu 92 Prozent identisch seien, schreibt das Unternehmen in einem Blogbeitrag.

Die semantische Suche, die durch diese Indizes ermöglicht wird, verbessere laut einer Cursor-Studie die Genauigkeit von KI-Antworten um 12,5 Prozent. Die Technik basiert auf Merkle-Bäumen, einer Datenstruktur mit kryptografischen Hashes. Diese stellt sicher, dass Nutzer nur Code sehen, auf den sie tatsächlich Zugriff haben. Bei durchschnittlichen Projekten sinke die Wartezeit bis zur ersten Suchanfrage von knapp 8 Sekunden auf 525 Millisekunden. Das Start-up hinter Cursor hatte im Oktober 2025 Version 2.0 mit einem eigenen Coding-Modell veröffentlicht und erzielt mittlerweile einen Jahresumsatz von rund 500 Millionen Dollar.