Microsoft demonstriert Quake 2 als KI-generiertes Spiel in Echtzeit

Mit dem KI-Modell WHAMM hat Microsoft ein System entwickelt, das Quake II rein generativ in Echtzeit simuliert. Das Projekt demonstriert, wie weit KI-generiertes Gameplay inzwischen ist – und wo die Grenzen liegen.

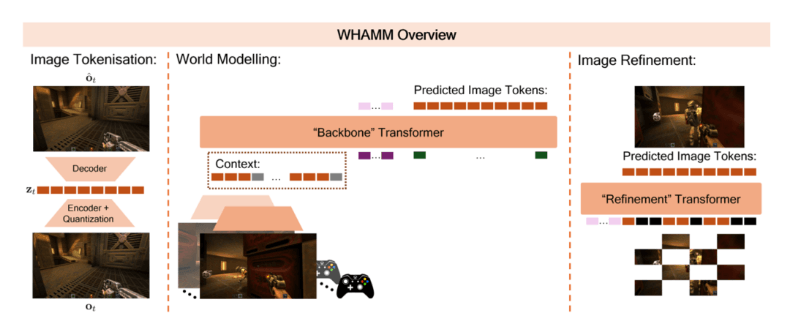

Mit WHAMM (World and Human Action MaskGIT Model) bringt Microsoft ein experimentelles KI-Modell in seine Copilot Labs, das das klassische Spiel Quake II in Echtzeit generieren und bespielbar machen soll. WHAMM steht für "World and Human Action MaskGIT Model" und ist eine Weiterentwicklung des zuvor veröffentlichten WHAM-1.6B-Modells.

Letzteres wurde auf dem Spiel Bleeding Edge trainiert, lieferte aber nur etwa ein Bild pro Sekunde. WHAMM erreicht über zehn Bilder pro Sekunde und ermöglicht damit erstmals eine interaktive Spielerfahrung direkt im generativen Modell. WHAMM und WHAM-1.6B sind beide Teil von "Muse", Microsofts Modellfamilie für generative KI in der Spieleentwicklung.

Echtzeit trotz drastisch reduzierter Datenmenge

Ein zentrales Merkmal von WHAMM ist die Reduktion der benötigten Trainingsdaten. Während WHAM-1.6B auf sieben Jahre Spielverlauf trainiert wurde, genügte für WHAMM eine Woche Spielzeit aus Quake II – gesammelt von professionellen Spieletestern auf einem einzigen Levelabschnitt. Diese gezielte und qualitativ hochwertige Datenerhebung ermöglichte es dem Modell, reale Spielsituationen effizient zu lernen.

Technisch unterscheidet sich WHAMM deutlich vom Vorgänger. Statt auf eine autoregressive Architektur zu setzen, bei der jedes Bildtoken einzeln generiert wird, verwendet WHAMM eine sogenannte MaskGIT-Strategie. Diese erlaubt die parallele Erzeugung aller Bildtokens in wenigen Durchläufen. Dadurch konnte die Generationsgeschwindigkeit massiv erhöht und die Bildauflösung verdoppelt werden. Statt 300 × 180 Pixeln wie beim Vorgängermodell liefert WHAMM 640 × 360 Pixel.

Das Modell besteht aus zwei Teilen: einem „Backbone“-Transformer mit rund 500 Millionen Parametern, der eine erste Bildvorhersage erzeugt, und einem kleineren „Refinement“-Modul mit 250 Millionen Parametern, das diese Vorhersage iterativ verbessert. Als Kontext dienen dabei die neun vorherigen Bild-Aktions-Paare.

Spielen im Modell – mit Einschränkungen

Die generierte Spielwelt, die man hier testen kann, erlaubt grundlegende Interaktionen wie Bewegung, Springen, Schießen oder das Platzieren von Objekten – inklusive persistenter Veränderungen im Level. Auch versteckte Bereiche des Quake-II-Levels können entdeckt werden.

Quake II in der KI-Version. | Video: Microsoft

Allerdings handelt es sich nicht um eine exakte Nachbildung des Originalspiels. WHAMM approximiert die Spielumgebung auf Basis der Trainingsdaten. Gegner erscheinen unscharf, Kämpfe verlaufen oft unplausibel, Gesundheitsanzeigen sind unzuverlässig und Objekte verschwinden, wenn sie länger als 0,9 Sekunden aus dem Blickfeld geraten – die maximale Kontextlänge des Modells limitiert hier. Der spielbare Bereich ist auf einen Levelausschnitt begrenzt. Wird das Levelende erreicht, friert die Simulation ein. Zudem ist die Latenz hoch, zwischen EIngabe und Akton gibt es eine deutlich spürbare Verzögerung.

Microsoft positioniert WHAMM daher ausdrücklich als Forschungsexperiment. Ziel sei es, neue Formen interaktiver Medien zu erproben und Werkzeuge zu entwickeln, mit denen Spielentwickler KI zur Unterstützung kreativer Prozesse nutzen können. Die aktuelle Version zeige dabei sowohl die Potenziale als auch die Grenzen generativer Spielwelten auf.

Die KI-gestützte Spieleentwicklung machte zuletzt bedeutende Fortschritte, wie verschiedene neue Systeme zeigen: GameGen-O kann Open-World-Spielinhalte generieren, während Google und Deepmind mit GameNGen DOOM simulieren und DIAMOND Counter Strike rendern kann.

Allerdings haben diese Systeme noch deutliche Einschränkungen - von begrenztem "Gedächtnis" bis zu unscharfer Darstellung. Generative KI könnte die Spieleindustrie dennoch stark beeinflussen, da sie verschiedene Aspekte wie Code, Grafik und Assets teilautomatisieren kann.

KI-News ohne Hype – von Menschen kuratiert

Mit dem THE‑DECODER‑Abo liest du werbefrei und wirst Teil unserer Community: Diskutiere im Kommentarsystem, erhalte unseren wöchentlichen KI‑Newsletter, 6× im Jahr den "KI Radar"‑Frontier‑Newsletter mit den neuesten Entwicklungen aus der Spitze der KI‑Forschung, bis zu 25 % Rabatt auf KI Pro‑Events und Zugriff auf das komplette Archiv der letzten zehn Jahre.

Jetzt abonnierenKI-News ohne Hype

Von Menschen kuratiert.

- Mehr als 16 % Rabatt.

- Lesen ohne Ablenkung – keine Google-Werbebanner.

- Zugang zum Kommentarsystem und Austausch mit der Community.

- Wöchentlicher KI-Newsletter.

- 6× jährlich: “KI Radar” – Deep-Dives zu den wichtigsten KI-Themen.

- Bis zu 25 % Rabatt auf KI Pro Online-Events.

- Zugang zum kompletten Archiv der letzten zehn Jahre.

- Die neuesten KI‑Infos von The Decoder – klar und auf den Punkt.