Oculus Quest (2): Facebook verbessert Handtracking mit KI

Seit dem ersten Handtracking für die Oculus Quest haben Facebooks KI-Forscher einige Fortschritte erzielt. In einer Forschungsarbeit zeigen sie, wie gut das aktuelle Handtracking funktioniert.

Facebook hat mit Handtracking für die Quest-Brillen gezeigt, dass mit Künstlicher Intelligenz robustes Handtracking mit einer mobilen VR-Brille möglich ist. Gerade für diese mobile VR-Brillen wie Quest 1 (Test) und Quest 2 (Test) ist Handtracking eine technische Herausforderung: Sie haben keine speziellen Tiefenkameras, vergleichsweise wenig Rechenleistung, müssen mit unterschiedlichen Lichtverhältnissen zurechtkommen - und dann hat auch noch jeder Nutzer andere Hände.

Die erste Version des Handtrackings (alle Infos) brachte Facebook im Dezember 2019 auf die Quest. Nach sechs Monaten verließ das Feature am 28. Mai 2020 die Beta-Phase. Doch Facebooks KI-Forscher arbeiteten weiter an der Technik: Eine aktuelle wissenschaftliche Veröffentlichung zeigt, wie sie das Handtracking verbessern.

MEgATrack!

Für ein gutes Handtracking-Erlebnis braucht es eine geringe Latenz, wenig Zittern der virtuellen Hände und ein robustes Tracking auch bei Verdeckungen oder Handinteraktionen.

So viel vorab: Alle Probleme des aktuellen Handtrackings hat Facebook mit dem neuen MEgATrack-Ansatz (Monochrome Egocentric Articulated Hand-Tracking) nicht gelöst. Verschränkte Finger oder Interaktionen mit Objekten führen noch immer zu Trackingausfällen. Doch dank einer neuen Methode, Daten zu sammeln und einer Art Handgedächtnis konnten die Forscher die Qualität des Trackings gegenüber der alten Methode weiter verbessern.

Wie hilft KI beim Handtracking?

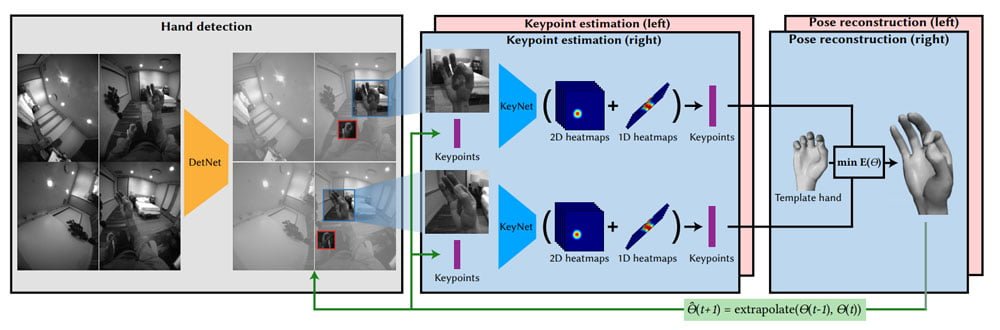

Facebooks Tracking läuft grundsätzlich in vier Stufen ab: Zuerst identifiziert ein neuronales Netz (DetNet) die Hände des Nutzers über die vier monochromen Kamerabilder und umrandet sie mit sogenannten Bounding-Boxen. Anschließend überlagert ein weiteres neuronales Netz (KeyNet) die Handaufnahmen mit einer sogenannten „Keypoint estimation“, eine Art künstliches Skelett, das mit 21 Punkten Finger, Fingerspitzen, Gelenke und Handflächen repräsentiert.

Aus diesen Informationen rekonstruiert Facebook anschließend eine künstliche Hand, die das Keypoint-Modell und damit die echte Hand im virtuellen Raum überlagert. Facebook nutzt dann die letzten zwei Bilder der virtuellen Hand, um DetNet zu unterstützen: Das Bildanalyse-Netz nutzt nur noch Bilder aus einer der vier Kameras und das Tracking-System gleicht seine Bounding-Box-Vorhersage mit der von DetNet ab. Das spart Rechenleistung. Sofern es kein Missverhältnis gibt, übernimmt KeyNet, andernfalls wird DetNet erneut für alle vier Kameraaufnahmen ausgeführt.

Robustes Handtracking in nahezu allen Lichtverhältnissen

Die Vorhersage auf Grundlage der vorherigen Handpositionen ist die wesentliche Innovation des neuen Systems und hat drei große Vorteile: Das Tracking-System braucht weniger Rechenleistung, das Zittern der Keypoint-Vorhersage ist stark reduziert und wenn kurzfristig ein Finger verdeckt ist, kann das Tracking-System dessen Position dennoch korrekt vorhersagen.

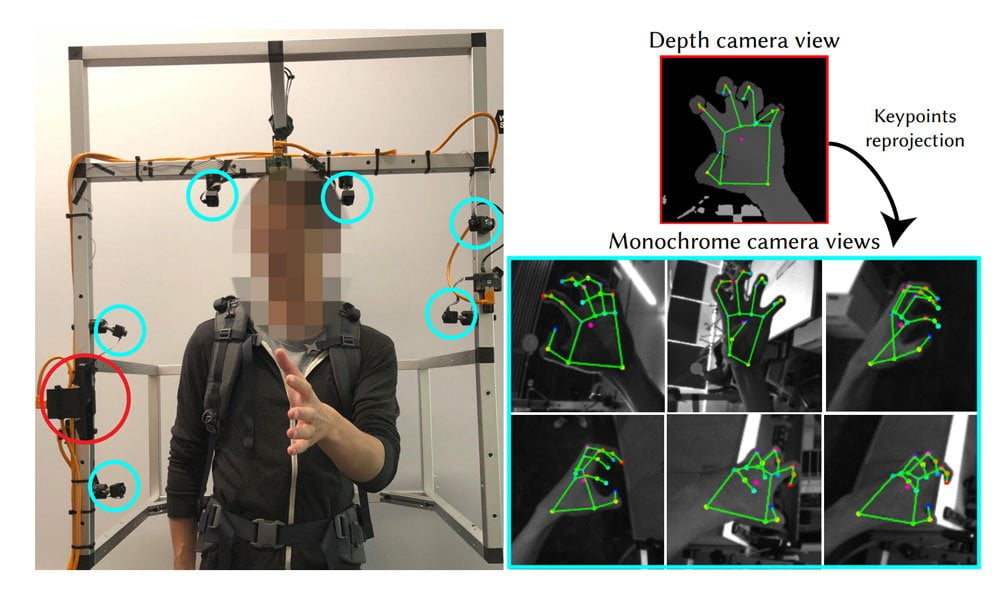

Damit das Tracking auch in unterschiedlichen Lichtverhältnissen funktioniert, hat sich Facebook eine besondere Datensammelmethode für das KI-Training ausgedacht: Die Forscher haben eine Art Kamera-Exoskelett gebaut, das sich Testpersonen auf den Rücken schnallen können. An dem Gestänge sind sechs monochrome Kameras und eine Tiefenkamera angebracht. Anschließend kann sich die Testperson samt ihrer Hände frei bewegen. Das ermöglicht Aufnahmen aus vielen unterschiedlichen Blickwinkeln, mit verschiedenen Hintergründen und unter zahlreichen Lichtverhältnissen. Genau diese Datenvarianz benötigt Facebook für ein verbessertes KI-Training, das dann zu einer robusteren Tracking-Leistung führt.

Facebooks KI-Trackingsystem ist der Benchmark - und hat trotzdem Probleme

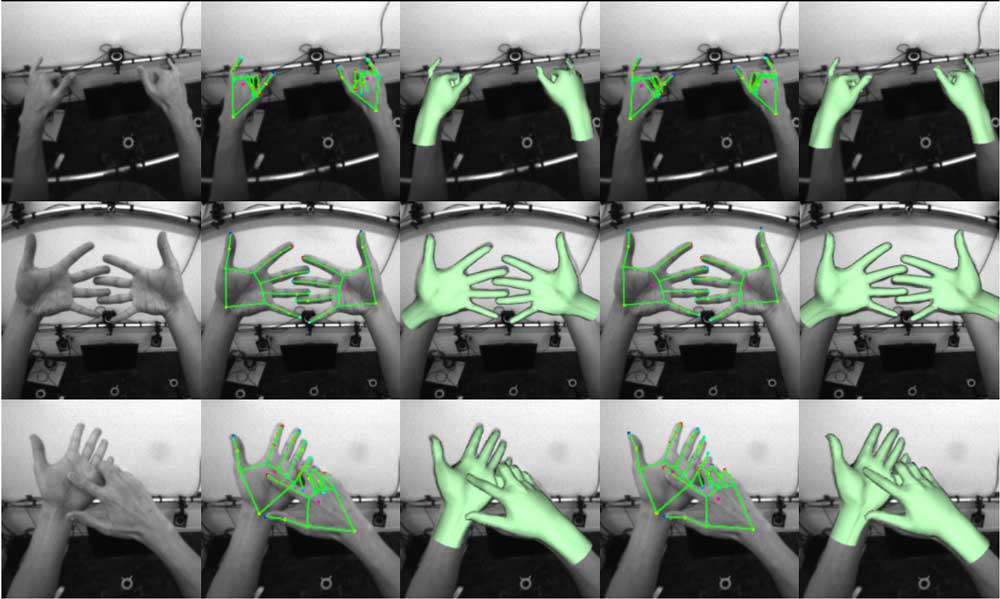

Dank des verbesserten KI-Trainings kann Facebooks neues System schon minimale Handbewegungen genau tracken, etwa das Tippen mit dem Zeigefinger auf die Handfläche der zweiten Hand oder das Aufnehmen eines Objektes mit klar sichtbarer Hand. Wegen der Genauigkeit, dem geringen Leistungsbedarf und der Geschwindigkeit von 30 Hz sei es das beste mobile Handtracking-System auf dem Markt, so die Forscher.

Doch sobald einzelne Finger länger verdeckt sind, zwei Hände in direkten Kontakt kommen oder Objekte die Hand verdecken, versagt Facebooks Tracking. Das Versagen bei Hand-Hand- und Hand-Objekt-Interaktionen zeige die Einschränkungen des Tracking-Designs und die fundamentale Schwierigkeit dieser Aufgaben, so die Forscher.

Eine Lösung müsse beide Probleme angehen: Interaktion zwischen Händen und Hand und Objekt. Beides sei „kritisch für Immersion“ und daher eine wichtige Forschungsrichtung für zukünftige Arbeiten.

Titelbild: Facebook | Via: Facebook

KI-News ohne Hype – von Menschen kuratiert

Mit dem THE‑DECODER‑Abo liest du werbefrei und wirst Teil unserer Community: Diskutiere im Kommentarsystem, erhalte unseren wöchentlichen KI‑Newsletter, 6× im Jahr den "KI Radar"‑Frontier‑Newsletter mit den neuesten Entwicklungen aus der Spitze der KI‑Forschung, bis zu 25 % Rabatt auf KI Pro‑Events und Zugriff auf das komplette Archiv der letzten zehn Jahre.

Jetzt abonnierenKI-News ohne Hype

Von Menschen kuratiert.

- Mehr als 16 % Rabatt.

- Lesen ohne Ablenkung – keine Google-Werbebanner.

- Zugang zum Kommentarsystem und Austausch mit der Community.

- Wöchentlicher KI-Newsletter.

- 6× jährlich: “KI Radar” – Deep-Dives zu den wichtigsten KI-Themen.

- Bis zu 25 % Rabatt auf KI Pro Online-Events.

- Zugang zum kompletten Archiv der letzten zehn Jahre.

- Die neuesten KI‑Infos von The Decoder – klar und auf den Punkt.