Der Open-Source-Stimmkloner Voice Craft zeigt, dass die Entscheidung von OpenAI, den Zugang zur eigenen "Voice Engine" aus ethischen Gründen zu beschränken, keine große Rolle spielt.

Ein Forscherteam der University of Texas at Austin und der Firma Rembrand hat mit "Voice Craft" ein Stimmklonwerkzeug entwickelt, das natürliche Sprache bearbeiten kann, indem es beispielsweise in einen gesprochenen Satz weitere Wörter einfügt oder entfernt und Text in Sprache umwandelt.

Video: Peng et al.

Voice Craft eignet sich nach Angaben der Entwickler sowohl für die Bearbeitung von Sprache als auch für die Sprachsynthese ohne vorher trainiertes Zielstimmmodell ("Zero-Shot TTS"). Für einen Stimmklon reichen drei Sekunden Ausgangsmaterial.

Ausgangsmaterial, die ersten drei Sekunden prompten den Klon:

Stimmklon

In Tests schneidet das Modell deutlich besser ab als vergleichbare Systeme wie FluentSpeech oder VALL-E. Sogar Menschen können die generierten Stimmen oft nicht von echten Aufnahmen unterscheiden.

Originalaussage

Editierte Aussage, "that had expensive gold watches" wurde eingefügt

Voice Craft ist in einer kleinen (330M) und großen (830M) Version samt Gewichten bei Github unter der Apache 2.0 Lizenz verfügbar. Die kleine Version soll mit der größeren Version auf Augenhöhe sein bei deutlich besserer Performance. Zahlreiche Demos kann man sich hier anhören.

Das Voice-Craft-Team betont, dass es an der Entwicklung von Methoden zur Wasserzeichenmarkierung und Erkennung synthetischer Sprache arbeitet, um die Forschung sowohl im Bereich der Sprachsynthese als auch im Bereich der KI-Sicherheit voranzutreiben.

Ethische Bedenken von OpenAI werden von der Open-Source-Bewegung überrollt

Die Forscher sind sich der ethischen Bedenken bewusst, die mit der Veröffentlichung ihres Open-Source-Projekts einhergehen könnten. Insbesondere die Fähigkeit, menschliche Stimmen zu klonen, könnte für kriminelle Aktivitäten missbraucht werden, heißt es in ihrem Paper.

Das Team argumentiert jedoch, dass die Veröffentlichung des Modells der Forschungsgemeinschaft die Chance gibt, es zu untersuchen und zu verstehen, um möglichen Missbrauch zu verhindern.

"Indem wir diese Methoden als Open Source zur Verfügung stellen, können wir die Entwicklung von robusteren Gegenmaßnahmen gegen den Missbrauch von Technologien zum Klonen von Stimmen ankurbeln. Dieser kollaborative Ansatz ermöglicht die schnelle Identifizierung von Schwachstellen und die Erforschung innovativer Strategien zu deren Behebung", heißt es im Paper.

Das steht im krassen Gegensatz zum Anspruch von OpenAI, das kürzlich sein eigenes Sprachmodell "Voice Engine" vorgestellt hat, das ebenfalls mit nur 15 Sekunden Ausgangsmaterial menschliche Stimmen klonen kann. OpenAI macht es aber wegen der Risiken nur ausgewählten Zielgruppen zugänglich.

Aber allein die Existenz von Voice Craft untergräbt die Argumentation von OpenAI. Die Situation erinnert ein wenig an den Wirbel um GPT-2, als OpenAI 2019 mit der Behauptung Schlagzeilen machte, das Modell sei zu gefährlich, um es zu veröffentlichen.

Heute gibt es eine Reihe von Open-Source-Modellen auf dem Markt, die um ein Vielfaches leistungsfähiger sind als GPT-2. Auch wenn die Entscheidung von OpenAI damals richtig gewesen sein mag: Generative Text-KI ist heute überall verfügbar und kann leicht missbraucht werden.

Ähnliches ist mit Bildmodellen passiert, OpenAI sollte das inzwischen wissen. Die Rolle des Gatekeepers für den ethisch korrekten Einsatz von generativer KI, die OpenAI sich selbst zuzuschreiben scheint, kann es offensichtlich nicht ausfüllen.

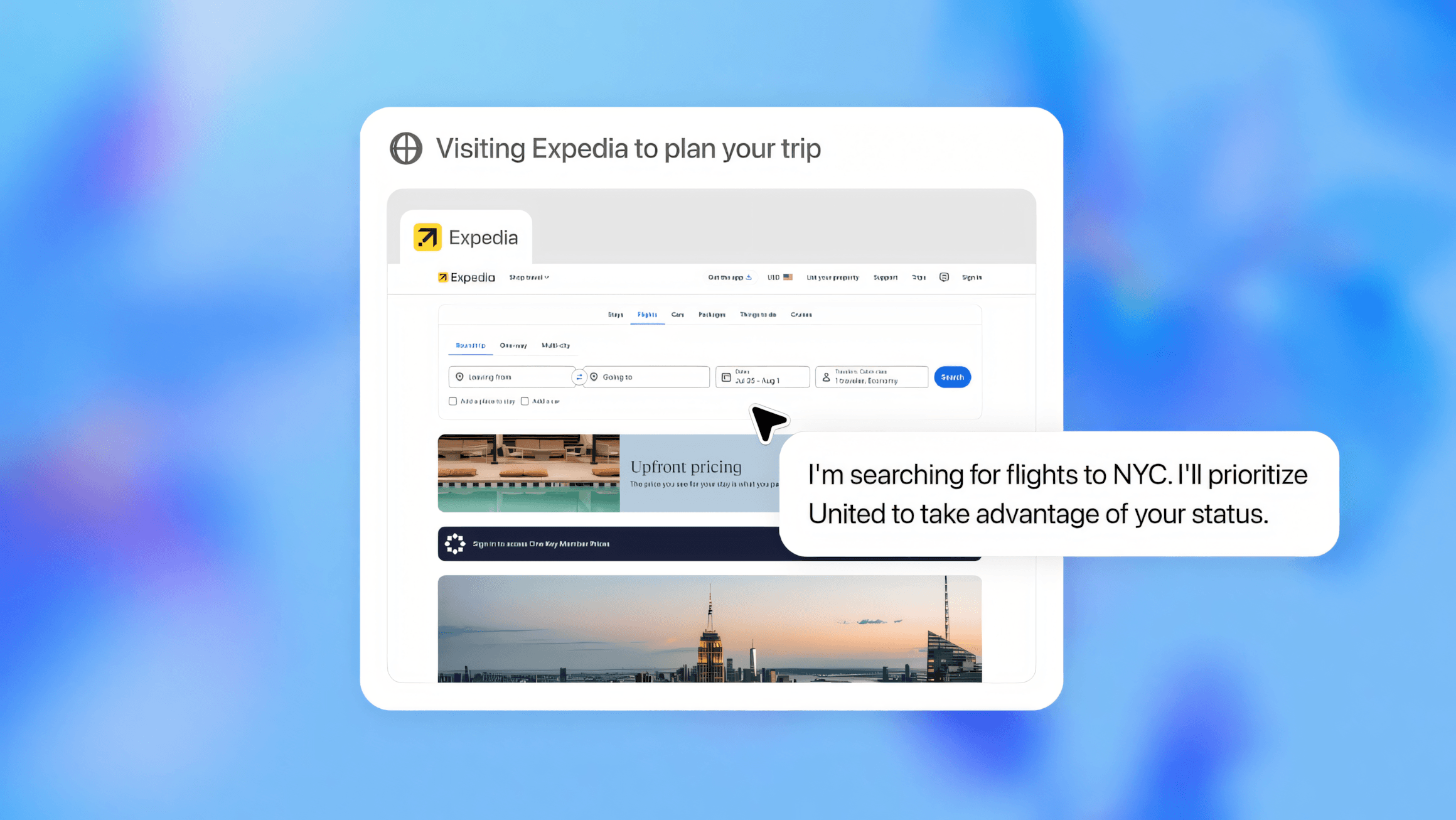

Speziell bei Voice Engine kommt hinzu, dass OpenAI das Modell nach eigenen Angaben zwar bereits 2022 fertiggestellt hatte, es aber erst am 29. März 2024 enthüllte. Voice Craft wurde acht Tage früher, am 21. März, vorgestellt - und ist auch nicht das erste Modell dieser Art.

Aussagen von OpenAI wie: "Es ist wichtig, dass Menschen auf der ganzen Welt verstehen, wohin sich diese Technologie entwickelt, unabhängig davon, ob wir sie letztendlich selbst im großen Stil einsetzen werden oder nicht", wirken abgehoben, wenn zu diesem Zeitpunkt bereits ein vergleichbares Modell frei verfügbar ist.