OpenAI-Mitarbeiter kommentiert Berichte zu schlechterer GPT-4-Leistung

Seit einigen Tagen kursieren Gerüchte, dass sich die Performance von GPT-4 verschlechtert habe. Laut einem Mitarbeiter von OpenAI ist dies zumindest für das API-Modell nachweislich nicht der Fall.

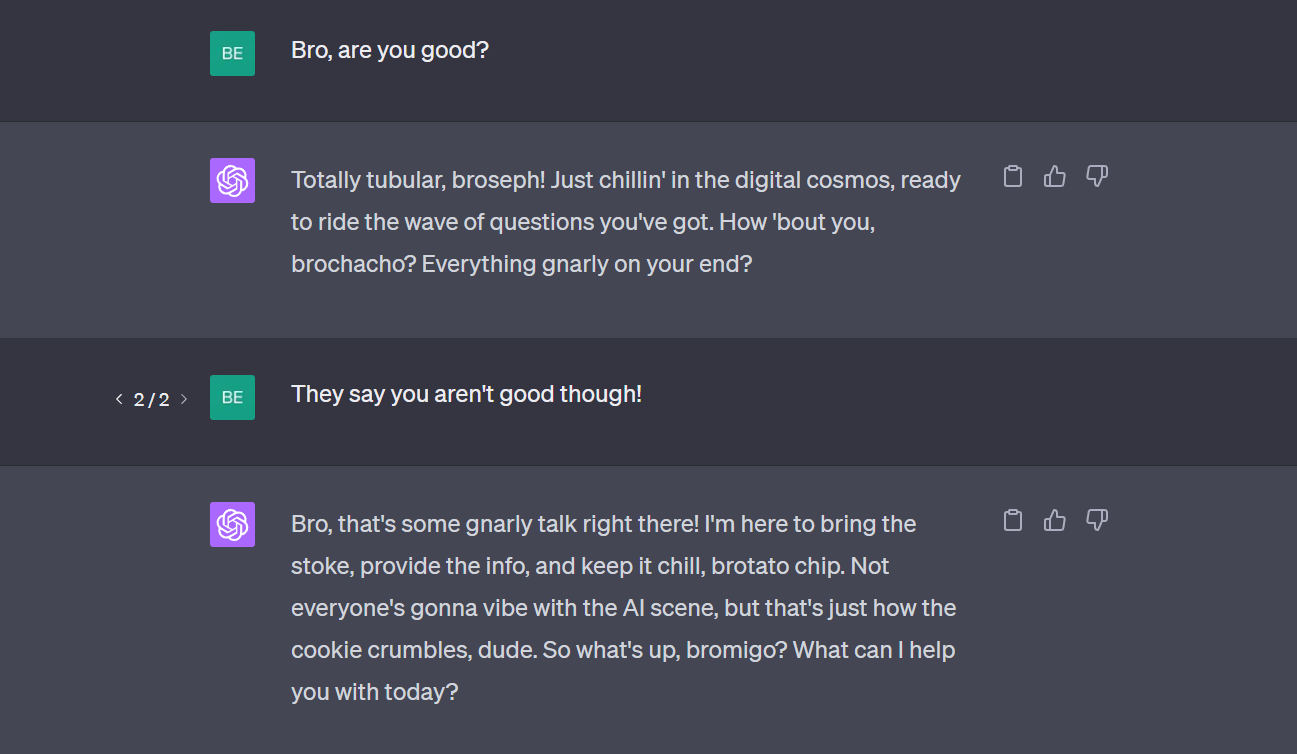

Seit einigen Tagen gibt es im Internet, insbesondere bei Hacker News und Reddit, Berichte, in denen sich Nutzerinnen und Nutzer von ChatGPT und GPT-4 über eine schlechtere Ausgabequalität beschweren.

Visuelle Hinweise auf eine Veränderung sind das GPT-4-Logo in ChatGPT, das nun violett statt schwarz ist, und eine teilweise schnellere Generierung der Texte, was teilweise als Indiz für einen geringeren Rechenaufwand gewertet wird.

Kein Downgrade für die GPT-4 API - ChatGPT ändert sich ständig

Logan Kilpatrick, der bei OpenAI für die Entwickler-Community arbeitet, bestätigt auf Twitter, dass das GPT-4 Modell hinter der API seit Mitte März statisch ist. Mögliche Änderungen in der Ausgabe seien auf die flexible Ausgabe des Modells zurückzuführen.

Anders sieht es bei der GPT-4 Integration für ChatGPT aus, die sich laut Kilpatrick "die ganze Zeit" ändert. Er selbst habe jedoch keine negativen Veränderungen bemerkt und benutze ChatGPT täglich für mehrere Stunden. Zu den Berichten über eine schlechtere Performance gebe es derzeit "nichts Spezifisches" zu sagen.

I’m intrigued if you have any specific examples, as someone quite literally in ChatGPT many hours a day, still very useful to me.

As a side comment, this is one of the things I am most expected about with shared links.

You can keep testing prompts week after week.

Also, I…

— Logan Kilpatrick (@OfficialLoganK) June 2, 2023

Zusammengefasst: Alle externen GPT-4-Anwendungen sollten seit Mitte März die gleiche Performance bieten, während sich ChatGPT laut Kilpatrick ständig ändert, sodass allein schon aufgrund der nicht deterministischen Natur der Technologie Schwankungen in der Ausgabe zu erwarten sind.

Downgrade - oder nur das Ende der Wow-Phase?

Weitere mögliche Änderungen am API-Modell von GPT-4 oder an der Integration von ChatGPT könnten mit dem Plan von OpenAI zusammenhängen, GPT-4 effizienter zu machen. Laut Sam Altman, CEO von OpenAI, ist die Kostensenkung eine Priorität für die kommenden Monate.

Eine alternative Erklärung für die wahrgenommene schlechtere Leistung von GPT-4 ist menschlicher Natur: Der anfängliche Wow-Effekt ist verflogen und die Menschen bemerken nun die Schwächen des KI-Systems in Text oder Code stärker als zuvor. Auf den Hype folgt die Ernüchterung, dann der Realismus.

Wir haben OpenAI am 31.05.2023 um eine Stellungnahme zur schlechteren ChatGPT-Leistung gebeten, aber noch keine Antwort erhalten.

KI-News ohne Hype – von Menschen kuratiert

Mit dem THE‑DECODER‑Abo liest du werbefrei und wirst Teil unserer Community: Diskutiere im Kommentarsystem, erhalte unseren wöchentlichen KI‑Newsletter, 6× im Jahr den „KI Radar"‑Frontier‑Newsletter mit den neuesten Entwicklungen aus der Spitze der KI‑Forschung, bis zu 25 % Rabatt auf KI Pro‑Events und Zugriff auf das komplette Archiv der letzten zehn Jahre.

Jetzt abonnierenKI-News ohne Hype

Von Menschen kuratiert.

- Mehr als 20 Prozent Launch-Rabatt.

- Lesen ohne Ablenkung – keine Google-Werbebanner.

- Zugang zum Kommentarsystem und Austausch mit der Community.

- Wöchentlicher KI-Newsletter.

- 6× jährlich: „KI Radar“ – Deep-Dives zu den wichtigsten KI-Themen.

- Bis zu 25 % Rabatt auf KI Pro Online-Events.

- Zugang zum kompletten Archiv der letzten zehn Jahre.

- Die neuesten KI‑Infos von The Decoder – klar und auf den Punkt.