OpenAI hat einen Passus aus seiner Nutzungsrichtlinie entfernt, der die Nutzung seiner Technologie für militärische Zwecke ausdrücklich untersagte.

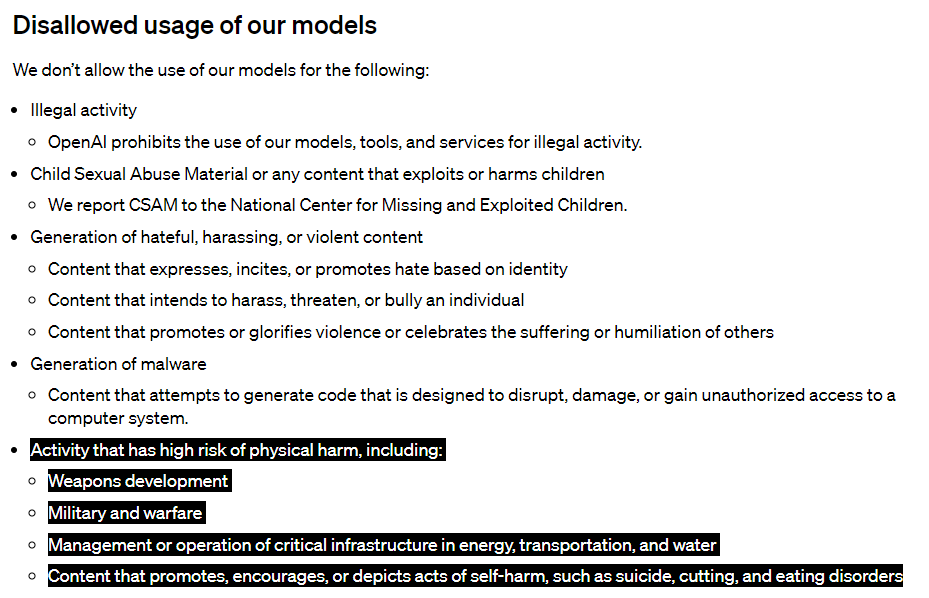

Die frühere Richtlinie verbot ausdrücklich die Durchführung von Aktivitäten mit OpenAI-Technologien und ChatGPT, die ein hohes Risiko für die körperliche Unversehrtheit darstellen, einschließlich der Entwicklung von Waffen und der militärischen Kriegsführung.

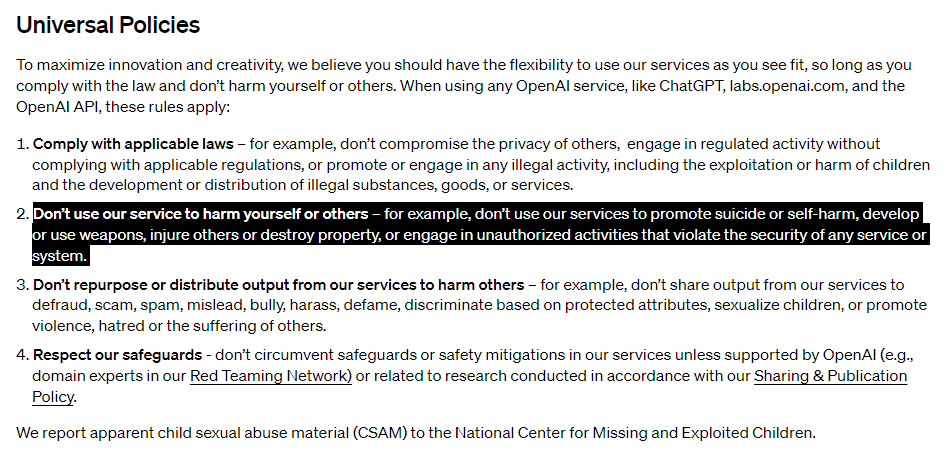

Die überarbeitete Richtlinie enthält eine Klausel, die es verbietet, den Dienst zu nutzen, um sich selbst oder anderen Schaden zuzufügen, und nennt als Beispiel die Entwicklung von Waffen. Militärische und kriegerische Zwecke werden jedoch nicht mehr ausdrücklich erwähnt.

In der vorherigen Fassung waren "militärische und kriegerische Zwecke" ausdrücklich ausgeschlossen.

Die Änderung sei Teil einer größeren Überarbeitung, um das Dokument klarer und lesbarer zu machen, sagt OpenAI-Sprecher Niko Felix in einer E-Mail an The Intercept. Ziel sei es, "universelle Prinzipien zu schaffen, die leicht zu merken und anzuwenden sind".

Ob das Verbot, anderen "Schaden zuzufügen", militärische Nutzung generell ausschließt, wollte Felix nicht kommentieren.

Er betont jedoch, dass die Regeln auch das Militär einschließen, wenn dieses OpenAI-Technologien nutzen möchte, um Waffen zu entwickeln oder einzusetzen, andere zu verletzen oder Eigentum zu zerstören oder unautorisierte Aktivitäten durchzuführen, die die Sicherheit eines Dienstes oder Systems beeinträchtigen.

KI kommt auf dem Schlachtfeld an

Die Auswirkungen dieser Richtlinienänderung sind unklar, aber sie kommt zu einer Zeit, in der das Pentagon und die US-Geheimdienste ein wachsendes Interesse an KI-Technologien zeigen.

OpenAI könnte mit dieser Änderung zumindest Gesprächsbereitschaft signalisieren und seine bisherige strikte Haltung aufweichen, indem es etwa die Tür zur Unterstützung militärischer Betriebsinfrastrukturen öffnet. Denkbar wäre, dass das Militär ein System wie ChatGPT zur Textgenerierung nutzen darf, um den Informationsfluss zu beschleunigen oder zu automatisieren.

Die Aufrüstung mit KI im militärischen Bereich ist seit Jahren im Gange. Das US-Pentagon verkündete bereits 2019 in einem Strategiepapier, dass KI zukünftig alle militärischen Bereiche durchdringen soll. Aktivitäten von China und der Krieg in der Ukraine sollen diese Entwicklung zuletzt beschleunigt haben. Mögliche Einsatzgebiete sind etwa autonome Drohnen, die im Ukrainekrieg bereits als Waffe im Einsatz sind, oder Propaganda mittels Deepfake.