Alle reden über ChatGPT und generierte Texte. Aber eigentlich will OpenAI eine Super-KI entwickeln. Die Firma erinnert an ihr Fernziel - und macht einen Vorschlag, wie man ein solches System im Zaum halten könnte.

Der Artikel über die Kontrolle einer möglichen Super-KI kommt direkt aus der Chefetage von OpenAI: Sam Altman, Greg Brockman und Ilya Sutskever sind die Absender.

Sie diskutieren mögliche Governance-Systeme für superintelligente KI-Systeme. Das sind nach ihrer Definition zukünftige KI-Systeme, die "dramatisch leistungsfähiger" sein werden als selbst "Artificial General Intelligence" (AGI). Eine genauere Definition von "Superintelligenz" geben die drei Gründungsmitglieder von OpenAI nicht.

Altman, Brockman und Sutskever gehen davon aus, dass die Auswirkungen künstlicher Superintelligenz weitreichend sein werden, sowohl im positiven als auch im negativen Sinne, und vergleichen die möglichen Folgen mit denen der Atomenergie oder der synthetischen Biologie. KI-Systeme würden in den nächsten zehn Jahren "in den meisten Bereichen das Niveau von Experten übertreffen und so viel produktive Arbeit leisten wie die größten Unternehmen heute".

Koordination, Kontrolle, Technologie

Für eine effektive Kontrolle der Superintelligenz schlagen die Autoren drei Ansatzpunkte vor:

- Koordination: Um eine sichere und reibungslose Integration superintelligenter Systeme in die Gesellschaft zu gewährleisten, müssten die führenden Entwicklungsanstrengungen im Bereich der Super-KI koordiniert werden. Dies könne durch ein globales Projekt geschehen, das von großen Regierungen ins Leben gerufen wird, oder durch eine kollektive Vereinbarung zur Begrenzung der Wachstumsrate von KI-Fähigkeiten.

- Regulierung: Wie schon bei der Anhörung vor dem US-Senat plädiert OpenAI erneut für eine Regulierungsbehörde ähnlich der Internationalen Atomenergiebehörde (IAEA). Eine solche Behörde wäre für die Überwachung einer Superintelligenz zuständig. Sie würde Systeme inspizieren, Audits einfordern, Sicherheitsstandards durchsetzen und Nutzungsbeschränkungen und Sicherheitsstufen festlegen.

- Technische Lösungen: Die Menschheit müsse zudem die technischen Fähigkeiten entwickeln, um superintelligente KI sicher zu machen. Dies sei eine offene Forschungsfrage.

Die drei OpenAI-Leiter befürworten zwar eine strenge Regulierung von Superintelligenz, betonen aber gleichzeitig die Notwendigkeit einer klaren Grenze, die es Unternehmen und Open-Source-Projekten ermöglicht, Modelle unterhalb einer signifikanten Fähigkeitsschwelle ohne belastende Regulierung zu entwickeln.

"Die Systeme, über die wir uns Sorgen machen, werden mächtiger sein als alle bisher geschaffenen Technologien, und wir sollten uns davor hüten, den Fokus auf sie zu verwässern, indem wir ähnliche Standards auf Technologien anwenden, die weit unterhalb dieser Schwelle liegen", heißt es in dem Text.

Menschen sollten über KI-Fähigkeiten entscheiden

Altman, Brockman und Sutskever betonen die Bedeutung der öffentlichen Beteiligung und Kontrolle bei der Steuerung mächtiger KI-Systeme. Die Grenzen und Ziele der Systeme müssten demokratisch festgelegt werden.

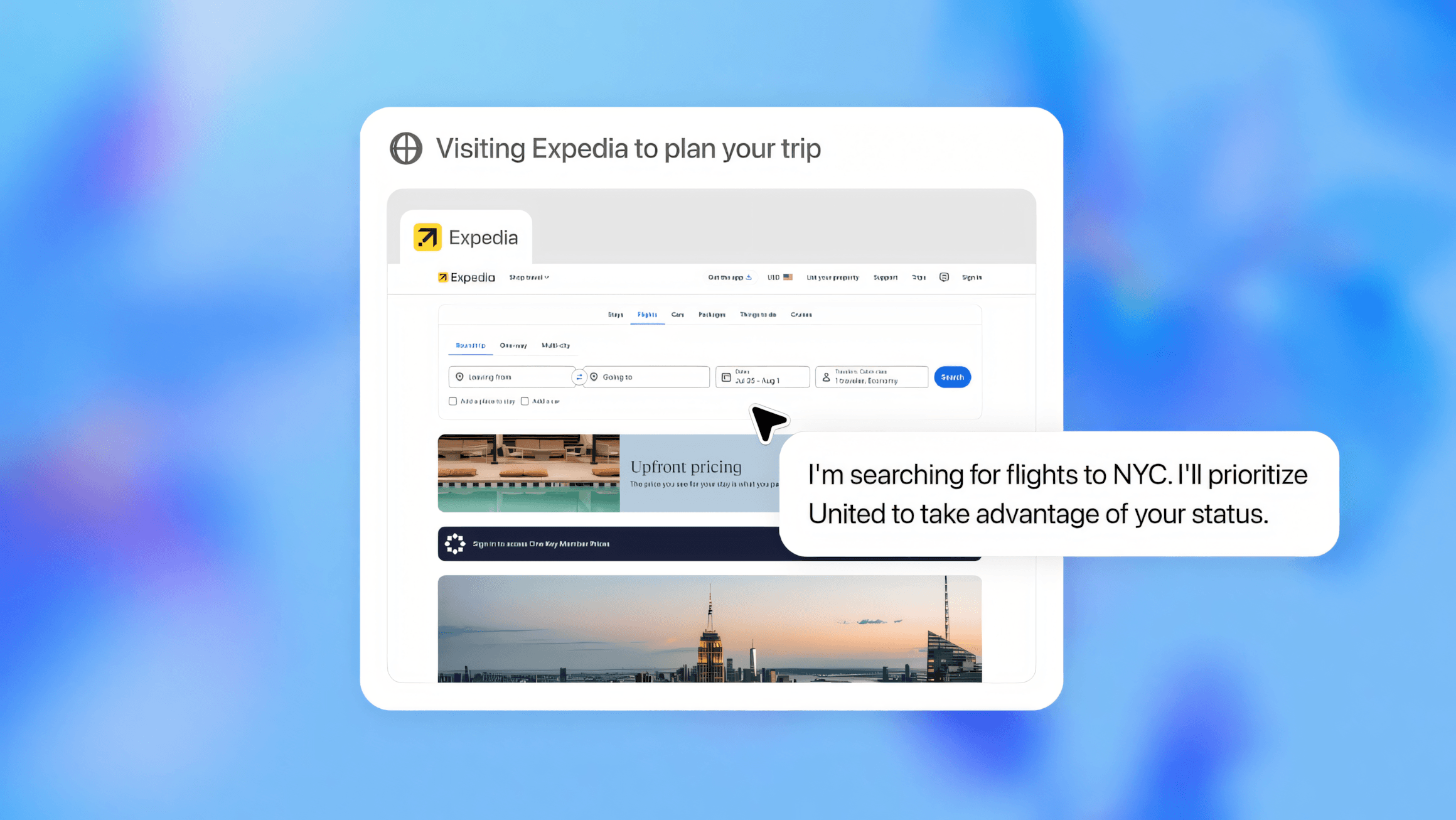

Innerhalb dieser weit gefassten Grenzen müssten die Nutzerinnen und Nutzer jedoch "viel Kontrolle" über das von ihnen genutzte KI-System haben. OpenAI-CEO Altman hat bereits angekündigt, dass sein Unternehmen in Zukunft selbst solche individuellen Modelle ermöglichen will.

Abschließend rechtfertigen die Autoren trotz aller Risiken die Entwicklung einer künstlichen Superintelligenz: Sie könne potenziell zu einer "viel besseren Welt" führen, als wir sie uns heute vorstellen könnten. Erste Beispiele seien derzeit in den Bereichen Bildung, Kreativität und Produktivität sichtbar.

Zudem sei es nahezu unmöglich, die Entwicklung einer Super-KI aufzuhalten. Ihr Entstehen sei aufgrund des enormen Nutzens, der sinkenden Kosten und der Vielzahl der Akteure unvermeidlich. Um die Entwicklung zu stoppen, wäre eine Art "globales Überwachungsregime" notwendig, und selbst das sei keine Garantie. "Wir müssen es also schaffen."