MetaDreamer generiert 3D-Modelle aus Text in Rekordzeit

Generative KI für 3D-Modelle machen stetige Fortschritte. Das neueste System kommt von Forschenden aus China und ist das bisher schnellste.

Forschende von MetaApp AI Research und mehreren chinesischen Universitäten haben MetaDreamer entwickelt, ein neues Werkzeug zur schnellen Erstellung von 3D-Modellen aus Textbeschreibungen. Das Verfahren soll gängige Probleme bei der Erstellung von 3D-Modellen wie Inkonsistenzen aus verschiedenen Blickwinkeln und langsame Verarbeitungszeiten überwinden.

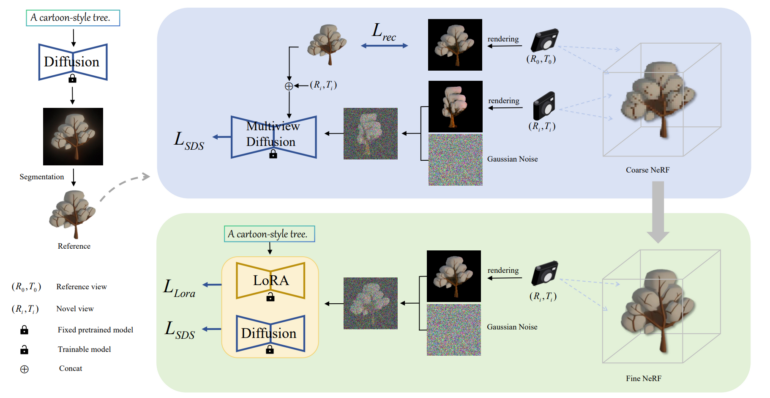

Dazu trennt das Team den generativen Prozess. MetaDreamer funktioniert in zwei Hauptphasen: Zuerst formt das Tool das 3D-Objekt (Geometriephase), um sicherzustellen, dass es aus allen Blickwinkeln korrekt aussieht. Anschließend fügt MetaDreamer in der Texturphase Details und Texturen hinzu, um das Objekt realistisch erscheinen zu lassen.

MetaDreamer generiert Modell in 20 Minuten

Konkret optimiert das MetaDreamer-Team in der Geometriephase ein grobes 3D-Modell in Instant-NGP mit einem Referenzbild, das von einem Diffusionsmodell generiert wurde, und mehreren Bildern, die von einem Multiview-Diffusionsmodell aus verschiedenen Blickwinkeln erzeugt wurden. In der zweiten Phase wird das so entstandene Modell in Instant-NGP mit weiteren KI-generierten Detailbildern weiter verfeinert.

Nach Angaben des Teams führt diese Methode zu schnelleren und qualitativ besseren 3D-Modellen. MetaDreamer kann detaillierte 3D-Objekte aus Text in nur 20 Minuten auf einer Nvidia A100 GPU erstellen, was derzeit die schnellste Zeit in diesem Bereich ist.

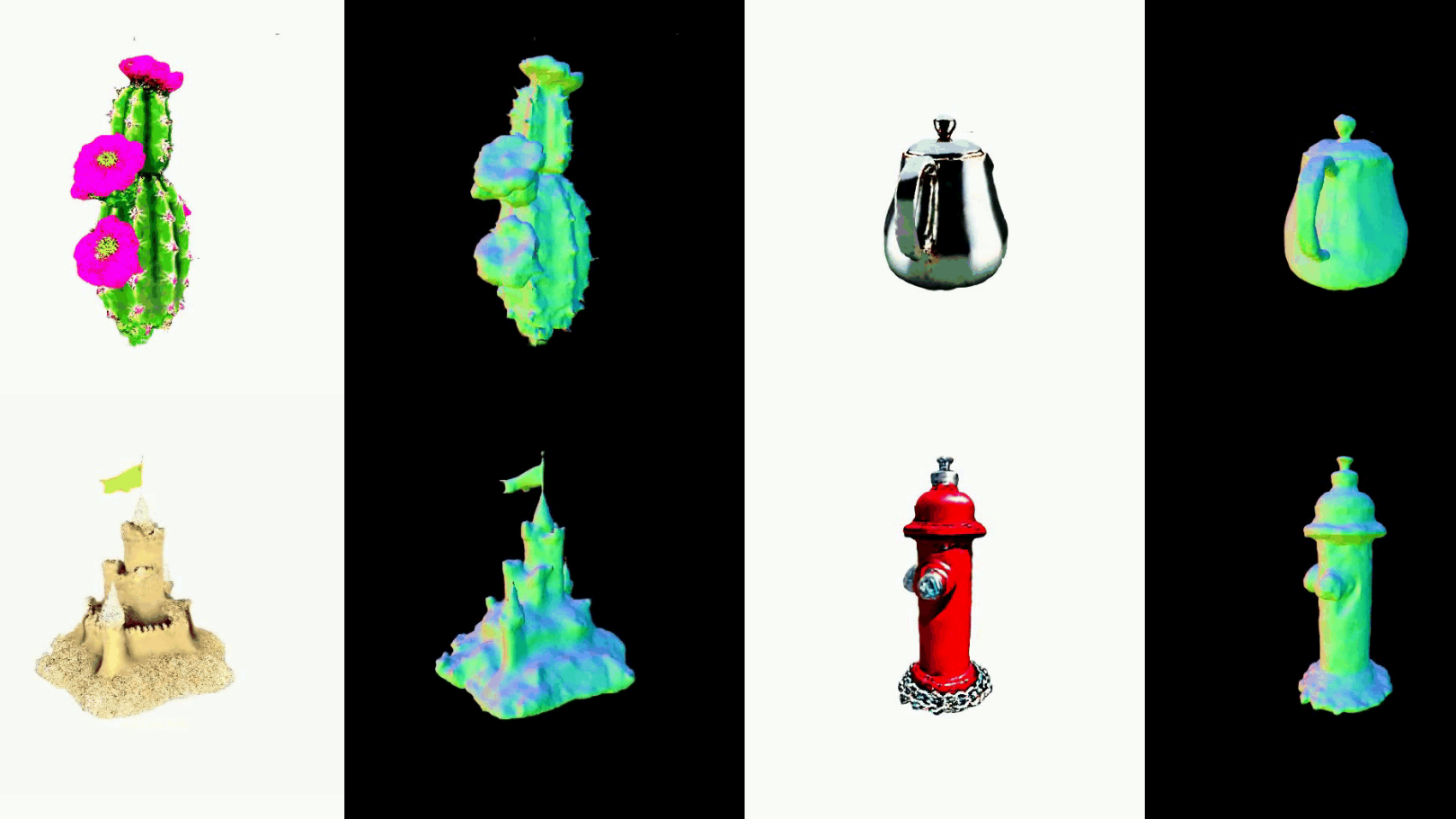

MetaDreamer zeigt Qualitätssprung gegenüber älteren Methoden

In Tests verglichen die Forschenden MetaDreamer mit anderen Text-zu-3D-Methoden wie Dreamfusion und Magic3D. MetaDreamer übertraf diese in Bezug auf Geschwindigkeit, Qualität und Übereinstimmung der Modelle mit den Textbeschreibungen. MetaDreamer erzielte auch die höchste Punktzahl in den T3Bench-Benchmarks, einem Standard zur Messung der Qualität von 3D-Modellen.

Video: MetaApp AI

Video: MetaApp AI

Allerdings ist das Tool noch nicht perfekt, zum Beispiel hat es Schwierigkeiten bei der Erstellung von Szenen mit mehreren Objekten. Das Team plant, dieses Problem in Zukunft zu lösen, indem das Modell besser versteht, wie Objekte im 3D-Raum interagieren.

Weitere Beispiele für generative KI-Modelle für 3D sind Googles Dream Fields, CLIP-Mesh, OpenAIs Point-E und Shap-E, Tencents Dream3D oder jüngst 3D Gaussian Splatting. Von Luma AI gibt es mit Genie zudem ein kommerzielles Angebot.

Mehr Informationen und Beispiele gibt es auf der MetaDreamer-Projektseite.

KI-News ohne Hype – von Menschen kuratiert

Mit dem THE‑DECODER‑Abo liest du werbefrei und wirst Teil unserer Community: Diskutiere im Kommentarsystem, erhalte unseren wöchentlichen KI‑Newsletter, 6× im Jahr den "KI Radar"‑Frontier‑Newsletter mit den neuesten Entwicklungen aus der Spitze der KI‑Forschung, bis zu 25 % Rabatt auf KI Pro‑Events und Zugriff auf das komplette Archiv der letzten zehn Jahre.

Jetzt abonnierenKI-News ohne Hype

Von Menschen kuratiert.

- Mehr als 16 % Rabatt.

- Lesen ohne Ablenkung – keine Google-Werbebanner.

- Zugang zum Kommentarsystem und Austausch mit der Community.

- Wöchentlicher KI-Newsletter.

- 6× jährlich: “KI Radar” – Deep-Dives zu den wichtigsten KI-Themen.

- Bis zu 25 % Rabatt auf KI Pro Online-Events.

- Zugang zum kompletten Archiv der letzten zehn Jahre.

- Die neuesten KI‑Infos von The Decoder – klar und auf den Punkt.