Facebook KI SEER: Maschinenverstand für die visuelle Welt

Facebooks KI-Bildanalyse SEER nähert sich selbstüberwacht der Leistung überwacht trainierter Bildanalyse-Systeme - und löst sich so von den Fesseln menschlicher Vorarbeit.

Der Siegeszug aktueller Bildanalyse-KIs begann in den frühen 2010er Jahren, als KI-Forscherin Fei-Fei Li die ImageNet-Challenge (ILSVRC) startete: Dort traten verschiedene KI-Systeme gegeneinander in der Objekterkennung an. Als Grundlage diente der ImageNet-Datensatz, der damals größte Bilddatensatz mit knapp 14 Millionen Motiven, die von über 25.000 Arbeitern aufwendig per Hand 20.000 Kategorien zugeordnet wurden.

Mit sogenannten gelabelten (beschrifteten) Daten können KI-Systeme überwacht trainieren. Die KI lernt so, die Kategorien, die menschliche Arbeiter zuvor festgelegt haben, einem Bildmotiv zuzuordnen. Das Problem: Es ist unmöglich, alle visuellen Elemente und Perspektiven auf der Welt händisch zu beschreiben.

Daher fällt die Leistung überwacht trainierter KI-Bildanalyse in der echten Welt häufig ab, etwa wenn ein eigentlich bekanntes Objekt aus einem anderen Winkel zu sehen ist, eine andere Textur trägt oder zum Beispiel Regen oder ein Schneesturm den visuellen Eindruck verändert. Außerdem können durch den Trainingsprozess leicht menschliche Vorurteile in die Datensätze und somit in die KI-Systeme fließen.

KI trainiert sich selbst

Eine vielversprechende Alternative zu manuell beschrifteten Daten ist das selbstüberwachte KI-Training (Erklärung). Das KI-System soll bei dieser Trainingsmethode selbstständig Muster in Unmengen Bilddaten erkennen und somit eine Art gesunden Maschinenverstand für die visuelle Welt entwickeln.

Die Forscher hoffen, dass sich daraus eine menschenähnliche Fähigkeit zum Lernen neuer visueller Konzepte entwickelt: Heutige KI-Systeme müssen beispielsweise hunderte oder tausende Beispiele einer Katze sehen, um diese wiederzuerkennen.

Einem Kind hingegen reichen wenige Eindrücke einer Katze, um sie anschließend mit hoher Wahrscheinlichkeit in vielen Kontexten wiederzuerkennen. Wahrscheinlich kann es sogar sagen, dass ein Tiger eher eine Katze als ein Hund ist, obwohl ein Tiger deutlich anders aussieht als eine Hauskatze.

Es gibt bereits eine ganze Reihe selbstüberwacht trainierte KI-Systeme wie Microsofts DeBERTa, OpenAIs erfolgreiche Text-KI GPT-3 oder die verwandte Bild-KI DALL-E. Die Leistung dieser Systeme zeigt, dass der selbstüberwachte Lernansatz funktioniert.

Auch in der KI-Bildanalyse gibt es bereits selbstüberwacht trainierte KI-Systeme, aber bislang nicht in dem Maßstab wie Facebooks SEER: Facebook verwendete eine Milliarde zufällig ausgewählte Instagram-Bilder für das KI-Training.

Facebook SEER: eine Milliarde Bilder, eine Milliarde Parameter

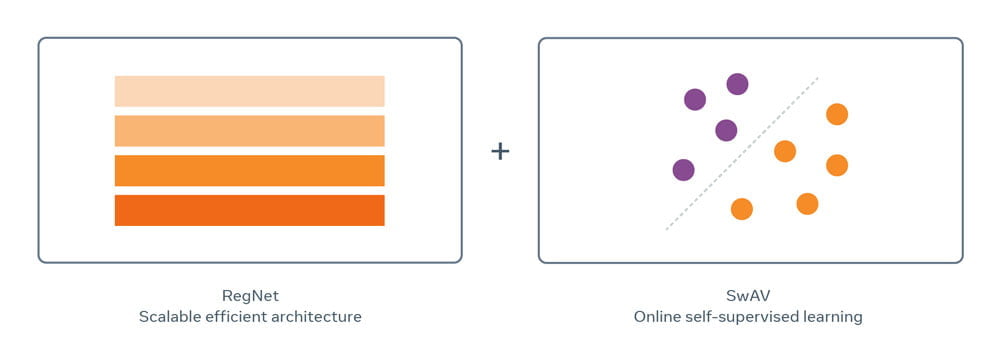

Facebooks KI-Bildanalyse SEER ("SElf-supERvised") gehört mit einer Milliarde Parametern zu den größten ihrer Art. Dank des großen Umfangs soll SEER alle visuellen Konzepte in Trainingsdaten erlernen können. Möglich wird das durch RegNets, eine besonders effiziente Variante der in der Bildanalyse häufig eingesetzten ConvNets (Convolutional Neural Network), die potenziell gigantische Netze mit Billionen von Parametern erlauben.

Gelernt hat SEER mit einer Variante des kontrastiven Lernens: Ein System lernt, aus einer Reihe Daten miteinander kompatible Paare zu finden. Bei einer Text-KI ist das etwa ein passendes Wort, das einen Satz fortführt oder eine Lücke in einem Satz füllt. Bei einer Bildanalyse-KI kann das Paar etwa aus einem Bildausschnitt und dem Originalbild bestehen.

Zeigt sich in einem Bildausschnitt der Kopf einer Katze und die Originalaufnahme zeigt die komplette Katze, lernt die Bildanalyse-KI während des Trainings, dass diese Bilder zusammengehören. Mit genügend Beispielen lernt die KI so das visuelle Konzept Katze von anderen Konzepten zu unterscheiden.

Facebook setzt für das kontrastive Lernen auf den SwAV-Algorithmus, der Bilder mit ähnlichen visuellen Konzepten gruppiert und so den Lernprozess im Vergleich zu anderen Methoden deutlich beschleunigt. Den SwAV-Algorithmus und andere Werkzeuge für das selbstüberwachte Training veröffentlicht Facebook mit der neuen PyTorch-Bibliothek VISSL.

SEER setzt sich an die Spitze

Facebooks SEER übertrifft in allen getesteten Benchmarks die Leistung vergleichbarer selbstüberwacht trainierter Systeme und schlägt in einigen Tests auch überwacht trainierte Systeme.

Das System zeigt außerdem deutliche Leistungszuwächse schon bei geringer Feineinstellung: Eine mit lediglich zehn Prozent des ImageNet-Datensatzes trainierte SEER-Variante erreicht eine Genauigkeit von knapp 78 Prozent im ImageNet-Test. Mit einem Prozent erreichte SEER immerhin noch 60,5 Prozent Genauigkeit. Vollständig nachtrainiert erreicht SEER 84,2 Prozent Genauigkeit.

Das ist zwar weit von den knapp 95 Prozent Genauigkeit entfernt, die auf ImageNet spezialisierte, überwacht trainierte Netze erreichen, zeigt aber, dass SEER visuelle Konzepte gelernt hat und mit Nachtraining auf gewisse Aufgaben spezialisiert werden kann. Diese Fähigkeit zum Few-Shot-Training (Erklärung) zeigen auch riesige Sprachmodelle wie GPT-3.

Selbstüberwachtes Lernen als Schritt zur menschengleichen Intelligenz

Laut Facebooks KI-Chef Yann LeCun zeigen die Ergebnisse, „dass wir den Paradigmenwechsel des selbstüberwachten Lernens auf die Computer Vision übertragen können.“

Die Konsequenz: Maschinen können direkt auf die riesige Menge Informationen in unserer Welt zugreifen, denn sie sind nicht mehr auf einen aufwendigen Datenaufbereitungsprozess für das KI-Training angewiesen.

Für Objekterkennung und andere Bildaufgaben können Forscher so auf große und vielfältige Bilddatenbanken zurückgreifen. Entsprechend trainierte Systeme und ihre Fähigkeit zu nachträglicher Spezialisierung könnten auch in Feldern nützlich werden, in denen es wenig Bilddaten für das KI-Training gibt – etwa der medizinischen Bildgebung.

LeCun, der seit Jahren von dem Potenzial des selbstüberwachten Lernens überzeugt ist, blickt schon weiter: „Selbstüberwachtes Lernen ist ein Schritt auf dem Weg zur menschengleichen Intelligenz. Aber es gibt sicherlich noch viele Schritte, die wir danach gehen müssen.“

KI-News ohne Hype – von Menschen kuratiert

Mit dem THE‑DECODER‑Abo liest du werbefrei und wirst Teil unserer Community: Diskutiere im Kommentarsystem, erhalte unseren wöchentlichen KI‑Newsletter, 6× im Jahr den „KI Radar"‑Frontier‑Newsletter mit den neuesten Entwicklungen aus der Spitze der KI‑Forschung, bis zu 25 % Rabatt auf KI Pro‑Events und Zugriff auf das komplette Archiv der letzten zehn Jahre.

Jetzt abonnierenKI-News ohne Hype

Von Menschen kuratiert.

- Mehr als 20 Prozent Launch-Rabatt.

- Lesen ohne Ablenkung – keine Google-Werbebanner.

- Zugang zum Kommentarsystem und Austausch mit der Community.

- Wöchentlicher KI-Newsletter.

- 6× jährlich: „KI Radar“ – Deep-Dives zu den wichtigsten KI-Themen.

- Bis zu 25 % Rabatt auf KI Pro Online-Events.

- Zugang zum kompletten Archiv der letzten zehn Jahre.

- Die neuesten KI‑Infos von The Decoder – klar und auf den Punkt.